|

Опрос

|

реклама

Быстрый переход

Через год сегодняшний ChatGPT будет выглядеть смехотворно плохо, заявил директор OpenAI

08.05.2024 [13:51],

Дмитрий Федоров

Брэд Лайткап (Brad Lightcap), главный операционный директор OpenAI, рассказал на Глобальной конференции в Институте Милкена о будущем компании и её планах на следующие 6–12 месяцев. По его мнению, нынешние системы искусственного интеллекта (ИИ), такие как ChatGPT, являются «смехотворно плохими» по сравнению с тем, что ждёт человечество впереди. Он подчеркнул, что будущие версии ИИ будут настолько продвинутыми, что изменят саму суть взаимодействия с пользователями.

Источник изображения: JuliusH / Pixabay Лайткап описал нынешнюю версию ChatGPT как начальный этап в эволюции ИИ, предназначенного для выполнения простых задач. «Я думаю, что через год мы оглянемся назад и поймём, насколько несовершенными они были», — заявил Лайткап, когда его спросили о бизнесе OpenAI через 6–12 месяцев. В перспективе он предвидит эволюцию ИИ в направлении более сложных задач, где ИИ станет отличным напарником, способным на равных общаться с людьми, как друг или коллега. Кроме технологических аспектов Лайткап прокомментировал социальные последствия развития ИИ. Он опроверг мнение о том, что развитие ИИ приведёт к массовым увольнениям людей, утверждая, что новые ИИ-системы наоборот спровоцируют спрос на ещё не существующие вакансии. По его мнению, экономика станет более разнообразной и устойчивой, а рынок труда адаптируется к технологическим изменениям. В свете этих заявлений интересно, что генеральный директор OpenAI Сэм Альтман (Sam Altman) также высказывался о будущем ChatGPT на семинаре в Стэнфордском университете, назвав GPT-4 самой глупой моделью, с которой людям придётся работать когда-либо в будущем. Такие заявления вероятно намекают на то, что будущие обновления ChatGPT станут переломными и приведут к значительному улучшению функциональности продуктов OpenAI. OpenAI позволит правообладателям запретить использование контента для обучения ИИ

08.05.2024 [12:34],

Павел Котов

OpenAI сообщила, что разрабатывает инструмент под названием Media Manager, который позволит создателям и владельцам контента отметить свои работы для компании и указать, как можно ли их включать в массив данных для исследований и обучения ИИ, или же нельзя.

Источник изображения: Growtika / unsplash.com Инженеры OpenAI намереваются разработать этот инструмент к 2025 году. Сейчас компания сотрудничает с «создателями контента, правообладателями и регуляторами» над выработкой стандарта. «Создание первого в своём роде инструмента, который поможет нам идентифицировать текст, аудио и видео, защищённые авторским правом, в нескольких источниках и отразить предпочтения создателей, потребует передовых исследований в области машинного обучения. Со временем мы планируем внедрить дополнительные возможности и функции», — сообщила OpenAI в своём блоге. Media Manager, вероятно, станет ответом компании на критику в отношении её подхода к разработке искусственного интеллекта. Она в значительной степени использует общедоступные данные из интернета, но совсем недавно несколько крупных американских изданий подали на OpenAI в суд за нарушение прав интеллектуальной собственности: по версии истцов, компания украла содержимое их статей для обучения моделей генеративного ИИ, которые затем коммерциализировались без компенсации и упоминания исходных публикаций. OpenAI считает, что невозможно создавать полезные модели ИИ без защищённых авторским правом материалов. Но в стремлении унять критику и защититься от вероятных исков компания предприняла несколько шагов, чтобы пойти навстречу создателям контента. В прошлом году она позволила художникам удалять свои работы из наборов обучающих данных для генераторов изображений, а также ввела директиву для файла robots.txt, которая запрещает её поисковому роботу копировать содержимое сайтов для дальнейшего обучения ИИ. OpenAI продолжает заключать соглашения с крупными правообладателями на предмет использования их материалов. OpenAI научилась распознавать сгенерированные своим ИИ изображения, но не без ошибок

08.05.2024 [10:19],

Дмитрий Федоров

OpenAI объявила о начале разработки новых методов определения контента, созданного искусственным интеллектом (ИИ). Среди них — новый классификатор изображений, который определяет, было ли изображение сгенерировано ИИ, а также устойчивый к взлому водяной знак, способный маркировать аудиоконтент незаметными сигналами.

Источник изображения: Placidplace / Pixabay Новый классификатор изображений способен с точностью до 98 % определять, было ли изображение создано ИИ-генератором изображений DALL-E 3. Компания утверждает, что их классификатор работает, даже если изображение было обрезано, сжато или была изменена его насыщенность. В то же время эффективность этой разработки OpenAI в распознавании контента, созданного другими ИИ-моделями, такими как Midjourney, значительно ниже — от 5 до 10 %. Также OpenAI ввела водяные знаки для аудиоконтента, созданного с помощью своей платформы преобразования текста в речь Voice Engine, находящейся на стадии предварительного тестирования. Эти водяные знаки содержат информацию о создателе и методах создания контента, что значительно упрощает процесс проверки их подлинности. OpenAI активно участвует в работе Коалиции по происхождению и аутентичности контента (C2PA), в состав которой также входят такие компании, как Microsoft и Adobe. В этом месяце компания присоединилась к руководящему комитету C2PA, подчеркивая свою роль в разработке стандартов прозрачности и подлинности цифрового контента. Для этих целей OpenAI интегрировала в метаданные изображений так называемые учётные данные контента от C2PA. Эти учётные данные, фактически являясь водяными знаками, включают информацию о владельце изображения и способах его создания. OpenAI уже много лет работает над обнаружением ИИ-контента, однако в 2023 году компании пришлось прекратить работу программы, определяющей текст, сгенерированный ИИ, из-за её низкой точности. Разработка классификатора изображений и водяного знака для аудиоконтента продолжается. В OpenAI подчёркивают, что для оценки эффективности этих инструментов крайне важно получить отзывы пользователей. Исследователи и представители некоммерческих журналистских организаций имеют возможность протестировать классификатор изображений на платформе доступа к исследованиям OpenAI. Microsoft создала секретный генеративный ИИ для спецслужб США — он полностью изолирован от интернета

07.05.2024 [20:03],

Сергей Сурабекянц

Корпорация Microsoft запустила предназначенную для спецслужб США модель генеративного искусственного интеллекта на суперкомпьютере, полностью изолированном от интернета. Теперь Малдер и Скалли смогут безопасно использовать современные технологии для анализа сверхсекретной информации.

Источник изображений: unsplash.com По словам представителя Microsoft, впервые большая языковая модель генеративного ИИ на основе GPT-4 полностью отделена от интернета. Большинство подобных моделей, включая ChatGPT от OpenAI, полагаются на облачные сервисы для обучения и определения закономерностей, но Microsoft хотела предоставить разведывательному сообществу США «по-настоящему безопасную систему». Разведывательные службы всех стран рассчитывают, что генеративный ИИ поможет в анализе быстро растущих объёмов ежедневно генерируемой секретной информации, но им необходимо сбалансировать обращение к большим языковым моделям с риском утечки или взлома. В прошлом году ЦРУ запустило службу, подобную ChatGPT, для работы с несекретными документами, но спецслужбам требовалось обрабатывать гораздо более конфиденциальные данные. «Идёт гонка по внедрению генеративного ИИ в разведывательные данные, — заявила помощник директора Центра транснациональных и технологических миссий ЦРУ Шитал Патель (Sheetal Patel). — Первая страна, которая будет использовать генеративный ИИ, выиграет эту гонку. И я хочу, чтобы это были мы».  Microsoft потратила 18 месяцев на разработку и внедрение системы, включая капитальные доработки существующего суперкомпьютера в Айове. Представленная модель GPT4 является статической, то есть она может только анализировать информацию, но не обучаться на этих данных. Таким образом, правительство может сохранить свою модель «чистой» и предотвратить утечку секретной информации. Прогнозируется, что доступ к системе получат около 10 000 сотрудников со специальным допуском. ИИ научил робопса балансировать на шаре — он тренирует роботов эффективнее, чем люди

07.05.2024 [12:23],

Павел Котов

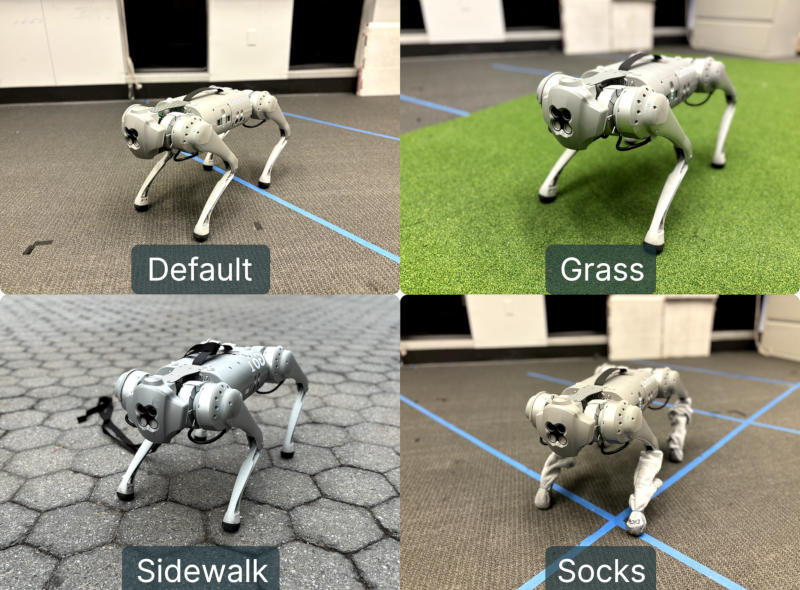

Группа учёных Пенсильванского университета разработала систему DrEureka, предназначенную для обучения роботов с использованием больших языковых моделей искусственного интеллекта вроде OpenAI GPT-4. Как оказалось, это более эффективный способ, чем последовательность заданий в реальном мире, но он требует особого внимания со стороны человека из-за особенностей «мышления» ИИ.

Источник изображения: eureka-research.github.io Платформа DrEureka (Domain Randomization Eureka) подтвердила свою работоспособность на примере робота Unitree Go1 — четвероногой машины с открытым исходным кодом. Она предполагает обучение робота в симулированной среде, используя рандомизацию основных переменных: показатели трения, массы, демпфирования, смещения центра тяжести и других параметров. На основе нескольких пользовательских запросов ИИ сгенерировал код, описывающий систему вознаграждений и штрафов для обучения робота в виртуальной среде. По итогам каждой симуляции ИИ анализирует, насколько хорошо виртуальный робот справился с очередной задачей, и как её выполнение можно улучшить. Важно, что нейросеть способна быстро генерировать сценарии в больших объёмах и запускать их выполнение одновременно. ИИ создаёт задачи с максимальными и минимальными значениями параметров на точках отказа или поломки механизма, достижение или превышение которых влечёт снижение балла за прохождение учебного сценария. Авторы исследования отмечают, что для корректного написания кода ИИ требуются дополнительные инструкции по безопасности, в противном случае нейросеть при моделировании начинает «жульничать» в стремлении к максимальной производительности, что в реальном мире может привести к перегреву двигателей или повреждению конечностей робота. В одном из таких неестественных сценариев виртуальный робот «обнаружил» что способен передвигаться быстрее, если отключит одну из ног и начнёт передвигаться на трёх. Исследователи поручили ИИ соблюдать особую осторожность с учётом того, что обученный робот будет проходить испытания и реальном мире, поэтому нейросеть создала дополнительные функции безопасности для таких аспектов как плавность движений, горизонтальная ориентация и высота положения туловища, а также учёт величины крутящего момента для электродвигателей — он не должен превышать заданных значений. В результате система DrEureka справилась с обучением робота лучше, чем человек: машина показала 34-процентный прирост в скорости движения и 20-процентное увеличение расстояния, преодолеваемого по пересечённой местности. Такой результат исследователи объяснили разницей в подходах. При обучении задаче человек разбивает её на несколько этапов и находит решение по каждому из них, тогда как GPT проводит обучение всему сразу, и на это человек явно не способен. В результате система DrEureka позволила перейти от симуляции напрямую к работе в реальном мире. Авторы проекта утверждают, что могли бы дополнительно повысить эффективность работы платформы, если бы сумели предоставить ИИ обратную связь из реального мира — для этого нейросети потребовалось бы изучать видеозаписи испытаний, не ограничиваясь анализом ошибок в системных журналах робота. Среднему человеку требуются до 1,5 лет, чтобы научиться ходить, и лишь немногие способны передвигаться верхом на мяче для йоги. Обученный DrEureka робот эффективно справляется и с этой задачей. Opera добавила ИИ-функцию краткой сводки веб-страниц для Android

07.05.2024 [06:27],

Анжелла Марина

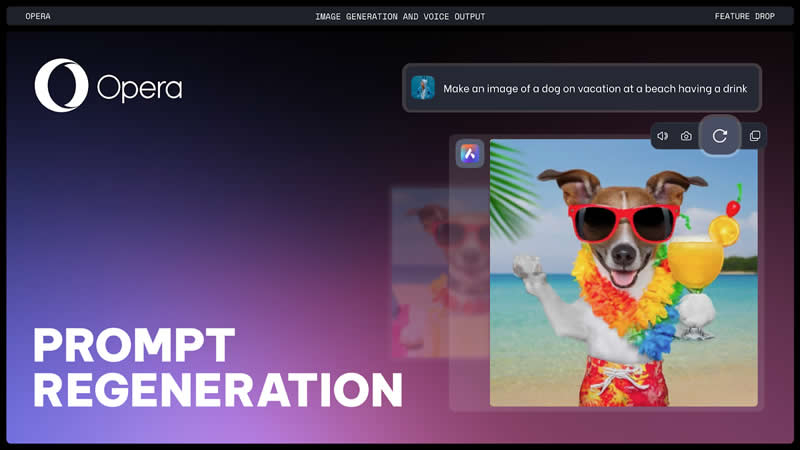

Браузер Opera для Android получил удобный ИИ-инструмент для быстрого ознакомления с содержанием веб-страниц. Новая функция генерирует краткое резюме длинных статей и сообщений, позволяя экономить время на понимание темы и поиск ключевых деталей. Для использования функции «Сводка» нужно обновить Opera для Android до последней версии и войти в учётную запись.

Источник изображения: Opera Инструмент реферирования текста основан на встроенном в Opera помощнике искусственного интеллекта Aria. Пользователю достаточно открыть любую текстовую страницу в Opera, нажать на три точки в правом верхнем углу и выбрать пункт «Сводка» (Summarize) рядом с иконкой Aria. После этого откроется диалог, в котором будет представлено краткое резюме статьи, обычно умещающееся на одном экране. Такое резюме помогает быстро понять суть, выделить основные моменты и решить, стоит ли тратить время на полное прочтение. Это действительно удобно, когда нужно быстро ознакомиться с большим количеством информации, найденной в интернете. Также помощник теперь может зачитывать текстовые ответы вслух. Напомним, помощник искусственного интеллекта Aria был интегрирован в браузер Opera около года назад. Он работает как чат-бот, отвечая на вопросы пользователей и является альтернативой традиционному поиску в интернете. А совсем недавно в Aria была добавлена возможность генерировать изображения на основе текстовых запросов с использованием технологии Imagen 2 компании Google. Разработчики постоянно расширяют функциональность Aria с помощью специальной программы обновлений AI Feature Drops, чтобы пользователи получали все последние улучшения для комфортного использования всех опций интеллектуального браузера. YouTube протестирует на платных подписчиках перемотку видео сразу на самое интересное место

06.05.2024 [11:48],

Дмитрий Федоров

YouTube тестирует новую функцию, которая позволяет пользователю быстро переключаться на самый интересный момент просматриваемого ролика. Для этого используются данные о просмотрах видео и искусственный интеллект (ИИ). Эксперимент продлится до 1 июня, и его результаты могут оказать значительное влияние на общую стратегию сервиса.

Источник изображения: muhammadsaqii786 / Pixabay YouTube начал тестировать упомянутую функцию в марте текущего года с участием небольшой группы пользователей, но теперь сделал её доступной для подписчиков YouTube Premium. Принцип работы довольно прост: когда пользователь дважды нажимает, чтобы перемотать видео вперёд, появляется кнопка, которая перемещает его к тому месту, до которого обычно перематывают большинство зрителей. Для определения наиболее просматриваемых эпизодов функция использует ИИ и данные о просмотрах видео. Для получения доступа к функции необходимо быть подписчиком YouTube Premium и также включить экспериментальные функции сервиса. В настоящее время нововведение доступно только в США для приложения YouTube на Android и только для видео на английском языке, по которым есть достаточно данных, чтобы определить любимые моменты зрителей. Согласно информации на сайте YouTube, тестирование функции продлится до 1 июня. После этого, предположительно, будет собрана обратная связь от пользователей, и на основе неё будет принято решение о более широком внедрении функции. Если вы хотите проверить, доступна ли эта функция вам, перейдите в раздел «Настройки» и выберите «Попробовать экспериментальные новые функции». В целом, новая функция YouTube представляет собой интересный эксперимент в области улучшения пользовательского опыта. Она может значительно упростить процесс просмотра видео, особенно для тех, кто хочет быстро перейти к самым важным или вирусным моментам. Однако, как и любая новая функция, она требует дальнейшего тестирования и оптимизации, и будет интересно узнать, как она будет принята пользователями и как повлияет на общую стратегию YouTube. В Лос-Анджелесе прошёл фестиваль ИИ-кино — оно уже почти неотличимо от традиционного

04.05.2024 [12:12],

Павел Котов

На этой неделе компания Runway AI, разрабатывающая инструменты для создания и редактирования видео с использованием искусственного интеллекта, провела в Лос-Анджелесе уже второй ИИ-кинофестиваль. В прошлом году участники представили на мероприятии 300 работ. В этом году их стало уже 3000, пишет Bloomberg.

Источник изображения: openai.com В театре «Орфей» (Orpheum Theatre) собрались кинематографисты, художники, технические специалисты, инвесторы и по крайней мере одна известная актриса — Наташа Лионн (Natasha Lyonne). Они с познакомились с десятью вышедшими в финал работами, которые были отобраны судьями фестиваля. Ленты были довольно странными. В одной из них мультяшная птица киви отправилась в приключение через океан. Другая работа олицетворяла борьбу современного человека с тревожностью — запертый в доме главный герой сражался с мясным монстром. В этом году атмосфера мероприятия была той же, что и в прошлом, зато работы заметно отличались. Они меньше походили на экспериментальное кино и уже больше напоминали традиционное. В прошлом году Runway собиралась представить ПО, позволяющее генерировать видео по текстовому описанию. Тогда кинематографисты лишь начинали задумываться, как ИИ может вписаться в творческий процесс — это могли быть сгенерированные ИИ или созданные Runway инструменты для монтажа. В одной из прошлогодних работ странные расплывчатые лица в кадре, казалось, соответствовали художественному замыслу. Теперь ИИ-ленты преобразились, как и зарождающаяся отрасль, которая их производит. Runway — лишь одна из нескольких компаний, предлагающих генерацию видео по текстовому описанию. Прорыв обещает совершить OpenAI, представившая модель Sora. Официальной даты запуска у неё пока нет, но разработчик предоставил к ней доступ небольшой группе профессионалов, и это дало интересные результаты. ИИ быстро превращается из необычной новинки в полезный инструмент для кинематографистов. Глядя представленные на фестивале работы, не всегда можно было точно сказать, где и как в производственном процессе использовался ИИ. Microsoft закрыла полиции США доступ к ИИ, который использовали для распознавания лиц

03.05.2024 [12:52],

Павел Котов

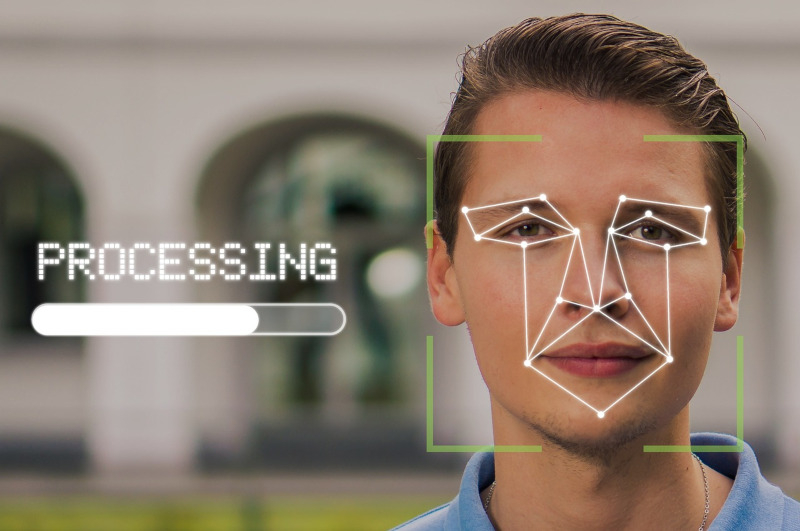

Microsoft подтвердила запрет полицейским структурам в США использовать инструменты генеративного искусственного интеллекта для распознавания лиц, основанные на технологиях её партнёра OpenAI — корпоративные клиенты могут пользоваться ими в облачной инфраструктуре Azure.

Источник изображения: Tumisu / pixabay.com В условиях обслуживания платформы Azure OpenAI Service появилась формулировка, которая с большей очевидностью запрещает осуществлять её интеграцию с полицейскими структурами в США с целью распознавания лиц, включая интеграцию с существующими и перспективными моделями ИИ для анализа изображений. Отдельный пункт документа прямо запрещает использование «технологии распознавания лиц в реальном времени» на мобильных камерах, включая нательные камеры и видеорегистраторы для попыток идентификации личности в «неконтролируемых» условиях. Microsoft обновила политику через неделю после того, как компания Axon, производитель технологического оборудования для вооружённых сил и правоохранительных органов, анонсировала новую систему расшифровки записи звука с нательных камер — эта система основана на модели OpenAI GPT-4. Правозащитники указали, что она может давать сбои из-за склонности ИИ к галлюцинациям и расовым предубеждениям. При этом отсутствуют точные сведения, использовала ли Axon доступ к GPT-4 через Azure OpenAI Service, а если да, то стало ли обновление политики реакцией на этот продукт. Запрет на доступ к Azure OpenAI Service распространяется только на полицию США, а не правоохранительные органы других стран. Он также не распространяется на системы распознавания лиц с помощью стационарных камер в контролируемых средах, например, на территории отделения. OpenAI, которая ранее отказывалась от сотрудничества с вооружёнными силами, запустила ряд проектов для Пентагона, в том числе по направлению кибербезопасности, сообщило в январе агентство Bloomberg. Microsoft также предложила Министерству обороны США генератор изображений OpenAI DALL-E для разработки ПО для проведения военных операций, узнало издание The Intercept. Платформа Azure OpenAI Service с дополнительными возможностями стала доступной в пакете Microsoft Azure для государственных учреждений в феврале. Мобильный ИИ-гаджет Rabbit R1 за $199 подвергся критике экспертов после дебюта на CES 2024

02.05.2024 [06:25],

Дмитрий Федоров

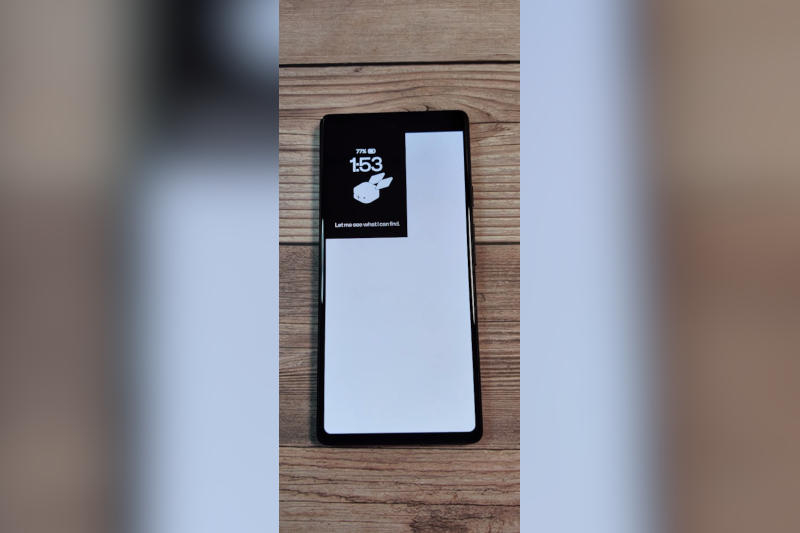

Новейший ИИ-гаджет Rabbit R1, вызвавший волну интереса на международной выставке CES 2024, после начала продаж подвергся жёсткой критике со стороны экспертов. Стоимость устройства составляет $199, но ряд технических недочётов и ограниченная функциональность вызвали серьёзные вопросы к его практической ценности.

Источник изображений: rabbit.tech На CES Rabbit R1 быстро стал центром внимания благодаря своей инновационной системе — большой модели действий (Large Action Model или LAM), которая позволяет устройству автоматически выполнять задачи, аналогично персональному ассистенту. Эта технология предполагает не просто выполнение команд, а обучение в процессе использования, что открывает новые перспективы для взаимодействия пользователя с устройством. Благодаря этому 10 000 устройств были проданы по предварительным заказам.  Однако, вопреки изначальному энтузиазму, в первых обзорах новинки эксперты стали указывать на серьёзные проблемы с совместимостью приложений и недолговечностью батареи. Интересно, но на момент запуска Rabbit R1 поддерживает всего четыре приложения, что значительно ограничивает его функциональность. Продолжительность работы устройства от одного заряда батареи составляет всего несколько часов, что ставит под вопрос его удобство в ежедневном использовании.  Технологический обозреватель Маркес Браунли (Marques Brownlee), известный своей критической оценкой продукта Humane AI Pin, отметил, что хотя Rabbit R1 и лучше, планка для его сравнения установлена довольно низко. Он подчеркнул, что устройство кажется незаконченным и не готовым к массовому выпуску, и считает его едва ли пригодным для обзора. Его замечание отражает общую тенденцию в технологической и игровой индустрии, а теперь и в продуктах с ИИ, которые кажутся сделанными наспех.  Как отмечают издания Tom's Guide и Digital Trends, устройство создаёт впечатление «сырого» продукта. В частности, Tom's Guide присвоил Rabbit R1 оценку в 1,5 звезды из 5 и посоветовал избегать этого гаджета, а Digital Trends назвал новинку «беспорядочной», подчёркивая серьёзные недостатки в её функциональности. Многие рецензенты сомневаются в целесообразности Rabbit R1, тем более что кажется, что всё, что он делает, можно сделать с помощью приложения для смартфона.  Журналист Мишаал Рахман (Mishaal Rahman) из издания Android Authority продемонстрировал, что некоторые функции Rabbit R1 можно реализовать, установив файл APK лаунчера Rabbit на смартфон Google Pixel 6A. Однако он отметил, что без привилегированных разрешений системного уровня не все функции работают должным образом, что свидетельствует о потенциальных ограничениях такой интеграции. Появление Rabbit R1 на рынке стало ярким событием, однако первый опыт эксплуатации оставил пользователей с множеством вопросов и сомнений. Производителю предстоит не только доработать свой продукт до уровня ожиданий пользователей, но и продемонстрировать, что инновации могут быть не только яркими, но и функциональными, чтобы восстановить утраченное доверие. Разработан ИИ, распознающий эмоции человека по голосу — он поможет в работе кризисных линий

01.05.2024 [16:47],

Павел Котов

Модель искусственного интеллекта оказалась эффективным инструментом для выявления таких эмоций как страх и беспокойство в голосах людей, которые звонят на телефонные линии психологическом помощи. Автор проекта надеется, что она окажется полезной для телефонных операторов на линиях по предотвращению самоубийств.

Источник изображения: The_BiG_LeBowsKi / pixabay.com Оценка эмоционального состояния звонящих на кризисные телефонные линии на предмет текущего уровня суицидального риска имеет решающее значение для выявления и предотвращения самоубийств. Речь человека способна при помощи невербальных средств передавать полезную информацию о психическом и эмоциональном состоянии человека, содержа подсказки о том, испытывает он грусть, злобу или страх. Исследования суицидальной речи начались более 30 лет назад — уже удалось выявить в ней объективные звуковые признаки, которые можно использовать для определения различных психических состояний и расстройств, включая депрессию. Но для человека, слушающего собеседника по телефону, оценка риска самоубийства может оказаться сложной задачей, потому что на кризисные линии звонят люди, пребывающие в крайне эмоционально нестабильном состоянии, и характеристики их речи могут быстро меняться. Решение этой задачи предложил Алаа Нфисси (Alaa Nfissi), аспирант университета Конкордия (Канада, г. Монреаль). Он обучил распознаванию речевых эмоций модель ИИ. Обычно такую оценку проводили психологи, из-за чего она требовала значительных временных затрат и опыта, но модель глубокого обучения оказалась способной эффективно распознавать эмоции. Для обучения модели автор проекта использовал базу реальных записей звонков на кризисные линии для предотвращения самоубийств, а также записи актёров, которым было поручено изображать определённые эмоции. Записи были разбиты на сегменты и снабжены аннотациями, отражающими соответствующее состояние психики: злость, грусть, нейтральное состояние, страх или беспокойство. В результате модель научилась достаточно точно распознавать четыре эмоции: страх/беспокойство (правильный ответ в 82 % случаев), грусть (77 %), злость (72 %) и нейтральное состояние (78 %). Особенно хорошо модель справлялась с оценкой фрагментов записей настоящих звонков: грусть (78 %) и злость (100 %). Алаа Нфисси считает, что разработанная им модель ИИ сможет использоваться в качестве вспомогательного инструмента для работы на кризисных линиях, помогая операторам в реальном времени оценивать состояние собеседников и выбирать подходящие стратегии разговора. Возможно, это будет способствовать предотвращению самоубийств. Большинство возможностей ИИ-гаджета Rabbit R1 уместилось в одном приложении для Android

01.05.2024 [16:11],

Павел Котов

На минувшей неделе в продажу поступило основанное на искусственном интеллекте устройство Rabbit R1. Выход необычного гаджета заставил общественность задаться вопросом, почему эти функции не повторить в мобильном приложении. Как выяснилось, этот гаджет работает под управлением Android, и большинство его возможностей действительно реализовано в одном приложении.

Источник изображения: youtube.com/@AndroidAuthority Журналисту Android Authority Мишаалу Рахману (Mishaal Rahman) удалось установить файл APK лаунчера Rabbit на смартфон Google Pixel 6A. Проведя некоторую настройку, он запустил приложение так, как если бы оно работало на оригинальном устройстве Rabbit R1. Используя клавишу увеличения громкости вместо единственной аппаратной кнопки на Rabbit R1, он настроил учётную запись и начал задавать телефону вопросы, как если бы это был оригинальный ИИ-гаджет за $199. Всех возможностей устройства приложение, вероятно, предложить не сможет, признаёт журналист: «Приложение лаунчера Rabbit R1 рассчитано на предварительную установку в прошивке и на некоторые привилегированные разрешения системного уровня — мы смогли предоставить лишь некоторые из них — поэтому некоторые функции, скорее всего, дадут сбой, если мы попытаемся». Но тот факт, что ПО работает на недорогом телефоне двухлетней давности, даёт основания утверждать, что у него много общего с обычным приложением для Android. Основатель и гендиректор компании Rabbit Джесси Лю (Jesse Lyu) с такой формулировкой не согласен. «Rabbit R1 — это не приложение для Android. <..> Rabbit OS и LAM [Large Action Model — «большая оперативная модель»] работают в облаке с особой модификацией AOSP и прошивки низкого уровня, поэтому локальный пиратский APK без подходящей ОС и облачных ресурсов не сможет получить доступ к нашей службе. Rabbit OS оптимизирована для R1, и сторонних клиентов мы не поддерживаем», — заявил он в соцсети X. Гаджет Rabbit R1 не уникален в использовании платформы от Google: как выяснилось, на открытом варианте Android работает ещё один ИИ-гаджет — Humane AI pin. Что же касается Rabbit R1, он лишь недавно поступил в продажу и уже начал вызывать некоторые нарекания. Производитель уже выпустил первое обновление ПО, чтобы устранить некоторые проблемы и увеличить срок автономной работы аккумулятора. На практике, считают авторы первых обзоров, Rabbit R1 недостаточно полезен, чтобы оправдать своё существование при наличии телефонов — особенно если его возможности можно воплотить в приложении. Microsoft удалила автоматически установившийся Copilot из Windows 11

30.04.2024 [21:19],

Анжелла Марина

Некоторое время назад пользователи ПК столкнулись с автоматической установкой приложения Copilot без их ведома. Это спровоцировало волну критики в адрес Microsoft и подозрение в слежке за пользователями. Теперь компания исправила эту проблему — Microsoft выпустила обновление, которое удаляет это приложение с затронутых устройств.

Источник изображения: Sunrise King/Unsplash В частности, как сообщает Techspot, в последнем обновлении браузера Edge версии 124.0.2478.67 содержится компонент, который удаляет пакет «Поставщик чата Microsoft для Copilot в Windows» с соответствующих компьютеров. После установки этого обновления пользователи больше не будут видеть приложение Copilot в списке установленных программ. Кроме того, Microsoft планирует выпустить еще одно обновление в ближайшее время, которое полностью удалит следы нежелательного ПО с затронутых устройств. Напомним, недавно некоторые владельцы компьютеров с Windows 11 обнаружили, что у них в списке установленных приложений появилось новое ПО под названием Copilot. При этом пользователи не давали согласия на его установку. И хотя это приложение не имело никакой функциональности и содержало нулевой объем данных, многие были возмущены тем, что Microsoft установила его без их ведома и разрешения. Некоторые даже высказывали опасения насчет возможной слежки и сбора личных данных. В своем официальном заявлении Microsoft заверила, что приложение Copilot не собирало и не передавало какие-либо данные пользователей, а также не работало в фоновом режиме. Пакет был установлен с целью подготовки некоторых компьютеров к будущей поддержке сервиса Windows Copilot. Однако из-за ошибки он попал на устройства, для которых не предназначался. В то же время Microsoft продолжает активно продвигать искусственный интеллект в ответ на успех ChatGPT и Dall-E. Причем Windows 11 уже реализована интеграция с Copilot, которому пользователи могут задать 10 вопросов без входа в учетную запись, что позволит оценить возможности ИИ прямо на рабочем столе. Полноценный запуск Windows Copilot ожидается в будущем крупном обновлении Windows 11. По замыслу Microsoft, интегрированный ИИ-ассистент должен помогать в повседневных задачах, таких как составление документов, поиск информации и автоматизации рутинных операций. Реализация этих планов потребует решения многих технических и этических вопросов. Apple переманила из Google десятки ИИ-инженеров и запустила секретную ИИ-лабораторию

30.04.2024 [13:45],

Павел Котов

Компания Apple переманила из Google несколько десятков специалистов в области искусственного интеллекта и открыла в швейцарском Цюрихе секретную лабораторию по разработке соответствующих решений.

Источник изображения: Alireza Khoddam / unsplash.com В последние годы Apple произвела массовый набор сотрудников для расширения подразделения по ИИ и машинному обучению, показал анализ профилей профессиональной соцсети LinkedIn, общедоступных объявлений о вакансиях и исследовательских работ, проведённый Financial Times. Наибольшую ценность для Apple представляют сотрудники Google: в 2018 году производитель iPhone переманил Джона Джаннандреа (John Giannandrea) на руководящую должность в области ИИ — ранее он курировал лабораторию ИИ Google Brain, которую впоследствии объединили с DeepMind. После этого из Google в Apple перешли не менее 36 инженеров. Большая часть команды Apple по ИИ работает в офисах компании в Калифорнии и Сиэтле, но значительно был расширен и офис в Цюрихе. Компания поглотила два местных стартапа — разработчика технологий виртуальной реальности FaceShift и создателя систем распознавания изображений Fashwell, — после чего решила построить здесь исследовательскую лабораторию Vision Lab. Сотрудники из Цюриха разрабатывают большие языковые модели, способные в качестве запросов принимать текст и изображения. При этом работники расположенных поблизости организаций даже не знают о присутствии здесь офиса Apple. Компания традиционно не распространяется о своих планах в области ИИ, тогда как её конкуренты в лице Microsoft, Google и Amazon, напротив, объявляют о многомиллиардных инвестициях в передовые технологии. С начала года акции Apple упали, что побудило компанию объявить о революционных функциях ИИ, которые могут увеличить продажи устройств. Apple сейчас сосредоточена на развёртывании систем генеративного ИИ локально на мобильных устройствах — это значит, что чат-боты и другие приложения с ИИ будут обходиться без облачных ресурсов. В компании уже более десяти лет разрабатывают продукты в области ИИ, включая голосовой помощник Siri, и потенциал нейросетей здесь давно осознали — ещё до появления больших языковых моделей. В 2016 году Apple поглотила компанию Perceptual Machines, основанную Русланом Салахутдиновым (Ruslan Salakhutdinov) и двумя его студентами из университета Карнеги — Меллона. Эта компания работала над системой ИИ для распознавания изображений. Салахутдинов учился в университете Торонто у «крёстного отца» технологий ИИ Джеффри Хинтона (Geoffrey Hinton), который в прошлом году оставил пост вице-президента Google из-за опасений по поводу систем генеративного ИИ. До 2020 года Салахутдинов занимал пост директор по исследованиям в области ИИ в Apple, после чего вернулся в университет Карнеги — Меллона.

Источник изображения: Alex Dudar / unsplash.com Помимо Джона Джаннандреа, в Apple работают и другие выходцы из Google. Сами Бенджио (Samy Bengio), старший директор по исследованиям в области ИИ и машинного обучения ранее был одним из ведущих учёных Google в этой области. Руоминг Панг (Ruoming Pang), который сейчас возглавляет подразделение Apple Foundation Models, работающее над большими языковыми моделями, до этого руководил исследованием Google по распознаванию речи с использованием ИИ. Некоторое время в Apple работал пионер в области технологий глубокого обучения Ян Гудфеллоу (Ian Goodfellow), но он вернулся в Google, потому что был недоволен условиями работы в Apple. В марте Apple опубликовала исследовательский документ, посвящённый разработке семейства ИИ-моделей MM1, воспринимающих запросы в текстовом и визуальном форматах — среди авторов работы указаны шестеро бывших сотрудников Google. За последние десять лет Apple приобрела около двух десятков стартапов в области ИИ — они специализируются на технологиях распознавания изображений и видео, обработки данных, поиска и управления музыкальным контентом. Основатели компаний Musicmetric, Emotient, Silk Labs, PullString, CamerAI, Fashwell, Spectral Edge, Inductiv Inc, Vilynx, AI Music и WaveOne до сих пор значатся сотрудниками Apple. Сейчас компания сосредоточена на том, чтобы делать «как можно больше на устройстве», что приведёт к потребности в более мощных чипах с динамической оперативной памятью (DRAM), способных обрабатывать огромные объёмы данных, которые необходимы для ИИ, отметил господин Салахутдинов. Если сегодня средний объём памяти на смартфоне составляет 8 Гбайт, то для работы больших языковых моделей на устройстве потребуются не менее 12 Гбайт, добавил исполнительный вице-президент и главный бизнес-директор Micron Technology Сумит Садана (Sumit Sadana) — компания является одним из поставщиков компонентов для Apple. Ещё одной причиной недостаточно оперативного внедрения ИИ в экосистему Apple является склонность языковых моделей давать не соответствующие действительности или недопустимые ответы — компания проявляет осторожность, не желая выпускать то, что не может полностью контролировать, говорит Руслан Салахутдинов. О первых значительных шагах в области ИИ компания, как ожидается, расскажет на своём мероприятии WWDC. Среди новых продуктов, считают аналитики, может стать значительно поумневший персональный голосовой помощник — обновлённая Siri, которая, например, сможет взаимодействовать с приложениями на смартфоне посредством голосового управления. Возможно, одна или две функции смогут «изменить правила игры для среднего потребителя». Microsoft добавила поддержку русского и ещё 15 языков в Copilot для Microsoft 365

30.04.2024 [01:19],

Николай Хижняк

Компания Microsoft сообщила, что значительно расширила список языков, поддерживаемых ИИ-помощником Copilot в составе пакета офисных приложений Microsoft 365.

Источник изображения: Microsoft «С сегодняшнего дня мы начинаем выпуск обновления Copilot для Microsoft 365 с поддержкой 16 дополнительных языков. К растущему списку уже поддерживаемых языков, который включает упрощённый китайский, английский (американский, британский, австралийский, канадский, индийский), французский (включая канадский французский), немецкий, итальянский, японский, португальский (Бразилия) и испанский (испанский и мексиканский) добавились арабский, чешский, голландский, финский, иврит, венгерский, корейский, норвежский (букмол), польский, португальский (Португалия), русский, шведский, тайский, турецкий и украинский», — отмечает представитель Microsoft в официальном блоге. В сообщении также отдельно упоминается китайский (традиционный), который ранее был доступен в бесплатной версии Copilot. Теперь он доступен (для пользовательского интерфейса), но не поддерживается для запросов Copilot для Microsoft 365. Компания обещает скоро добавить полноценную поддержку и этого языка. «Copilot для Microsoft 365 может не понимать все разговорные выражения или лингвистические конвенции в указанном языке. Мы постоянно совершенствуем языковые возможности Copilot и призываем пользователей предоставлять нам конструктивную обратную связь. Мы также продолжаем расширять список поддерживаемых языков и сообщим больше новостей в ближайшие месяцы». Компания также опубликовала инструкцию, в которой описывается, как можно поменять язык в той или иной программе, входящей в пакет Microsoft 365. |