Google показала прямо в рекламном ролике, как ИИ даёт вредный совет

На конференции I/O 2024 компания Google подчеркнула, что разработанный ей нейросети Gemini станут новым словом в поиске и ИИ-ассистентах. Однако одна из самых ярких демонстраций возможностей этой системы снова омрачилась недостатком, присущим всем современным большим языковым моделям — галлюцинациями, то есть дачей заведомо неверного ответа.

Источник изображений: youtube.com/@Google

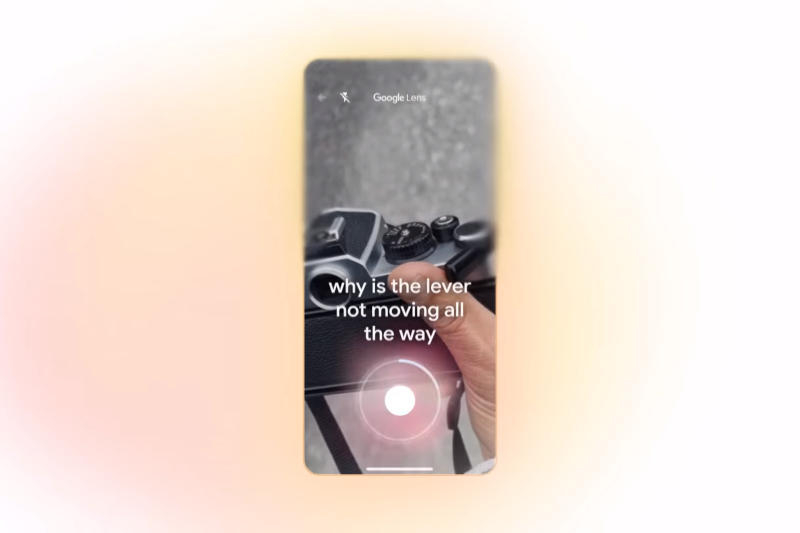

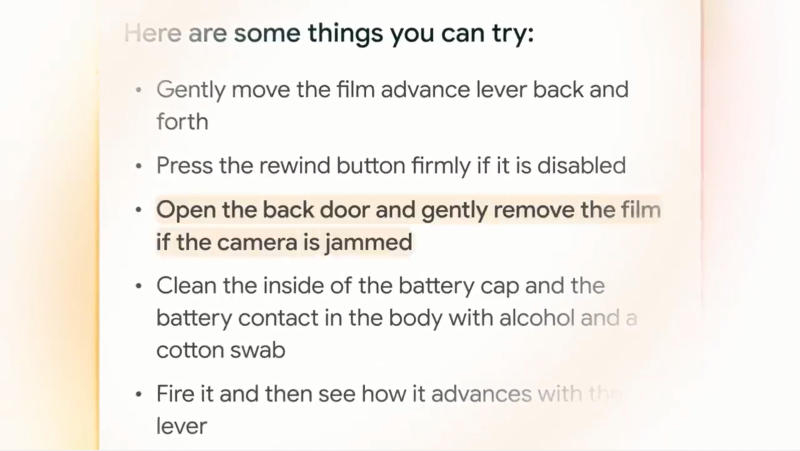

В ролике «Поиск в эпоху Gemini» Google продемонстрировала видеопоиск — функцию поиска информации на основе видео. В качестве одного из примеров компания привела ролик с застрявшим рычажком перемотки плёнки на фотоаппарате и вопросом, почему этот рычажок не движется до конца. Gemini распознал видео, понял запрос и дал несколько советов по исправлению. И как минимум один из них оказался неверным.

ИИ порекомендовал «открыть заднюю крышку и аккуратно снять плёнку». И это, возможно, худшее, что можно сделать в данной ситуации. Потому что если открыть заднюю крышку плёночного фотоаппарата не в абсолютно тёмной комнате, плёнка засветится, и все сделанные снимки придут в негодность. Но на видео этот ответ подсвечен как наиболее подходящий.

Google уже не впервые публикует рекламный материал с фактической ошибкой — заведомо неверной информацией, которую даёт ИИ. В прошлом году чат-бот Bard сообщил, что первый снимок экзопланеты — планеты за пределами Солнечной системы — был получен космическими телескопом «Джеймс Уэбб» (JWST), хотя это не так.