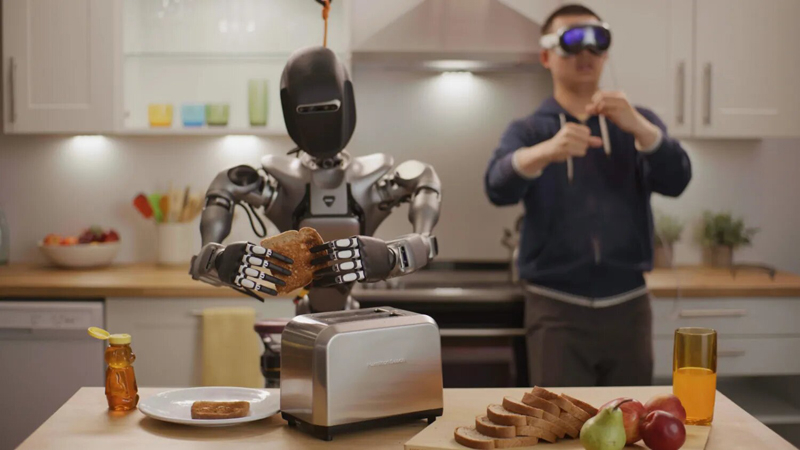

Компания Nvidia использует гарнитуру дополненной реальности Apple Vision Pro для разработки человекоподобного робота, пишет ресурс 9to5Mac. Разработчики обучают ИИ-модель Project GR00T для робота-гуманоида с помощью реальных и синтетических данных, что позволяет им экономить время и снизить расходы.

Источник изображения: 9to5Mac

Обучение базовых моделей ИИ для человекоподобных роботов требует громадного количества данных. Одним из способов захвата (оцифровки) человеческих движений является телеуправление — работа робота в режиме копирования движений человека, которое становится всё более дорогим и длительным процессом, отметила Nvidia.

В прошлом месяце Nvidia представила на конференции по компьютерной графике SIGGRAPH эталонный рабочий процесс телеуправления с использованием Nvidia AI и Nvidia Omniverse, который позволяет исследователям и разработчикам ИИ генерировать огромные объёмы данных синтетического движения и восприятия из минимального количества дистанционно захваченных человеческих движений.

И именно для захвата человеческих движений используется гарнитура дополненной реальности Apple Vision Pro. Сделав с помощью Apple Vision Pro запись небольшого количества демонстраций движений с помощью телеуправления, разработчики затем моделируют полученные данные в NVIDIA Isaac Sim, эталонном приложении, позволяющем проектировать, моделировать, тестировать и обучать роботов на базе ИИ, и используют микросервис MimicGen NIM для генерации синтетических наборов данных из записей. То есть расширяют базу данных с реальной демонстрацией движений синтетическими наборами данных.

С помощью полученной базы данных проходит обучение модели робота-гуманоида Project GR00T. Затем разработчики используют микросервис Robocasa NIM в Isaac Lab, фреймворке для обучения роботов, для генерации опыта для повторного обучения робота.

Источник:

MWC 2018

MWC 2018 2018

2018 Computex

Computex

IFA 2018

IFA 2018

Подписаться

Подписаться