|

Опрос

|

реклама

Быстрый переход

BMW объединилась с Alibaba для совместной разработки автомобильного ИИ

26.03.2025 [11:15],

Алексей Разин

Китайский автомобильный рынок достаточно велик, чтобы оправдывать глубокую адаптацию реализуемых на нём моделей иностранных марок. Сфера программных решений для автомобильной отрасли не является исключением, поэтому со следующего года BMW начнёт предлагать для реализуемых в Китае машин программные решения Alibaba с поддержкой искусственного интеллекта.

Источник изображения: BMW Если быть точнее, как поясняет Bloomberg, немецкий автопроизводитель будет сотрудничать со стартапом Banma, который финансируется китайским гигантом Alibaba и развивает свои программные решения с использованием большой языковой модели Qwen и соответствующих специалистов. Со следующего года в машинах марки BMW для китайского рынка появится продвинутый голосовой ассистент, они также научатся понимать контекст передвижений автовладельца и предлагать сопутствующие услуги. Кроме того, в условиях плотного городского трафика у водителя всегда будет перед глазами информация о дорожных заторах. BMW не одинока в своих предпочтениях. Языковую модель Alibaba Qwen готовы использовать в своих бортовых системах китайские автопроизводители XPeng, Zeekr и Leapmotor. Сама Alibaba готова вкладывать в развитие технологий искусственного интеллекта серьёзные средства, в ближайшие три года на эти нужды будет выделено $52 млрд. Это направление деятельности для китайского гиганта станет приоритетным. В сегменте смартфонов Alibaba удалось договориться с Apple о запуске локализованных для китайского рынка информационных сервисов. Nvidia выпустила ИИ-помощника геймера G-Assist — он подскажет, как устранить просадки FPS и оптимизировать ПК с GeForce RTX

25.03.2025 [16:54],

Владимир Мироненко

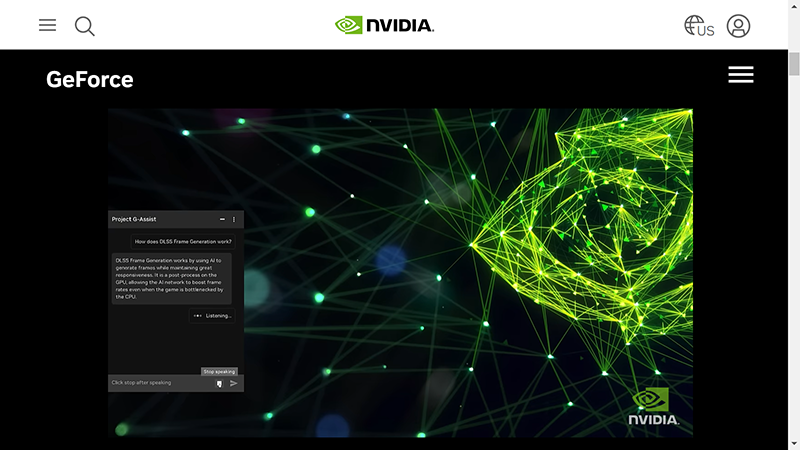

Nvidia объявила о выходе экспериментальной версии ИИ-помощника Project G-Assist System Assistant для настольных ПК с видеокартами GeForce RTX, который позволит оптимизировать настройки игры и системы, измерить частоту кадров и даже изменить подсветку на подключённых устройствах. ИИ-помощник Project G-Assist был анонсирован в прошлом году на выставке Computex 2024.

Источник изображения: NVIDIA Project G-Assist использует специально настроенную малую языковую модель (SLM) Instruct на основе Llama с 8 млрд параметров для интерпретации инструкций на естественном языке и вызова API Nvidia и различных сторонних API для выполнения действий на ПК. ИИ-помощник требует 10 Гбайт и работает на ПК с видеокартами RTX 30-й, 40-й и 50-й серий для десктопов с объёмом видеопамяти не менее 12 Гбайт. G-Assist может предоставлять диагностику в реальном времени и рекомендации для устранения узких мест системы, повышения энергоэффективности, оптимизации настроек игры, разгона графического ускорителя и т.д. Он может отображать и экспортировать различные показатели, такие как частота кадров в секунду, задержка, загрузка графического процессора, температура и другие. Также ИИ-помощник может отвечать на вопросы, касающиеся компонентов ПК или программного обеспечения Nvidia для графического процессора GeForce RTX, установленного в ПК. С помощью G-Assist можно также управлять некоторыми периферийными устройствами и программными приложениями, что, например, позволяет пользователям регулировать скорость вращения вентиляторов или изменять подсветку на поддерживаемых устройствах брендов Logitech G, Corsair, MSI и Nanoleaf. Project G-Assist использует стороннюю SLM, разработанную для локального запуска — он не предназначен для широкого использования в качестве ИИ-чат-бота. G-Assist доступен в рамках обновления приложения Nvidia App, которое также включает новые параметры переопределения DLSS и возможность настройки масштабирования дисплея и цветовых настроек. В будущем обновлении приложения появится функция Project G-Assist для ноутбуков с видеокартами GeForce RTX. Основные требования для использования Project G-Assist:

DeepSeek начали массово встраивать в китайские автомобили — это привлекает покупателей

24.03.2025 [13:18],

Алексей Разин

Программные возможности современных транспортных средств волнуют потенциальных покупателей не меньше, чем технические характеристики и дизайн, поэтому китайские автопроизводители начали активно внедрять поддержку чат-ботов на базе разработок DeepSeek в свою программную инфраструктуру. Подобным образом уже поступили Dongfeng, GAC и BYD.

Источник изображения: BYD Dongfeng Motor, как уточняет Nikkei Asian Review, предлагает поддержку большой языковой модели DeepSeek R1 в мультимедийной системе кроссоверов Zhiyin марки Voyah, причём данная функциональность была добавлена посредством обновления «по воздуху». С апреля аналогичными возможностями начнут обзаводиться крупный внедорожник M-Hero 917 и другие транспортные средства концерна. Искусственный интеллект в бортовой электронике машины используется не только для построения диалога с водителем и пассажирами при помощи голосового ассистента, но и для оценки окружающей обстановки с целью предсказания дальнейших намерений водителя. Лидирующая на китайском рынке гибридов и электромобилей компания BYD также объявила о намерении внедрить разработки DeepSeek в свою продукцию. Некоторые автопроизводители готовы «подружить» собственные программные платформы с языковыми моделями DeepSeek. Например, так намерена поступить китайская компания GAC Group. Языковой ассистент Adigo Sense в автомобилях этой марки будет учитывать историю прошлых запросов и действий водителя для прогнозирования его ближайших намерений. Цифровой помощник сможет оптимизировать маршруты передвижения и предлагать пассажирам фильмы к просмотру с учётом их предпочтений. GAC начнёт внедрять подобные функции в бортовое ПО своих автомобилей в текущем полугодии. Leapmotor надеется сочетать языковые модели DeepSeek с разработкой Alibaba, получившей обозначение Qwen. По крайней мере, такая связка позволит бортовой системе машин Leapmotor научиться генерировать изображения. SAIC намерена внедрить поддержку DeepSeek на автомобилях марки IM Motors в сочетании с решениями Alibaba и ByteDance. В Китае даже импортные марки не стесняются внедрять поддержку DeepSeek для своих транспортных средств локальной сборки. Например, подобной функцией обзаведётся электромобиль Nissan N7, собираемый на совместном предприятии с Dongfeng. Стараниями SAIC поддержкой DeepSeek обзаведутся выпускаемые в Китае модели Buick и Cadillac. Языковые модели этой компании будут соседствовать с чат-ботом Baidu Ernie. Есть в Китае и автопроизводители, которые пока не следуют моде на DeepSeek. Среди них можно отметить Xiaomi и XPeng Motors. Эпоха Google Assistant подошла к концу: скоро его заменит умный ИИ-помощник Gemini на всех Android-смартфонах

14.03.2025 [20:58],

Николай Хижняк

Компания Google сообщила, что в ближайшие месяцы начнёт заменять стандартный цифровой помощник Google Assistant на Android-смартфонах новым ИИ-помощником Gemini. Позже в этом году классический Google Assistant станет недоступен на большинстве Android-смартфонов и исчезнет из магазинов Android-приложений. Он будет полностью заменён Gemini.

Источник изображения: Google Google уже использует Gemini в качестве основного цифрового помощника на своих смартфонах серии Pixel 9. Его также можно установить на большинство современных Android-смартфонов, включая устройства Pixel и модели других производителей, но только в качестве опционального решения, а не стандартного приложения. Для этого необходимо запустить Google Assistant и согласиться на его замену на Gemini. По словам Google, выпущенное в прошлом году приложение Gemini к настоящему моменту уже поддерживает более 40 языков (включая русский) и доступно более чем в 200 странах мира. В дополнение к смартфонам Google также заменит Google Assistant на Gemini в планшетах, мультимедийных системах автомобилей, а также на других устройствах, подключаемых к смартфону. В дальнейшем поддержка ИИ-ассистента появится в умных колонках и смарт-телевизорах. Google начинает тестирование ИИ-режима поисковика с Gemini 2.0 внутри поисковой строки

05.03.2025 [23:47],

Анжелла Марина

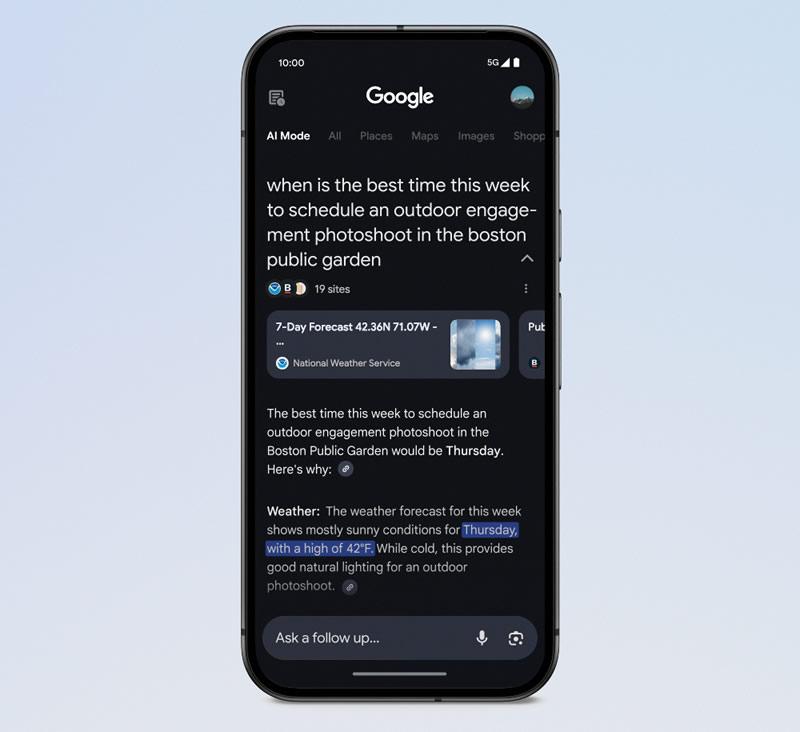

Компания Google объявила о расширении функции «Обзоры ИИ» (AI Overviews), которая теперь будет доступна пользователям по всему миру, даже тем, кто не авторизован в системе. Также появится новый режим поисковика AI Mode, который трансформирует привычный поиск в интерактивный диалог с искусственным интеллектом.

Источник изображения: Google Google продолжает расширять использование AI Overviews в своей поисковой системе, показывая сгенерированные ИИ сводки для всё большего числа запросов и делая их доступными для всех пользователей. Но гораздо интереснее другая новая функция — отдельный ИИ-режим поиска AI Mode. AI Mode представляет собой поисковый чат-бот, интегрированный прямо в основную систему поиска. Инструмент напоминает Perplexity или ChatGPT Search, но адаптирован для Google. Как пишет TheVerge, пока AI Mode доступен только подписчикам Google One AI Premium, но даже они должны вручную включить его в разделе Labs. Основная идея AI Mode заключается в том, что многим пользователям нравится сразу получать сгенерированный ответ, а не просматривать ссылки. В этом режиме запрос обрабатывается поисковой ИИ-моделью, которая использует данные из индекса Google, а также добавляет ссылки на источники. Визуально AI Mode напоминает чат-бот Gemini, но в отличие от него может анализировать информацию в реальном режиме времени, а также взаимодействовать с веб-страницами.  Некоторые эксперты отмечают, что Google всё больше отходит от традиционной схемы поиска, при которой пользователи переходят на сайты из списка ссылок. Однако вице-президент по продуктам поисковой команды Робби Стайн (Robby Stein) с этим не согласен. «AI Overviews дают пользователям необходимый контекст, после чего они, наоборот, охотнее кликают по ссылкам и проводят больше времени на сайтах», — пояснил он. По мнению компании, новые технологии не заменяют старые механизмы поиска, а улучшают его. Google утверждает, что AI Mode не является попыткой полностью заменить традиционный поиск. Тем не менее, очевидно, что ИИ-технологии уже заметно меняют работу поисковой системы, будущее которой всё сильнее связано с искусственным интеллектом. Что касается функции AI Overviews, то в ней будет использоваться обновлённая модель Gemini 2.0, что, по словам Стайна, улучшит ответы на запросы, связанные с математикой, программированием и логическим анализом. Google Pixel 10 получит нового ИИ-ассистента Pixie, который будет работать локально и сможет управлять приложениями

05.03.2025 [11:21],

Владимир Фетисов

Долгое время Google пыталась создать действительного умного ИИ-помощника. К сожалению, попытки выпустить «новый» Google Assistant не увенчались успехом, а проект At A Glace и вовсе был отменён. В 2023 году впервые стало известно о разработке нового помощника Pixie, который должен быть стать частью устройств Pixel 9. Теперь же стало известно, что новый помощник Google появится в смартфонах Pixel 10, но будет называться Pixel Sense.

Источник изображения: androidauthority.com «Получите максимально персонализированный опыт, основанный на том, что вы делаете со своим Pixel», — говорится в описании приложения Pixel Sense. Как и предполагалось, новый голосовой помощник сможет анализировать данные из других приложений Google, чтобы более точно определять интересы и привычки каждого конкретного пользователя. Это означает, что Pixel Sense будет обрабатывать данные из Chrome, «Календаря», «Контактов», Gmail, YouTube, «Карт» и других приложений. В дополнение к этому он будет обрабатывать медиафайлы, включая текст, изображения, сгенерированный с помощью искусственного интеллекта контент и связанные с ним метаданные. Алгоритм будет обрабатывать скриншоты и другие изображения, чтобы выделять их метаданные и использовать их для обучения. На данный момент официальной информации о новом помощнике Google не так много. Известно, что он сможет предлагать пользователю выполнить то или иное действия, как бы предугадывая его желания. Для повышения точности таких персонализированных предложений рекомендуется предоставлять больше личных данных, информации о посещаемых местах, времени их посещения и других интересах. Помощник сможет анализировать действия пользователя во время взаимодействия со смартфоном, чтобы ускорить выполнение рутинных задач. Он также будет адаптироваться к интересам пользователя, становясь более персонализированным по мере обучения на новых данных. Новый ИИ-помощник Google будет работать локально на пользовательском устройстве, т.е. ему не будет требоваться постоянное интернет-соединение или доступ к удалённым серверам. «Ваши данные остаются приватными — они видны только вам, даже Google не может их увидеть», — говорится в сообщении Google. Это может означать, что основой Pixel Sense станет языковая модель Gemini Nano. На данный момент трудно сказать, насколько новый помощник Google окажется удачным, поскольку создание такого приложения является сложной задачей. Возможно, фирменные чипы Tensor в сочетании с алгоритмом Gemini Nano помогут IT-гиганту создать по-настоящему умного ИИ-помощника. Microsoft обновила интерфейс ИИ-помощника Copilot для Windows

05.03.2025 [08:32],

Владимир Фетисов

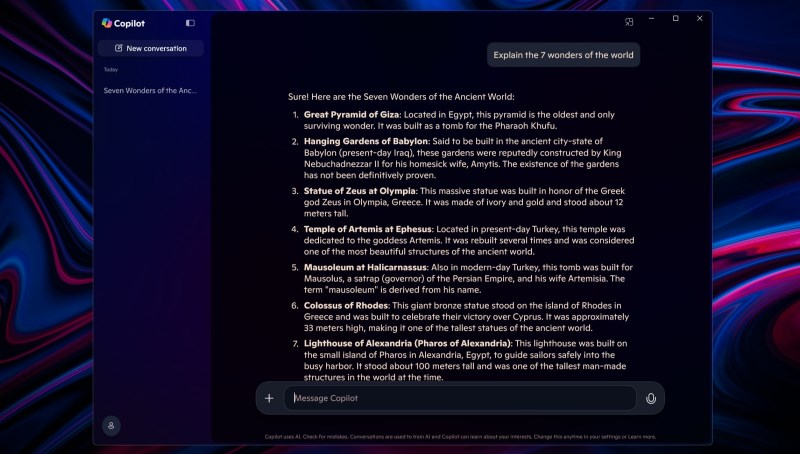

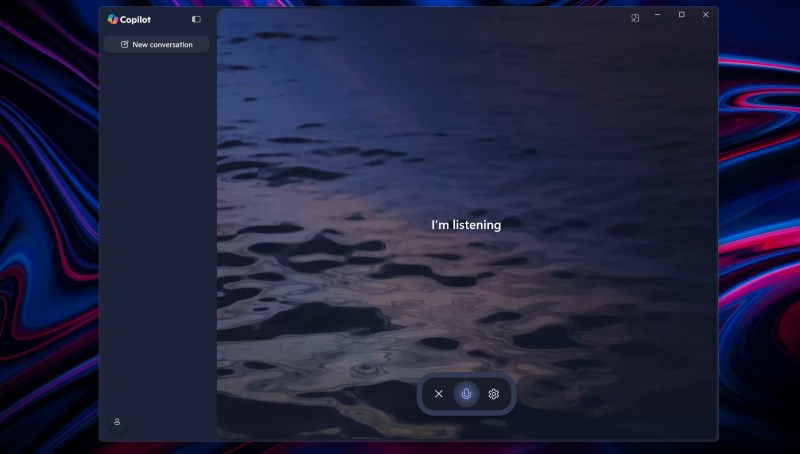

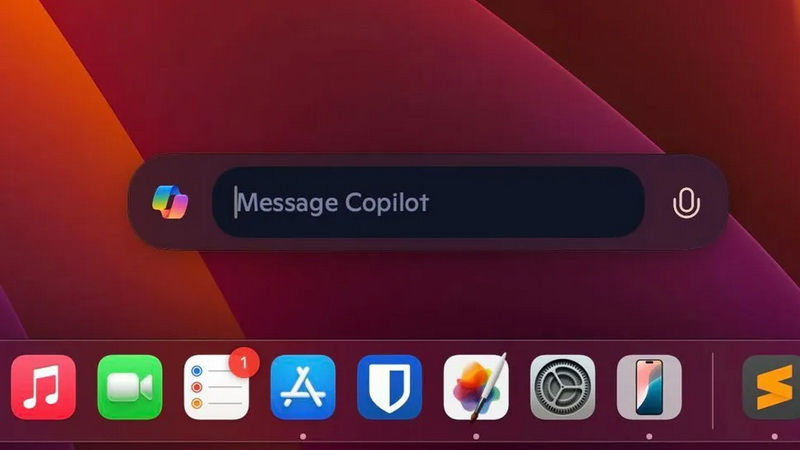

Компания Microsoft приступила к тестированию новой версии приложения Copilot для Windows 11, которое открывает доступ к фирменному ИИ-помощнику софтверного гиганта. Пользовательский интерфейс приложения теперь лучше сочетается с Window 11, он создан с использованием языка разметки XAML. Появилась боковая панель с историей чатов, нативные контекстные меню и кнопки, а также другие элементы, которые должны улучшить опыт взаимодействия пользователей с Copilot.

Источник изображений: windowscentral.com Отметим, что пару месяцев назад Microsoft объявляла о запуске новой версии Copilot для операционной системы Windows. Однако тогда оказалось, что разработчики заменили PWA-версию продукта на приложение с WebView2, т.е. по сути это была всё та же веб-версия ИИ-помощника. Теперь же Microsoft выпустила полноценное нативное приложение Copilot, которое быстрее запускается, более плавно работает и лучше выглядит. Хорошей новостью является и то, что в результате обновления приложение не лишилось каких-либо функций из числа ранее доступных. С Copilot по-прежнему можно взаимодействовать посредством текстового чата. История пользовательских чатов сохраняется в боковой панели, благодаря чему в любой момент можно продолжить работу с алгоритмом. Чтобы начать новый чат, достаточно нажать соответствующую кнопку.  Новое приложение Copilot поддерживает несколько настроек, включая автоматический запуск при загрузке Windows и включение/отключение сочетания клавиш ALT+пробел для быстрого доступа к ИИ-помощнику. Все эти опции также присутствовали в предыдущей версии приложения. Новое приложение Copilot для Windows на данном этапе стало доступным участникам программы предварительной оценки Windows Insider на всех каналах. Версия обновлённого приложения 1.25023.106.0. ИИ-функция Rewrite в «Блокноте» Windows 11 стала общедоступной

05.03.2025 [07:45],

Владимир Фетисов

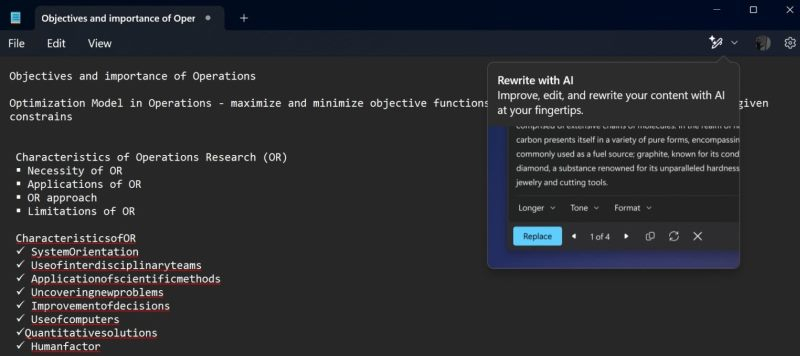

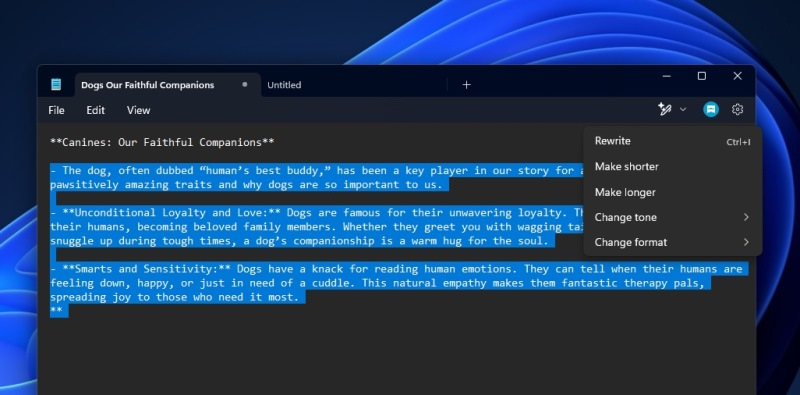

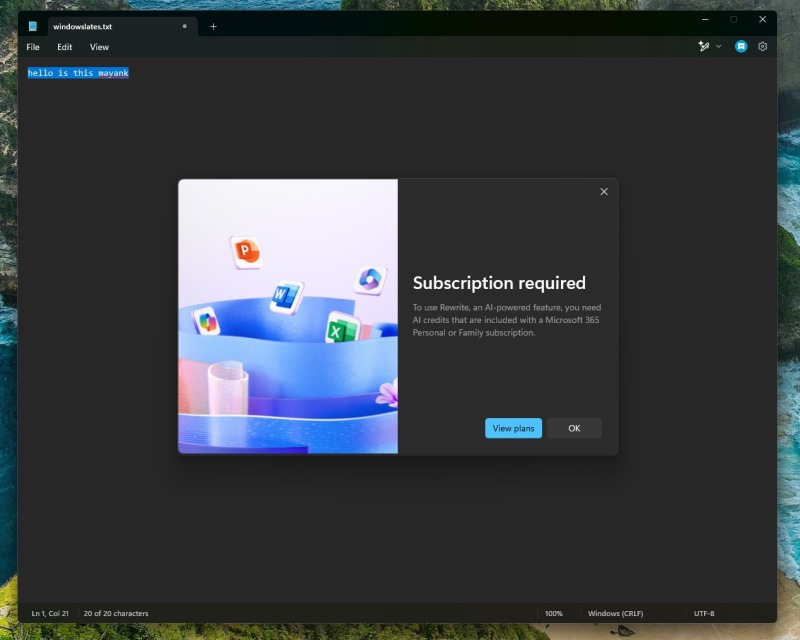

Компания Microsoft приступила к распространению обновления для простейшего текстового редактора «Блокнот» в Windows 11, которое принесёт поддержку функции редактирования текста Rewrite, построенной на базе искусственного интеллекта. Ранее упомянутый инструмент был доступен участникам программы предварительной оценки Windows Insider из США.

Источник изображений: windowslatest.com Официальная документация Microsoft указывает на то, что функция Rewrite всё ещё доступна только участникам программы Windows Insider, которые используют бета-версии Windows 11 на каналах Canary и Dev. Однако ещё в минувшие выходные компания опубликовала свежую версию «Блокнота» 11.2412.16.0, которая доступна всем желающим. Официального заявления о запуске в «Блокноте» функции Rewrite не было.  Ранее сообщалось, что основой функции Rewrite является одна из версий большой языковой модели GPT, на базе которой работает ИИ-бот ChatGPT компании OpenAI. Однако алгоритм, вероятно, был адаптирован для простого текстового редактора, поскольку он лишён возможностей ИИ-помощника Copilot, которые доступны в Word. К примеру, Copilot в Word может превращать абзацы в таблицы, обобщать содержимое, структурировать документы и др. В это же время возможности Rewrite в «Блокноте» ограничены переписыванием предложений с возможностью изменения их тона и длины.  По данным источника, пользователи, которые находятся за пределами США, Великобритании и Канады могут взаимодействовать с ИИ-функцией Rewrite в «Блокноте» без оформления подписки Microsoft 365. При этом количество запросов к алгоритму будет сильно ограничено кредитами, потратив которые, уже нельзя будет использовать Rewrite в течение месяца.  Получить максимальное количество кредитов смогут те, у кого одновременно есть подписки Microsoft 365 и Copilot Pro. При этом использовать другие функции «Блокнота», не связанные с искусственным интеллектом, можно, как и прежде, абсолютно бесплатно. Айфон по-немецки: Deutsche Telekom и Perplexity пообещали выпустить AI Phone c умелым ИИ-агентом

04.03.2025 [00:56],

Анжелла Марина

Крупнейшая в Европе немецкая телекоммуникационная компания Deutsche Telekom (DT) разрабатывает среднебюджетный смартфон AI Phone на базе искусственного интеллекта в тесном сотрудничестве с Perplexity, а также другими технологическими компаниями, включая Picsart. AI Phone сможет не только отвечать на вопросы, но и выполнять за пользователя различные действия.  Источник изображений: Deutsche Telekom Член правления Deutsche Telekom Клаудия Немат (Claudia Nemat) заявила, что компания активно трансформируется в ИИ-компанию, при этом подчеркнув, что DT не занимается созданием собственных языковых моделей, а сосредоточена на разработке ИИ-агентов. Как сообщает TechCrunch, ИИ-ассистент смартфона получит название Magenta AI. Ключевым партнёром проекта выступит стартап Perplexity, специализирующийся на генеративном поиске. Генеральный директор компании Аравинд Шринивас (Aravind Srinivas) заявил, что Perplexity, делая шаг вперёд «переходит от простой машины ответов к машине действий». По его заверениям, система сможет бронировать билеты, отправлять сообщения и даже совершать звонки от имени пользователя.  Отметим, что попытки сотовых операторов связи выйти на рынок смартфонов не так уж новы. Ранее создать альтернативу Apple и Google попыталась компания Amazon со своим первым смартфоном Fire Phone, но он не смог завоевать популярность. Однако текущая волна интереса к искусственному интеллекту определённо даёт операторам новый шанс привлечь пользователей с помощью инновационных функций. Интересно, что сотрудничество DT и Perplexity началось ещё в апреле 2024 года, а первые упоминания об стройстве AI Phone появились на крупнейшей выставке мобильных технологий — MWC 2023. Детали AI Phone пока не раскрываются, включая технические характеристики, операционную систему и производителя. Однако рендеры указывают, что смартфон, скорее всего, будет работать на модифицированной версии Android. Устройство будет представлено во второй половине 2025 года, а в продажу поступит в 2026 году по цене менее $1000. Первоначально смартфон будет ориентирован на европейский рынок, сообщили представители DT. Microsoft анонсировала медицинского ИИ-ассистента Dragon Copilot, который снимет с врачей бумажную работу

03.03.2025 [23:33],

Владимир Мироненко

Microsoft анонсировала нового ИИ-ассистента для сферы здравоохранения под названием Dragon Copilot, который, по словам компании, поможет врачам уделять больше времени пациентам благодаря сокращению объёма рутинной административной работы.

Источник изображения: Nuance Communications ИИ-помощник Dragon Copilot был создан на основе существующих решений — приложения для распознавания речи Dragon Medical One и решения для документирования беседы врача с пациентом на приёме DAX Copilot, путём объединения их возможностей. Как сообщает компания, Dragon Copilot поможет врачам быстро извлекать информацию из медицинских источников и автоматически составлять клинические заметки, рекомендации по приёму препаратов, резюме после визита пациента и многое другое. «Благодаря этой технологии врачи смогут сосредоточиться на пациенте, а не на компьютере, что позволит получать лучшие результаты и в конечном итоге повысить качество медицинского обслуживания», — заявил журналистам доктор Дэвид Рью (David Rhew), вице-президент Microsoft по глобальному здравоохранению. Согласно октябрьскому исследованию Google Cloud, врачи тратят почти 28 часов в неделю на административные задачи, такие как заполнение документации. Канцелярская нагрузка является главной причиной выгорания специалистов в сфере здравоохранения. В 2021 году Microsoft приобрела за $16 млрд Nuance Communications, компанию-разработчика решений Dragon Medical One и DAX Copilot, благодаря чему стала крупным игроком на высококонкурентном рынке ИИ-скрайбинга (распознавания и записи речи). Такие приложения, как DAX Copilot, позволяют врачам вести клинические заметки в режиме реального времени в ходе общения с пациентом. По словам Microsoft, DAX Copilot использовалось за последний месяц в ходе более чем 3 млн приёмов врачами пациентов в 600 медицинских организациях. Microsoft выпустила приложение Copilot для самых популярных ИИ ПК в мире — Apple Mac

28.02.2025 [16:16],

Николай Хижняк

Компания Microsoft выпустила цифрового ИИ-помощника Copilot в виде отдельного приложения для пользователей операционных систем macOS в США, Великобритании и Канаде. Приложение доступно в магазине приложений Mac. На данный момент Mac являются самыми распространёнными компьютерами с ИИ-функциями в мире.

Источник изображения: Tom's Hardware Для работы Copilot для macOS требуется компьютер Mac с процессором серии Apple M1 и новее, а также операционная система не старше macOS 14 Sonoma. Приложение поддерживает тёмный режим. Для него также заявлена поддержка команды быстрого доступа для активации ИИ-помощника с помощью сочетаний клавиш Command + Space, что во многом похоже на команду запуска при помощи сочетания клавиш Alt + Space в версии Copilot для Windows. Версия Copilot для iPad получит обновление с поддержкой раздельного экрана. В Copilot также можно будет входить через iPhone или iPad с помощью Apple ID. В приложение можно подгружать текстовые или PDF-файлы, задать вопросы о документах или попросить ИИ-ассистента создать по ним сводку. Функция создания сводок документов в скором времени появится и в приложении Copilot для macOS. Запуск Copilot на macOS произошёл всего через несколько дней после того, как Microsoft сделала функции Copilot Voice и Think Deeper бесплатными и с неограниченным использованием. Ранее Think Deeper (на базе модели o1 от OpenAI) и Voice в Copilot имели ограничения для бесплатных пользователей, но теперь Microsoft их убрала, чтобы позволить пользователям Copilot вести расширенные беседы с ИИ-помощником. В конце добавим, что на днях стало известно о том, что в прошлом году из всех компьютеров с ускорителями искусственного интеллекта больше половины поставила компания Apple. Так что Microsoft фактически выпустила теперь Copilot для большинства ИИ ПК в мире. Perplexity начала тестирование собственного ИИ-браузера Comet

25.02.2025 [08:17],

Анжелла Марина

Компания Perplexity, известная своим поисковым движком на основе искусственного интеллекта (ИИ), анонсировала разработку собственного веб-браузера под названием Comet. Несмотря на судебные разбирательства с издателями, Perplexity продолжает расширять линейку своих поисковых продуктов, стремясь укрепить позиции на рынке ИИ и предложить пользователям новые возможности работы в сети.

Источник изображения: Copilot Представитель Perplexity заявил изданию TechCrunch, что компания намерена «переосмыслить» концепцию веб-браузера так же, как ранее изменила подход к поиску. Однако выход на этот рынок обещает быть непростым, учитывая высокую конкуренцию со стороны таких гигантов, как Google Chrome, и множества альтернативных браузеров, многие из которых, как, например, Dia от The Browser Company, предлагают функции на базе ИИ, сопоставимые с разработками Perplexity. Perplexity надеется быстро привлечь аудиторию за счёт пользователей своего поискового сервиса и активного расширения новых продуктов, таких как инструмент для «глубокого исследования», конкурирующий с решениями OpenAI, Google и xAI, а также ИИ-ассистент для Android и API для поиска, который был выпущен в январе. Основанная в 2022 году, Perplexity уже привлекла более $500 млн венчурных инвестиций и оценивается в $9 млрд. По словам компании, её поисковый сервис обрабатывает более 100 млн запросов в неделю, а также разрабатывается инструмент монетизации с подключением рекламной платформы и другие коммерческие инициативы. Одновременно успехи компании сопровождаются юридическими проблемами. В прошлом году The New York Times направила Perplexity требование прекратить использование её контента, а недавно News Corp, Dow Jones и New York Post подали судебный иск, обвиняя компанию в «клептократии контента». Однако в Perplexity заявляют, что уважают права издателей и официально предлагают им программу разделения доходов. Бывший техдиректор OpenAI Мира Мурати запустила стартап Thinking Machines Lab, который создаст простой ИИ для людей

19.02.2025 [07:04],

Анжелла Марина

Бывший технический директор компании OpenAI Мира Мурати (Mira Murati), неожиданно покинувшая компанию прошлой осенью, открыла свой собственный стартап в области искусственного интеллекта (ИИ). Новая компания получила название Thinking Machines Lab, и хотя конкретные детали о продуктах и возможностях проекта пока не разглашаются, Мурати готова поделиться первой информацией.

Источник изображения: Copilot Thinking Machines Lab позиционирует себя как компанию, которая стремится сделать искусственный интеллект более понятным и доступным. В официальном заявлении говорится, что целью компании является создание такой ИИ-системы, которая будет широко понятна, настраиваема, универсальна и функциональна. Для достижения этой цели стартап обещает регулярно публиковать технические исследования и код, обеспечивая определённый уровень прозрачности. Как отмечает The Verge, это будет отличать проект Мурати от многих других игроков на рынке, где закрытость часто становится нормой. В пресс-релизе Thinking Machines Lab подчёркивается, что компания сфокусируется не на создании полностью автономных систем, а на продуктах, которые помогут людям взаимодействовать с искусственным интеллектом. «Мы строим будущее, где каждый сможет получить доступ к знаниям и инструментам, чтобы адаптировать ИИ под свои уникальные потребности и цели», — говорится в заявлении компании. Таким образом, можно сделать вывод, что стартап будет ориентирован на пользовательский опыт и персонализацию технологий. Для реализации своих амбициозных планов Мурати собрала команду экспертов мирового уровня. Она привлекла к проекту несколько ключевых специалистов из ведущих ИИ-лабораторий. Среди них — сооснователь OpenAI Джон Шульман (John Schulman), который занял пост главы исследований, а также Барретт Зоф (Barrett Zoph), бывший лидер OpenAI, ставший техническим директором стартапа. По данным The Verge, Шульман активно участвует в наборе команды, проводя встречи с исследователями буквально в нескольких кварталах от штаб-квартиры OpenAI. К проекту также присоединился Джонатан Лахман (Jonathan Lachman), ранее возглавлявший отдел специальных проектов в OpenAI. Perplexity запустила почти бесплатную альтернативу Deep Research от OpenAI и Google

15.02.2025 [11:07],

Анжелла Марина

Perplexity представила инструмент Deep Research, который позволяет создавать детализированные аналитические отчёты за считаные минуты. В отличие от конкурентов, сервис предлагает доступ к передовым возможностям искусственного интеллекта (ИИ) по значительно более низкой цене, что, по мнению экспертов, может перевернуть рынок ИИ-услуг.

Источник изображения: Copilot Запуск Deep Research выявил «болезненную» правду о ценообразовании в сфере ИИ. В то время как Anthropic и OpenAI взимают тысячи долларов в месяц за свои услуги, Perplexity предлагает пять бесплатных запросов в день для всех пользователей, а для подписчиков Pro доступ расширен до 500 запросов в сутки за $20 в месяц. И как пишет VentureBeat, это может вынудить крупных игроков объяснить, почему их услуги стоят в 100 раз дороже. Одновременно корпоративные расходы на ИИ продолжают расти. Так, в 2025 году ожидается увеличение затрат на 5,7 %, несмотря на общий рост IT-бюджетов менее чем на 2 %. Некоторые компании планируют нарастить траты на ИИ более чем на 10 %, что в среднем составляет $3,4 млн платежей в этой сфере. Однако с появлением Deep Research такие вложения выглядят сомнительными, поскольку Perplexity предлагает схожие возможности по цене обычной пользовательской подписки. Да и с точки зрения технологий, Deep Research показывает высокие результаты, ставя под вопрос реальную ценность дорогих ИИ-решений. Модель Perplexity продемонстрировала 93,9 % точности в тесте SimpleQA и 20,5 % в Humanity’s Last Exam, обойдя Google Gemini Thinking и другие ведущие модели. При этом в компании отмечают, что инструмент выполняет большинство задач менее чем за три минуты, анализируя сотни источников и имитируя работу профессионального исследователя. Очевидно, что запуск Perplexity Deep Research меняет не только ценовую политику, но и доступность ИИ. Ранее передовые технологии были доступны лишь крупным корпорациям, а небольшие компании и независимые специалисты не могли позволить себе подписку за тысячи долларов. Теперь же с новым инструментом Deep Research можно выполнять сложные задачи, начиная от финансового анализа и маркетинговых исследований и заканчивая технической или медицинской документацией, и всё это за приемлимые деньги. Perplexity также планирует расширить доступность Deep Research, выпустив приложения для iOS, Android и Mac, так как это, по мнению компании, поможет ускорить распространение технологии среди пользователей, которые раньше считали продвинутый ИИ недоступным. Главный европейский конкурент OpenAI выпустил ИИ-ассистента Mistral Le Chat для iOS и Android

07.02.2025 [08:34],

Анжелла Марина

Французский стартап Mistral объявил о крупном обновлении своего ИИ-ассистента Le Chat. В борьбе за внимание пользователей разработчики не только значительно улучшили веб-интерфейс, добавили веб-поиск и генерацию изображений по текстовым запросам, но и только что выпустили мобильное приложение для устройств iOS и Android.

Источник изображения: Copilot Одним из ключевых преимуществ Le Chat является скорость работы. Компания утверждает, что использует «самые быстрые на планете алгоритмы принятия решений» и её чат-бот может обрабатывать до 1000 слов в секунду. Кроме того, как пишет TechCrunch, Mistral заявляет о превосходном качестве генерируемых изображений благодаря использованию модели Flux Ultra, разработанной немецкой компанией Black Forest Labs. Разрабатывая собственные большие языковые модели (LLM), Mistral активно выпускает модели с открытым исходным кодом под лицензией Apache 2.0, а также предлагает коммерческое использование своих флагманских версий ИИ, таких как Mistral Large и Pixtral Large, через API или облачных партнёров, включая Azure AI Studio, Amazon Bedrock и Google Vertex AI. Что касается мобильного приложения, то его выпуск является стратегическим для компании шагом, направленным на повышение доступности и удобства использования ИИ-бота, которому можно задавать вопросы и получать ответы в формате интерактивного общения в чате. Отмечается, что за последние месяцы Le Chat претерпел значительные улучшения, превратившись в «компетентного ИИ-помощника». Недавно была добавлена поддержка веб-поиска с указанием источников, а также возможность генерировать изображения и взаимодействовать с платформой для редактирования текста или кода. Стоит также сказать, что компания подписала соглашение с Agence France-Presse (AFP), чтобы обеспечить надёжность и достоверность информации, предоставляемой её ИИ-моделями. Для пользователей, которым требуется больше возможностей, Mistral предлагает Pro-подписку на Le Chat стоимостью $15 в месяц. Pro-подписчики получают доступ к самой производительной модели, повышенные лимиты и улучшенную конфиденциальность. Помимо потребительского сегмента, компания активно развивает корпоративные услуги, с возможностью развёртывания Le Chat в локальной среде с использованием пользовательских моделей (ИИ-агентов) и интерфейсов. Это особенно важно для организаций, работающих в сфере обороны или финансов, где требуется повышенный уровень безопасности и контроля над данными, что, по словам Mistral, «не представляется возможным в настоящее время с ChatGPT Enterprise или Claude Enterprise». |