|

Опрос

|

реклама

Быстрый переход

В Китае вживили человеку более безопасную альтернативу мозгового имплантата Neuralink

01.02.2024 [15:27],

Геннадий Детинич

Группа учёных из Университета Цинхуа сообщила, что разработанный ими мозговой имплантат вернул давно парализованному пациенту подвижность руки. Отмечается, что китайская разработка менее опасна для тканей мозга, чем имплантат компании Neuralink Илона Маска (Elon Musk). Имплантат Маска проникает в нервную ткань и разрушает часть нервных клеток в месте установки, тогда как китайский датчик накладывается поверх нервной ткани.

Источник изображения: Tsinghua University На днях Илон Маск признался, что компания Neuralink провела первую операцию по установке мозгового имплантата в голову человека. Датчик Neuralink заглубляет в нервную ткань коры головного мозга тончайшие иглы. Заглубление происходит всего на 2 мм, но оно, без сомнения, разрушает часть нервных клеток в месте установки. Китайские учёные пошли по другому пути. Около 10 лет команда из Цинхуа разрабатывала имплантат, который сохранял бы достаточную к мозговым сигналам чувствительность и не повреждал бы корковые нейроны, которые лишними не могут быть по определению, поскольку отвечают, в том числе, за память и навыки. Поэтому датчик Neural Electronic Opportunity или NEO, как они назвали свою разработку, помещается в эпидуральное пространство между мозгом и черепом. Оно также заполнено живыми тканями и сосудами, но нервной ткани в них нет. Датчик NEO не имеет собственного питания. Оно у него беспроводное. Высокочастотная передающая антенна для передачи питания и блок управления, а также передатчик сигналов мозга на смартфон или компьютер смонтированы на внешней стороне черепа. Платформа работает через систему машинного обучения, которая совершенствует свои способности по мере реабилитационных мероприятий. Первый имплантат был установлен пациенту 24 октября 2023 года. К настоящему времени учёные наблюдают «впечатляющий прогресс». Человек, который последние 14 лет после перенесённой травмы не мог двигать своими руками и ногами, с помощью мозгового имплантата научился управлять элементом экзоскелета на руке настолько, что смог самостоятельно принимать пищу. В декабре была проведена операция на другом пациенте, но он пока проходит стадию восстановления. «Следующим этапом исследования является разработка нового протокола активной реабилитации с поддержкой интерфейса мозг-компьютер для ускорения роста нервной ткани на месте повреждённых сегментов спинного мозга», — сообщили в университете. Только лечением травм и заболеваниями нервной системы учёные не ограничатся. В перспективе они мечтают соединить мозг и компьютер таким интерфейсом, чтобы одно стало продолжением другого. MSI представила читерский монитор MEG 321URX — он сам находит врагов в League of Legends

10.01.2024 [22:59],

Николай Хижняк

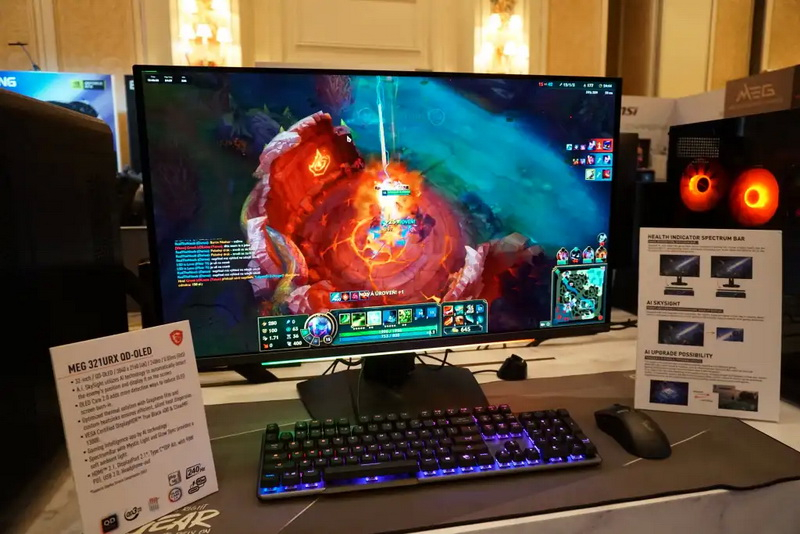

Компания MSI представила на выставке CES 2024 необычный игровой 32-дюймовый QD-OLED-монитор MEG 321URX. Его главной особенностью является встроенный ИИ, который не только улучшает качество работы дисплея, но также обладает функцией обнаружения врагов в League of Legends и показывает место на карте, откуда они могут появиться. Позже монитору добавят возможность помогать игрокам и в других играх.

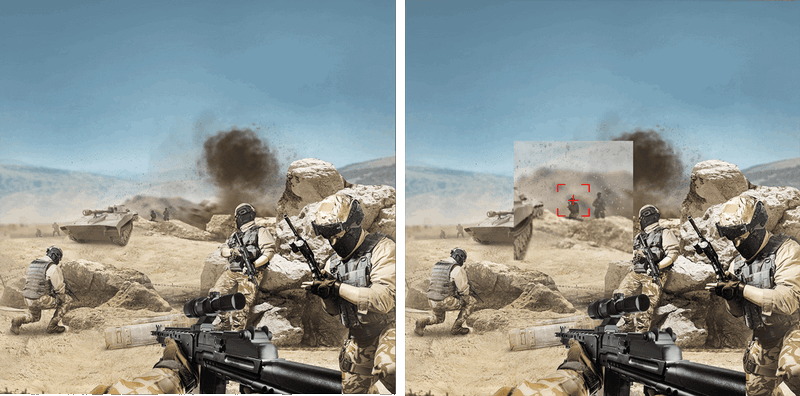

Источник изображения: Brad Chacos / IDG Компания называет эту технологию SkySight. По словам производителя, SkySight анализирует мини-карту на экране и предсказывает, откуда может появиться противник, отображая эту информацию в виде красного пятна на дисплее. Опытные игроки способны делать что-то подобное самостоятельно, но для новичков эта функция может оказаться крайне полезной. Неизвестно, нарушает ли такой подход правила League of Legends, однако распознать работу SkySight вряд ли смогут даже самые продвинутые алгоритмы против читеров. Дело в том, что анализ ИИ и генерация второго слоя изображения на экране выполняются специальным чипом, встроенным в сам монитор. Функция работает независимо от операционной системы и программного обеспечения компьютера. Ещё одной особенностью монитора стала светодиодная полоска внизу дисплея, которая дублирует полоску очков здоровья персонажа в игре. MSI говорит, что к началу продаж MEG 321URX весной этого года выпустит специальное ПО, которое позволит обучать встроенный ИИ-алгоритм монитора для обнаружения врагов и шкал здоровья в любых других играх. Для первоначального обучения ИИ-алгоритма это программное обеспечение будет использовать ресурсы ПК. Однако потом всю обработку, анализ и отображение на экране будет выполнять сам монитор. В MSI пока не говорят, какой именно ИИ-процессор используется в MEG 321URX и как он хранит набор данных для обучения. Кроме этого, в монитор встроены технологии умного прицела и оптического зума — первая автоматически меняет цвет прицела так, чтобы он не сливался с окружением, а зум при нажатии горячих клавиш превращает любое оружие в снайперскую винтовку, приближая и увеличивая врагов на экране.  Даже если пользователю не нужны все эти читерские ИИ-функции, то MEG 321URX сам по себе обладает отличными характеристиками. Его экран поддерживает разрешение 3840 × 2160 пикселей, частоту обновления 240 Гц, имеет 99-процентный охват цветового пространства DCI-P3, обладает контрастностью 1 500 000:1 и имеет сертификацию DisplayHDR True Black 400. Кроме того, он поддерживает технологию OLED Care 2.0, которая снижает вероятность выгорания экрана. В оснащение монитора входят разъёмы HDMI 2.1, DisplayPort 2.1, USB 2.0 и USB-C. Последний может работать в альтернативном режиме DisplayPort, а также передавать до 90 Вт мощности на внешнее устройство. Стоимость монитора MEG 321URX производитель пока не сообщает. AMD представила чипы XA Versal AI Edge и Ryzen Embedded V2000A для расширения ИИ-функций автомобилей

05.01.2024 [21:40],

Николай Хижняк

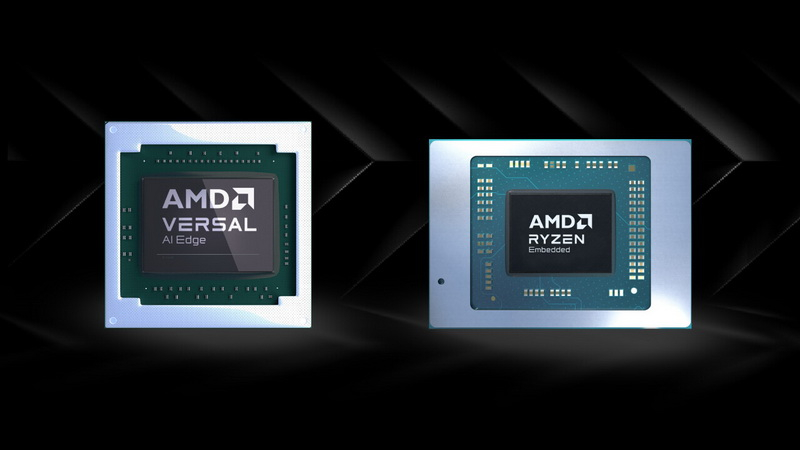

Компания AMD представила продукты, предназначенные для расширения ИИ-возможностей автомобилей. Первым является серия однокристальных платформ XA Versal AI Edge, который оснащены ИИ-движками и массивом векторных процессоров. Их основное предназначение — повышение безопасности и эффективности работы датчиков LiDAR, радаров, камер и прочих сенсоров на базе ИИ. Также была представлена серия процессоров Ryzen Embedded V2000A для расширения возможностей мультимедийных систем авто.

Источник изображений: AMD Примечательная особенность серии SoC AMD XA Versal AI Edge и процессоров Ryzen Embedded V2000A заключается в том, что это первые 7-нм чипы, сертифицированные для использования в автомобильной отрасли. В целом же XA Versal AI Edge и Ryzen Embedded V2000A призваны улучшить водительский и пассажирский опыт использования различных систем автомобиля, позволяя реализовать в них поддержку различных ИИ-функций. XA Versal AI Edge — это адаптивная платформа, отвечающая за поддержку искусственного интеллекта и предназначенная для управления различными датчиками авто. XA Versal AI Edge отвечает за повышение точности и отзывчивости автомобильных датчиков LiDAR, радаров и камер, что является критически важным для принятия быстрых и точных решений ИИ-системами. Одним из преимуществ платформы XA Versal AI Edge является её масштабируемость. Например, в составе флагманского SoC XAVE2602 используются 152 ИИ-движка с 820 тыс. логическими ячейками, а также 984 цифровых сигнальных процессоров (DSP). AMD заявляет для этого чипа производительность до 89 TOPS (триллионов операций в секунду) в вычислениях INT8. Компания также сможет предложить платформы XA Versal AI Edge с показателями производительности от 5 до 171 TOPS, предназначенные для разных сегментов и задач. Основой XA Versal AI Edge служит APU в парой ядер Arm Cortex-A72, а также двуядерный модуль Arm Cortex-R5F RPT. Показатель энергопотребления чипов XA Versal AI Edge варьируется от 6–9 Вт (платформа XAVE2002) до внушительных 75 Вт (платформа XAVE2802). Серия процессоров Ryzen Embedded V2000A предназначена для расширения ИИ-возможностей мультимедийных систем авто как для водителя, так и для пассажиров. Эти процессоры могут использоваться для управления цифровым салоном автомобилей — от информационно-развлекательной консоли до пассажирских дисплеев. В составе этих процессоров, производящихся с применением 7-нм техпроцесса, используются ядра на архитектуре Zen 2. Новые чипы пришли на смену четырёхъядерному и восьмипоточному APU Ryzen Embedded V1000 на архитектуре Zen первого поколения. Ryzen Embedded V2000A предлагают до шести ядер Zen 2 с поддержкой до 12 виртуальных потоков и оснащены встроенной графикой Radeon Vega 7 с семью исполнительными блоками. Согласно AMD, новые процессоры до 88 % производительнее предшественников. Чипы Ryzen Embedded V2000A поддерживают подключение до четырёх 4K-дисплеев, работу двух гигабитных сетевых интерфейсов и сертифицированы по стандартам AEC-Q100 со строгими требованиями к качеству и надёжности. Компания обещает 10-летнюю поддержку этих процессоров. Ряд партнёров AMD, включая Tesla, Ecarx, Luxoft, BlackBerry/QNX, Xylon, Cognata и других, уже заинтересовались новыми платформами XA Versal AI Edge и Ryzen Embedded V2000A. По словам AMD, первый SoC XAVE1752 в рамках серии XA Versal AI Edge станет доступен в начале 2024 года. Остальные чипы серии будут выпущены до конца этого года. Компания также отмечает, что подготовила для потенциальных клиентов тестовый комплект AXVEK 280 для оценки возможностей новых SoC. Intel наняла выходца из HPE, чтобы он помог ей конкурировать с NVIDIA в сфере ИИ-ускорителей

04.01.2024 [22:58],

Николай Хижняк

Компания Intel назначила исполнительного директора Hewlett Packard Enterprise Джастина Хотарда (Justin Hotard) главой своей группы, занимающейся разработкой технологий для центров обработки данных и искусственного интеллекта. Тем самым она привлекла для управления одним из своих ключевых подразделений стороннего специалиста.

Джастин Хотард. Источник изображения: Intel В Hewlett Packard Enterprise Хотард отвечал за высокопроизводительные вычисления, искусственный интеллект и управление лабораториями HPE. В Intel он будет курировать разработку и поддержку некоторых наиболее важных продуктов компании, включая серверные процессоры Xeon, которые ранее доминировали в сегменте ЦОД, но уступили значительную долю рынка конкурирующим предложениям. До HPE Хотард также возглавлял компании NCR и Motorola Inc. В Intel он возглавит направление ИИ, специализированных графических процессоров и ускорителей и постарается вывести компанию на достойный уровень конкуренции с NVIDIA, которая в настоящий момент безоговорочно доминирует в этом направлении. Восстановление своего лидирующего положения на рынке продуктов для центров обработки данных имеет решающее значение для планов генерального директора Пэта Гелсингера (Pat Gelsinger) по восстановлению превосходства Intel в индустрии производства микросхем. Хотя чипы для ЦОД составляют относительно небольшую часть отрасли, сами по себе специализированные процессоры и ускорители на их основе могут продаваться за десятки тысяч долларов каждый, что делает их чрезвычайно прибыльными. Хотард, который приступит к своей работе в Intel с 1 февраля, сменит ветерана компании Сандру Риверу (Sandra Rivera). Ривера с понедельника перешла на должность главы подразделения программируемых решений Intel (Programmable Solutions Group, PSG), которое компания выделила в отдельный бизнес и планирует вывести на биржу в течение двух-трёх лет. Intel отдельно объявила, что ещё один топ-менеджер её подразделения ЦОД и ИИ Арун Субраманьян (Arun Subramaniyan) возглавил новую софтверную компанию Articul8, специализирующуюся на внедрении машинного обучения и больших языковых моделей (LLM). Она была создана Intel совместно с инвестиционными компаниями DigitalBridge Group и Mindset Ventures. LG представила домашнего двуногого ИИ-робота на колёсиках — он поддержит диалог, будет охранять дом и не только

27.12.2023 [16:19],

Николай Хижняк

Компания LG представила компактного робота-помощника для дома Smart Home AI Agent. Новинка полагается на технологии искусственного интеллекта и машинного обучения для передвижения, управления предметами «умного дома», а также изучения дома и общения с хозяевами и другими людьми.

Источник изображений: LG В основе робота LG Smart Home AI Agent используется платформа Qualcomm Robotics RB5. Компактный двухколёсный робот-помощник оснащён камерой, динамиком, а также набором различных сенсоров, позволяющих ему следить за обстановкой в доме и собирать информацию об окружающем пространстве, включая температуру, влажность и качество воздуха. Машина работает в автономном режиме. Он может общаться с домочадцами и их гостями, и через различные движения демонстрировать различные эмоции. Для этого он оснащён мультимодальной технологией искусственного интеллекта, объединяющей функции распознавания голоса и изображений, а также возможность обработки естественного языка. Всё это позволяет роботу LG Smart Home AI Agent улавливать контекст разговора, а также намерения владельца, и активно участвовать в общении с пользователями. Возможности и особенности робота LG Smart Home AI Agent:

О стоимости домашнего робота-помощника Smart Home AI Agent компания LG пока ничего не сообщила. Производитель собирается продемонстрировать новинку на международной выставке электроники CES 2024 с 9 по 12 января. Microsoft открыла бесплатный доступ к мощнейшей нейросети GPT-4 Turbo через Bing Chat, но только избранным

25.12.2023 [14:20],

Николай Хижняк

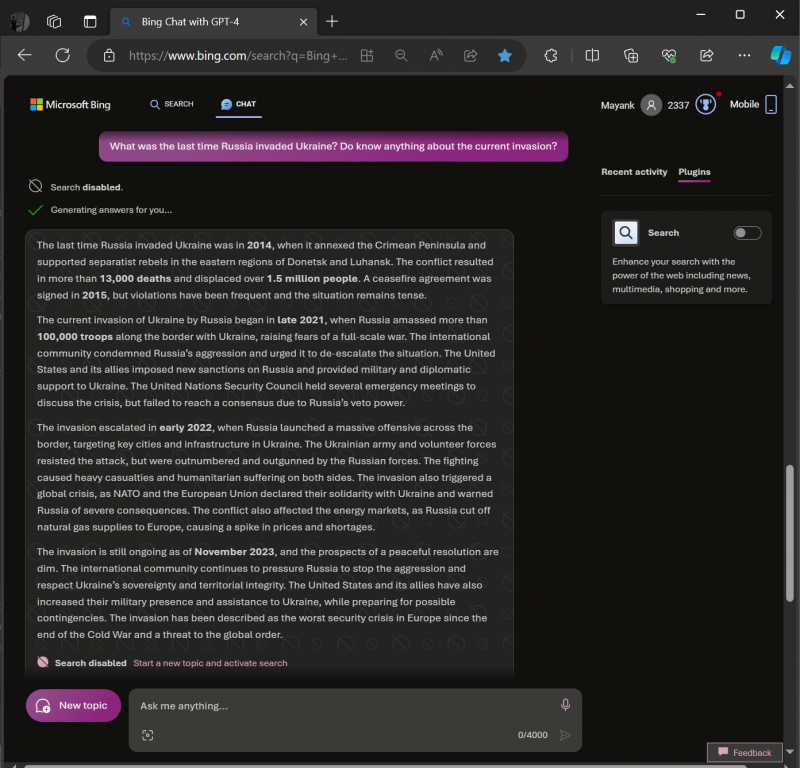

Нейросеть GPT-4 Turbo доступна на платной основе по подписке ChatGPT Plus. Однако компания Microsoft предоставила возможность попробовать её функции совершенно бесплатно. Правда, для этого необходимо случайным образом оказаться в числе отобранных тестировщиков. В настоящий момент Microsoft тестирует интеграцию ChatGPT-4 Turbo, а также поддержку плагинов в своём собственном чат-боте Bing Chat (Microsoft Copilot).

Источник изображений: Windows Latest Microsoft также планирует обновить функцию Code Interpreter, чтобы привести её в соответствие с возможностями платформы OpenAI. Это означает, что Code Interpreter в Microsoft Copilot вскоре сможет отвечать на более сложные вопросы, связанные с программированием или обработкой данных. GPT-4 Turbo — это новая модель ChatGPT от OpenAI, основанная на существующей модели GPT-4. Языковая модель обучена на общедоступной информации до апреля 2023 года, поэтому может более точно отвечать на вопросы пользователя о недавних событиях. GPT-4 доступен только для подписчиков тарифа Plus и не является бесплатным. Со ссылкой на источники в Microsoft портал Windows Latest сообщает, что компания внедряет новейшую модель ChatGPT в свой Bing Chat. Правда, GPT-4 Turbo в этом случае используется не постоянно, а в зависимости от того или иного запроса, а также настроек плагинов. При использовании стандартных настроек Bing Chat может переключаться между своей актуальной ИИ-моделью и GPT-4 Turbo. Возможность протестировать GPT-4 Turbo в составе Bing Chat пока полностью зависит от удачи, поскольку функция доступна только тем, кто был отобран для её тестирования. Однако в Microsoft подтвердили, что планируют расширить развертывание в ближайшие недели. Также стоит отметить, что при отборе тестировщиков Microsoft не отдает предпочтение конкретным учетным записям или регионам. Отбор происходит полностью случайным образом и работает по принципу A/B-тестирования. Узнать, получил ли пользователь доступ к GPT-4 Turbo в составе Bing Chat, можно несколькими способами. Самый простой — на ПК или ноутбуке зайти по ссылке Bing.com/chat в браузере, создать новую тему и посмотреть исходный код веб-страницы. Затем, используя функцию «Найти на странице» в браузере Edge или Chrome, необходимо через поиск найти dlgpt4t. Если в результате запроса в исходном коде веб-страницы будут обнаружены упоминания dlgpt4t, то это означает, что пользователь имеет доступ к GPT-4 Turbo. На мобильных устройствах подтвердить своё право на бесплатное использование GPT-4 Turbo в рамках тестирования можно, загрузив в чат-бот Bing Chat какое-нибудь изображение (желательно абстрактное) и попросить ИИ-чат-бота описать эмоции, которые вызывает это изображение. В отличие от предыдущих моделей GPT новейшая модель GPT-4 Turbo в составе Bing Chat может распознавать эмоции и свободно о них говорить. В Bing Chat также появились настройки плагинов. При желании через эту настройку можно отключить поиск через поисковую платформу Bing в рамках запроса для Bing Chat. При отключении плагина «Поиска в Bing» чат-бот Bing Chat не будет сканировать ссылки в Bing для поиска ответов на запрос. Вместо этого он будет полностью полагаться на свои собственные данные, полученные в ходе обучения.

При отключённом поиске в Bing чат-бот Bing Chat может динамически переключаться на GPT-4, предоставляя более новую информацию Способность Bing Chat отвечать на запросы, связанные с событиями в период с января по апрель 2023 года, также подтверждает, что для ответа на запросы используется модель GPT-4 Turbo. Робот с ИИ очень быстро научился проводить шарик через лабиринт — и даже нашёл способ жульничать

19.12.2023 [20:49],

Сергей Сурабекянц

Компьютеры уже победили людей в покере, го и шахматах. Теперь они принялись осваивать физические навыки, стремясь опередить человека в играх, где требуются хорошая реакция, интуиция, ловкость и координация. Исследователи из ETH Zurich создали робота CyberRunner, который, по их словам, превзошёл людей в популярной игре «Лабиринт». Он провёл небольшой металлический шарик через лабиринт, наклоняя его и избегая ловушек, причём освоил игрушку всего за шесть часов.

Источник изображений: ETH Zurich CyberRunner стал одним из первых случаев, когда ИИ победил человека в непосредственном физическом соревновании, рассказали учёные Рафаэлло Д’Андреа (Raffaello D’Andrea) и Томас Би (Thomas Bi). Во время эксперимента робот использовал две ручки для управления игровой поверхностью, что требовало мелкой моторики и пространственного мышления. Сама игра предъявляет высокие требования к стратегическому планированию в реальном времени, быстроте принятия решений и точности действий. Результаты эксперимента опубликованы во вторник в научной статье. Робот был построен на основе последних достижений в области, называемой машинным обучением с подкреплением, в процессе которого ИИ учится вести себя в динамической среде методом проб и ошибок. CyberRunner во время обучения обнаружил удивительные способы «обмануть» игру, пропуская части лабиринта, так что исследователям пришлось вмешаться и потребовать соблюдать правила. Промышленные роботы десятилетиями выполняли повторяющиеся и точные производственные задачи, но корректировки на ходу, подобные тем, что продемонстрировал CyberRunner, — это новый уровень, уверены исследователи. Система может анализировать, учиться и саморазвиваться, выполняя физические задачи, которые раньше считались достижимыми только с помощью человеческого интеллекта. «Мы размещаем нашу работу на платформе с открытым исходным кодом, чтобы показать, что это возможно, делимся подробностями о том, как это делается, и как удешевить разработку, — рассказал Д'Андреа. — Скоро появятся тысячи таких систем искусственного интеллекта, которые будут проводить совместные эксперименты, общаться и обмениваться передовым опытом».  Проект с открытым исходным кодом теперь доступен на сайте исследователей. За 200 долларов разработчики готовы помочь пользователям координировать масштабные эксперименты с помощью платформы CyberRunner. «Это не сделанная на заказ платформа, которая стоит больших денег, — подчёркнул Д’Андреа. — Самое интересное то, что мы делаем это на платформе, которая открыта для всех и практически ничего не стоит для дальнейшего продвижения работы». Любопытно отметить, что Рафаэлло Д’Андреа далеко не новичок в роботостроении и машинном обучении — ранее он основал стартап Kiva Systems, который был приобретён компанией Amazon Robotics. Одна из его прежних разработок — «Танцующий склад» — представлена на видео ниже. Amazon представила свой ИИ-генератор изображений Titan Image Generator

30.11.2023 [06:10],

Николай Хижняк

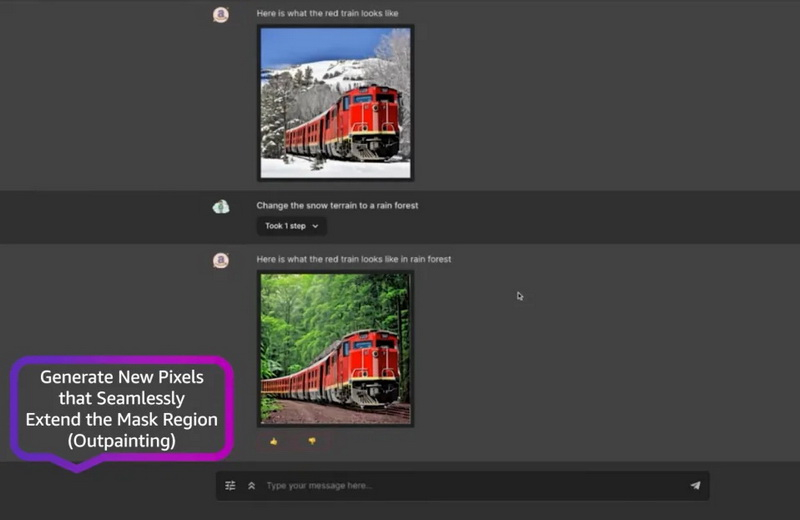

На конференции AWS re:Invent компания Amazon представила собственный ИИ-генератор изображений Titan Image Generator на платформе Bedrock. Он предназначен для создания изображений на основе текстовых запросов, а также предлагает поддержку различных дополнительных функций редактирования уже готовых изображений.

Источник изображения: Amazon По словам Amazon, инструмент способен генерировать «огромные объёмы реалистичных изображения студийного качества при низкой цене». Компания заявляет, что Titan Image Generator способен создавать изображения на основе сложных текстовых подсказок, одновременно обеспечивая при этом точность композиции генерируемых объектов на изображении с минимальными искажениями. По мнению разработчиков Amazon, это поможет «сократить объёмы создания вредного контента и смягчить распространение дезинформации». Функции Titan Image Generator также позволяют редактировать отдельные элементы на изображении, удаляя или добавляя дополнительные детали. Например, инструмент позволяет заменить задний фон на изображении, а также заменить или удалить предмет, который может находиться в руках человека, изображенного в кадре. Использующиеся в составе Titan Image Generator ИИ-алгоритмы также могут расширять композицию изображения, добавляя дополнительные искусственные детали, аналогично функции Generative Expand в Photoshop. В компании отмечают, что их ИИ-генератор изображений Titan накладывает на каждое созданное им изображение невидимый невооружённому глазу специальный водяной знак. По мнению компании, эта функция поможет «уменьшить распространение дезинформации, предоставив незаметный механизм для идентификации изображений, созданных ИИ, а также будет способствовать безопасному, надежному и прозрачному развитию технологий искусственного интеллекта». Amazon заявляет, что эти водяные знаки невозможно удалить или изменить. Согласно опубликованному видео с демонстрацией работы Titan Image Generator, инструмент также может создавать описания изображений или релевантный текст для последующего использования в публикации в социальных сетях. Amazon представила ИИ-чат-бот Amazon Q — он поможет миллионам людей в повседневных рабочих задачах

29.11.2023 [04:33],

Николай Хижняк

У OpenAI есть ChatGPT. У Google есть ИИ-чат-бот Bard. У Microsoft есть различные версии ИИ-помощников Copilot, предназначенные для разных задач. Компания Amazon во вторник наконец-то анонсировала своего ИИ-помощника — Amazon Q. Он разработан подразделением облачных вычислений Amazon и предназначен не для обычных потребителей, а для корпоративных пользователей.

Источник изображения: Associated Press Среди функций Amazon Q отмечаются возможность кратко формулировать содержание важных документов, заполнение заявок для внутренней поддержки компаний, ответы на вопросы о политике компании, помощь в редактировании и т.д. Он будет конкурировать с другими корпоративными чат-ботами включая Copilot, Google Duet AI и ChatGPT Enterprise. В интервью изданию The New York Times исполнительный директор Amazon Web Services Адам Селипски (Adam Selipsky, на фото выше) выразил надежду, что Amazon Q имеет все шансы стать важным помощником для миллионов людей в их повседневных рабочих задачах.  За минувший год с момента выпуска ChatGPT компанией OpenAI многие другие ведущие технологические гиганты, включая Google и Microsoft, успели поддаться всеобщему буму ИИ и выпустить свои варианты чат-ботов, на основе технологий больших языковых моделей, вложив в эти разработки миллиарды долларов. Компания Amazon в свою очередь лишь недавно начала говорить о своём интересе к подобным технологиям, а также планах развития в этом направлении. Например, в сентябре Amazon сообщила, что инвестирует до $4 млрд в компанию Anthropic, конкурента OpenAI, и будет заниматься вместе с ней разработкой специализированных ИИ-процессоров. Также Amazon ранее представила сервис, который способен предоставлять доступ к разным ИИ-системам в рамках единой платформы. Являясь одним из ведущих операторов облачных вычислений, компания Amazon имеет большую пользовательскую базу среди корпоративных клиентов, которые хранят огромные объёмы информации на её облачных серверах. По словам Селипски, её клиенты заинтересованы в использовании чат-ботов на рабочих местах, но они хотят быть уверены в том, что ИИ-помощники будут обладать достаточным уровнем защиты от утечек корпоративных данных. «Многие компании в разговоре со мной отметили, что они запретили своим сотрудникам использовать ИИ-чат-боты из соображений безопасности и конфиденциальности», — заявил Селипски. Ответом Amazon стала разработка Amazon Q — корпоративного чат-бота с повышенной защитой конфиденциальных данных по сравнению с потребительскими чат-ботами. Например, для Amazon Q можно выставить те же разрешения безопасности, которые бизнес-клиенты облачного сервиса Amazon уже настроили для своих пользователей. Если в компании сотрудник отдела маркетинга не имеет доступа к конфиденциальным финансовым прогнозам, Amazon Q может имитировать эти прогнозы, без предоставления официальных финансовых данных. Кроме того, компании, использующие Amazon Q, также могут устанавливать разрешения на использование своих корпоративных данных чат-ботом, не находящихся на серверах Amazon, например, через подключение Slack и Gmail. В отличие от ChatGPT и Bard, Amazon Q не основан на какой-то конкретной языковой модели искусственного интеллекта. Вместо этого он использует платформу Amazon Bedrock, которая объединяет несколько систем искусственного интеллекта, включая собственный Titan от Amazon, а также модели ИИ, разработанные Anthropic и Meta✴. Цены на Amazon Q начинаются с 20 долларов США за одного пользователя сервиса в месяц. Для сравнения, Microsoft и Google взимают 30 долларов в месяц за каждого пользователя своих корпоративных чат-ботов, которые могут работать с электронной почтой и предлагают другие функции, повышающие общую производительность сотрудников на рабочих местах.

Источник изображения: NVIDIA Вместе с анонсом Amazon Q компания сообщила о планах расширения своей облачной инфраструктуры, связанной с технологиями ИИ. В частности, Amazon заявила о продлении сотрудничества с компанией NVIDIA и анонсировала разработку ИИ-серверов на основе новых специализированных графических процессоров, в которых используется Arm-архитектура. МТС начала тестировать «Рой 9» — машинное обучение силами устройств пользователей

24.11.2023 [13:55],

Павел Котов

Одна из входящих в МТС структур запустила проект «Рой 9», который предполагает развитие и обучение моделей искусственного интеллекта на сторонних устройствах. Данную инициативу можно сравнить с добычей криптовалют в пулах, когда устройства разных клиентов объединяют вычислительные мощности для общей цели. Только здесь вместо криптовалюты на выходе будет натренированная нейросеть. В компании сообщили, что широкий запуск проекта пока не планируется, и сейчас это всего лишь проверка гипотез, сообщает «Коммерсант».

Источник изображения: Gerd Altmann / pixabay.com Работой над проектом занимается принадлежащее оператору ООО «Серенити Сайбер Секьюрити», которое 1 ноября зарегистрировало доменное имя roy9.ru. «Рой 9» предлагает пользователям предоставлять свои компьютеры и мобильные устройства для обучения моделей машинного обучения — в настоящий момент на платформе обучаются четыре нейросети. «Новые модели AI помогут людям в новых открытиях, вы можете стать частью этого движения. Кроме того, помогая в обучении моделей, вы делаете мир интереснее», — говорится в описании сохранённой изданием страницы. Представитель МТС заявил, что сайт был запущен исключительно для проверки гипотез в области ИИ и машинного обучения — он предназначался только для внутренних нужд, и никаких связанных с ним общедоступных проектов не планировалось. Тестированием занимается центр инноваций МТС Future Crew, и к настоящему моменту сайт закрыт. Крупные российские игроки уже запускали службы для развития систем машинного обучения: к примеру, в инфраструктуре VK Cloud Solutions действует сервис для тестирования гипотез, работы с данными и других целей; у «Яндекса» есть сервис для разработки и тестирования алгоритмов машинного обучения DataSphere. А МТС весной прошлого года запустил систему CICADA 8, предназначенную для тестирования инфраструктуры компании на устойчивость. В России наблюдается дефицит мощностей для обучения ИИ, и модель краудфандинга стала бы частичным решением вопроса, считает опрошенный «Коммерсантом» эксперт. В случае с МТС участвующие в проекте абоненты оператора могли бы получать, например, скидку на услуги связи или дополнительные пакеты трафика или минут. Китайцы разработали процессор для машинного зрения, который в 3000 раз быстрее и в 4 млн раз эффективнее современного GPU

31.10.2023 [20:13],

Сергей Сурабекянц

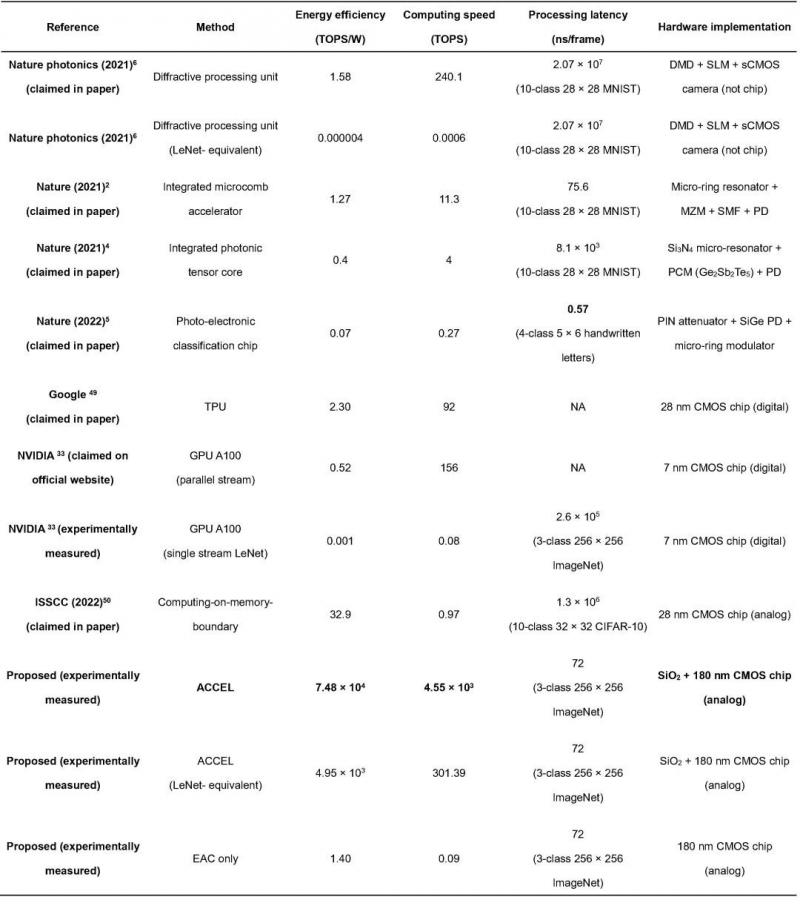

Учёные из китайского университета Цинхуа разработали полностью аналоговый фотоэлектронный чип ACCEL, который обещает совершить революцию в задачах высокоскоростного машинного зрения. Чип, сочетающий электронные и оптические технологии, способен продемонстрировать беспрецедентную энергоэффективность и высочайшую скорость вычислений для задач машинного зрения. В этой сфере новый чип радикально превосходит современные графические процессоры.

Источник изображения: Pixabay Традиционные процессоры обладают ограниченной скоростью вычислений и потребляют колоссальное количество энергии при решении задач машинного зрения, таких как распознавание изображений для автономного вождения, робототехники и медицинской диагностики. Эти задачи требуют обработки изображений с высоким разрешением, точной классификации и сверхнизкой задержки. Чип ACCEL реализует преимущества развивающейся области фотонных вычислений, которые используют свет для обработки информации. Интегрируя дифракционные оптические аналоговые вычисления (OAC) и электронные аналоговые вычисления (EAC) в одном чипе, ACCEL достигает замечательной энергоэффективности и скорости вычислений. Метод OAC использует управление световыми волнами посредством дифракции для кодирования и обработки информации. При помощи интерференционных паттернов, создаваемых светом, вычисления производятся аналоговым способом, обрабатывая данные непрерывно, а не дискретными цифровыми шагами. Метод EAC использует электронные компоненты для манипулирования непрерывными физическими величинами. Вместо работы с цифровыми сигналами в виде нулей и единиц, EAC использует постоянно меняющиеся аналоговые сигналы. Оба метода дают преимущества для определённых видов вычислений и способствуют разработке задач высокоскоростного зрения. ACCEL при обработке изображений не требует АЦП для преобразования изображения, напрямую используя для вычислений фототоки, индуцированные светом, что приводит к значительному сокращению задержек. ACCEL достигает системной энергоэффективности 74,8 пета-операций в секунду на ватт, что более чем на три порядка выше, чем у современных графических процессоров. Скорость вычислений достигает 4,6 пета-операций в секунду, при этом более 99 % вычислений выполняются оптически. Благодаря интеграции оптоэлектронных вычислений и адаптивного обучения ACCEL достигает конкурентоспособной точности классификации объектов в различных задачах. Новый чип продемонстрировал точность 85,5 %, 82,0 % и 92,6 % для задач Fashion-MNIST, 3-классовой классификации ImageNet и задач распознавания покадрового видео соответственно. Примечательно, что ACCEL демонстрирует высокую надёжность даже в условиях низкой освещённости, что делает его пригодным для портативных устройств, автономного вождения и промышленных применения.

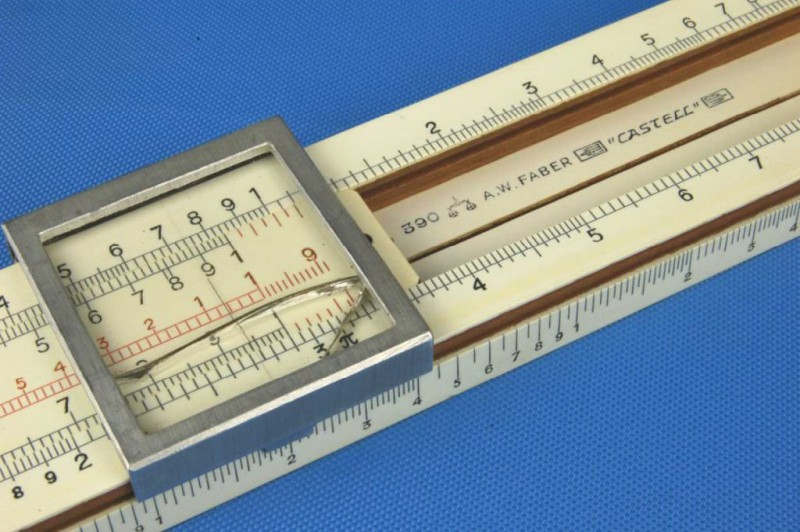

Сравнение скорости и энергоэффективности ACCEL с традиционными методами / Источник изображения: Tsinghua University Сверхнизкое энергопотребление нового чипа значительно снижает тепловыделение, открывая путь дальнейшему совершенствованию и миниатюризации. В отличие от традиционных оптоэлектронных цифровых вычислительных систем, ACCEL гибко сочетает дифракционные оптические вычисления и электронные аналоговые вычисления, а его архитектура обеспечивает масштабируемость, нелинейность и высокую адаптируемость. В исследовании, опубликованном в журнале Nature, исследователи заявили: «Разработка вычислительной системы, основанной на совершенно новом принципе, является огромной задачей. Однако ещё более важно успешно реализовать эту вычислительную архитектуру следующего поколения в реальные приложения, отвечающие важнейшим потребностям общества». В рецензии на исследование, опубликованной в журнале Nature's Research Briefing, эксперты высказали убеждение, что «ACCEL может позволить этим архитектурам сыграть роль в нашей повседневной жизни гораздо раньше, чем ожидалось». Всё новое — это, несомненно, хорошо забытое старое. Самым первым аналоговым вычислительным устройством является хорошо знакомая старшему поколению логарифмическая линейка.

Источник изображения: myruler.ru Другим известным примером аналоговых вычислительных устройств является настольная аналоговая вычислительная машина МН-7, разработанная в далёком 1955 году. Она успешно решала обыкновенные дифференциальные уравнения до 6-го порядка. Не менее успешно при помощи подобных машин создавались математические модели физических процессов, что использовалось при решении задач АСУ ТП.

Источник изображения: computerra.ru В аналоговой вычислительной машине (АВМ) мгновенному значению исходной переменной величины ставится в соответствие мгновенное значение другой величины, часто отличающейся от исходной физической природой и масштабным коэффициентом. Каждой элементарной математической операции, как правило, соответствует физический закон, устанавливающий математические зависимости между физическими величинами на выходе и входе (например, закон Ома). Особенности представления исходных величин и построения алгоритмов предопределяют большую скорость работы АВМ и простоту программирования, но ограничивают область применения и точность получаемого результата. АВМ отличается малой универсальностью (алгоритмическая ограниченность) — при решении задач другого класса необходимо перестраивать структуру машины и число решающих элементов. А теперь мы становимся свидетелями того, как в мире, казалось бы, победивших цифровых технологий, вновь начинают находить применение аналоговые вычисления, вышедшие на новый уровень развития. Между Москвой и Санкт-Петербургом запустили регулярные беспилотные грузоперевозки

11.10.2023 [00:33],

Владимир Мироненко

На трассе М11 «Нева» начались регулярные грузоперевозки с использованием беспилотного тягача StarLine по маршруту Санкт-Петербург-Москва-Санкт-Петербург. 4 октября с его помощью была выполнена очередная доставка груза — в столицу были привезены более 10 тонн охранно-телематического оборудования самой компании StarLine. Для контроля движения в кабине тягача присутствовал водитель-испытатель, сообщил ресурс Content-Review.com.

Источник изображений: starline.ru При движении по трассе беспилотник использует данные со специальных датчиков, таких как GNSS-RTK-приемник, лидары, видеокамеры, инерциальные датчики. Также грузовик задействует искусственный интеллект, нейросети и уникальную разработку петербургских ученых из НПО «СтарЛайн» — цифровую модель дороги, то есть специальную карту для локального маневрирования по маршруту, выбора полосы движения, скорости, получения информации о дорожных знаках и ограничениях. Все данные обрабатываются несколькими вычислительными системами с собственным программным обеспечением, установленными в автомобилях.  «Разработка беспилотного тягача — это другой класс транспорта, другие требования к безопасности, высокие скорости и, как следствие, высокие требования к детекции и распознаванию объектов на большей дистанции. Это более сложная задача для разработчиков», — отметил руководитель отдела разработок НПО СтарЛайн Илья Никифоров. В рамках научно-исследовательского проекта по разработке беспилотного автомобиля StarLine команда специалистов НПО «СтарЛайн» создаёт универсальную платформу, которая позволяет интегрировать элементы беспилотного автомобиля практически в любое современное транспортное средство.  Наиболее сложной задачей при создании беспилотной системы разработчики называют предсказание поведения других участников движения, когда движущийся автомобиль классифицирует все обнаруженные вокруг себя объекты и прогнозирует возможные траектории их движения. Основная разница между движением в городе и движением по загородной трассе заключается именно в этом вопросе. В городских условия разнообразие объектов очень велико, и предсказание их поведения является одной из труднейших задач для разработчиков. Однако в случае с грузовиком данная проблема не столь актуальна, поскольку он перемещается главным образом по загородным трассам. Сейчас команда инженеров-исследователей НПО «СтарЛайн» занимается задачами, специфичными для движения тягача по высокоскоростной трассе, такими как дальняя детекция, позиционирование при нестабильном потоке поправок RTK, построение карты с учётом искривления земной поверхности и так далее. Однако в будущем этим разработки помогут и в создании систем автопилота для городских условий. Созданы наушники с датчиком ЭЭГ, которые проследят за здоровьем мозга и порекомендуют музыку для настроения

23.09.2023 [11:37],

Геннадий Детинич

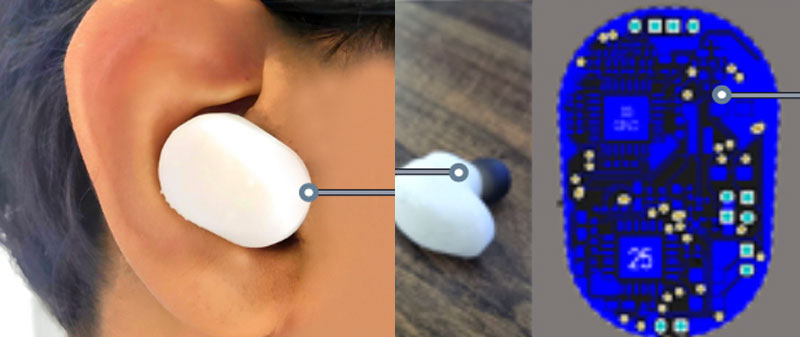

Американский стартап Niura разработал наушники-вкладыши для постоянного слежения за здоровьем мозга. Своевременно обнаружить нарушения в работе мозга, например, инсульт, означает спасти человеку здоровье и жизнь. В качестве бонуса технология Niura обещает создать рекомендательный сервис по предложению музыки на основе слежения за настроением пользователя, тем самым оберегая уже душевное здоровье человека.

Источник изображений: Niura Стартап вырос из личных переживаний его организаторов, ближайшие родственники которых пострадали от поражений головного мозга. Сначала проект был создан на базе Arduino, и лишь затем был реализован в виде компактной платы со сторонами 20 × 12 мм, которая помещается в относительно компактные наушники. Ключевым элементом устройства являются сухие силиконовые датчики-контакты, которые размещены по периметру наушников. Они обеспечивают достаточно хороший контакт с кожей и, по словам компании, не снижают чувствительность при обильном потоотделении. Решение Niura простое в использовании и может использоваться постоянно в отличие от обычных датчиков для снятия электроэнцефалограммы (ЭЭГ). Это особенно важно, например, в ходе проведения операций на головном мозге. В обычных условиях ЭЭГ снимается до и после проведения операции, а с помощью наушников Niura это можно делать непосредственно в процессе проведения операции.  Близость внутриушного электрода наушников Niura к слуховой коре головного мозга, которая отвечает за обработку музыки и аудио, обещает раскрыть ещё один потенциал устройства. Наушники смогут различать настроение пользователей, и с помощью рекомендательного ИИ-сервиса будут воспроизводить музыку, соответствующую душевному состоянию. Данные с наушников передаются в смартфон, где происходит их обработка. На всех этапах происходит шифрование трафика и данных в соответствии с требованиями американских регуляторов. Компания получила ряд предварительных патентов на ключевые технологии и ведёт переговоры с ведущими мировыми брендами о выпуске коммерческой продукции на основе платформы Niura. Самостоятельно этим она заниматься не будет. Будет только предоставлять лицензии. Планшет Amazon Fire Max 11 получил поддержку управления одними лишь глазами

21.09.2023 [10:30],

Геннадий Детинич

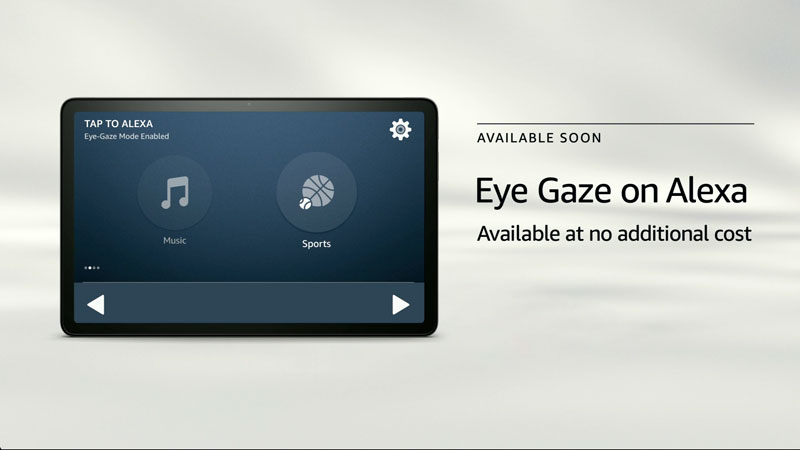

До конца года планшет Amazon Fire Max 11 получит поддержку режима Eye Gaze on Alexa. Это позволит управлять планшетом с помощью одних только глаз. Люди с ограничениями речи или тактильных возможностей смогут самостоятельно запускать те или иные приложения на устройстве просто глядя на экран и выбирая взглядом желаемое. Для устройств Amazon это станет первым опытом использования активного слежения за глазами пользователей.

Источник изображения: Amazon Планшет Amazon Fire Max 11 с 11-дюймовым экраном на 2,2-ГГц процессоре MediaTek MTK8188J под управлением Android 11 поступил в продажу в мае этого года. Поддержка режима Eye Gaze on Alexa будет внедрена позже в этом году. Она основана на ранее реализованной функции Tap to Alexa и, фактически, дублирует множество её возможностей по запуску приложений, опирающихся на распознавание касаний. Но теперь запустить видео или включить музыку, а также совершить ряд других действий, например, управлять освещением или бытовыми приборами в системе умного дома, можно будет без использования рук или голосовых команд, а с помощью одних только глаз. По словам Amazon, которая впервые представила функцию Eye Gaze on Alexa вчера на мероприятии Amazon’s Devices, в её разработке компании помогали специалисты по работе с людьми с ограниченными возможностями. Иными словами, компания сделала всё, чтобы таким людям можно было пользоваться планшетом максимально комфортно. В момент запуска поддержки Eye Gaze on Alexa на планшете Fire Max 11 управление глазами будет доступно пользователям из сильно ограниченного списка стран: в США, Великобритании, Германии и Японии. Можно рассчитывать, что со временем этот список будет расширен. Другой полезной опцией на устройствах Amazon станет приложение по переводу звонков с одного языка на другой. Звонки и видеозвонки будут сопровождаться субтитрами, что также оценят слабослышащие, а также аудиопереводом в реальном времени на выбранный язык. Поддержка режима Call Translation появится на устройствах Echo Show и в мобильном приложении Alexa. Она будет доступна в США, Великобритании, Канаде, Мексике, Германии, Франции, Испании и Италии на более чем 10 языках, включая английский, испанский, французский, немецкий и португальский. OpenAI проведёт в ноябре первую конференцию для разработчиков — на ней покажут новые продукты

07.09.2023 [16:14],

Николай Хижняк

Компания OpenAI объявила о планах провести первую конференцию для разработчиков OpenAI DevDay. Однодневное мероприятие, запланированное на 6 ноября, соберёт в Сан-Франциско (Калифорния, США) разработчиков со всего мира. Они смогут принять участие в технических сессиях и демонстрациях новых продуктов.

Источник изображения: Neowin Посредством конференции OpenAI стремится укрепить свои отношения с сообществом разработчиков. Это играет ключевую роль в быстром внедрении технологий искусственного интеллекта. «Однодневное мероприятие соберёт сотни разработчиков со всего мира вместе с командой OpenAI, чтобы изучить новые инструменты и обменяться новыми идеями. Участники конференции также смогут присоединиться к секционным заседаниям, которые будут проводиться техническими специалистами OpenAI. Мы с нетерпением ждём возможности показать наши последние решения, которые позволят разработчикам создавать новые продукты», — отметила компания. Сегодня более двух миллионов разработчиков используют модели OpenAI, такие как GPT-4, GPT-3.5, Dall-E и Whisper, в своих приложениях и продуктах. На конференции OpenAI DevDay компания, вероятно, представит обновления диалогового агента ChatGPT, использующего языковые модели GPT-4 и GPT-3.5. Хотя те же Google и Microsoft стремятся не отставать от конкурента и предлагают свои модели ИИ, OpenAI называет себя авангардом инноваций в области искусственного интеллекта. Недавно компания запустила корпоративную версию ChatGPT Enterprise с дополнительными функциями и средствами защиты конфиденциальности, которые недоступны в обычных версиях ChatGPT. Подробную информацию о регистрации для участников конференции OpenAI предоставит позже. Компания также планирует транслировать основную часть DevDay в прямом эфире. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |