|

Опрос

|

реклама

Быстрый переход

OpenAI представила флагманскую нейросеть GPT-4 Turbo — мощнее и в разы дешевле GPT-4

07.11.2023 [00:40],

Николай Хижняк

Сегодня на своей первой конференции для разработчиков компания OpenAI представила GPT-4 Turbo — улучшенную версию своей флагманской большой языковой модели. Разработчики из OpenAI отмечают, что новая GPT-4 Turbo стала мощнее и в то же время дешевле, чем GPT-4.

Источник изображения: CNET Языковая модель GPT-4 Turbo будет предлагаться в двух версиях: одна предназначена исключительно для анализа текста, вторая понимает контекст не только текста, но и изображений. Модель анализа текста доступна в виде предварительной версии через API, начиная с сегодняшнего дня. Обе версии нейросети компания пообещала сделать общедоступными «в ближайшие недели». Стоимость использования GPT-4 Turbo составляет 0,01 доллара за 1000 входных токенов (около 750 слов) и 0,03 доллара за 1000 выходных токенов. Под входными токенами понимаются фрагменты необработанного текста. Например, слово «fantastic» разделяется на токены «fan», «tas» и «tic». Выходные токены, в свою очередь, это токены, которые модель генерирует на основе входных токенов. Цена на GPT-4 Turbo для обработки изображений будет зависеть от размера изображения. Например, обработка изображения размером 1080 × 1080 пикселей в GPT-4 Turbo будет стоить 0,00765 доллара. «Мы оптимизировали производительность, поэтому можем предлагать GPT-4 Turbo по цене в три раза дешевле для входных токенов и в два раза дешевле для выходных токенов по сравнению с GPT-4», — сообщила OpenAI в своём блоге. Для GPT-4 Turbo обновили базу знаний, которая используется при ответе на запросы. Языковая модель GPT-4 обучалась на веб-данных до сентября 2021 года. Предел знаний GPT-4 Turbo — апрель 2023 года. Иными словами, на запросы, имеющие отношение к последним событиям (до апреля 2023 года), нейросеть будет давать более точные ответы. На основе множества примеров из интернета GPT-4 Turbo обучилась прогнозировать вероятность появления тех или иных слов на основе шаблонов, включая семантический контекст окружающего текста. Например, если типичное электронное письмо заканчивается фрагментом «С нетерпением жду…», GPT-4 Turbo может завершить его словами «… вашего ответа». Вместе с этим модель GPT-4 Turbo получила расширенное контекстное окно (количество текста, учитываемое в процессе генерации). Увеличение контекстного окна позволяет модели лучше понимать смысл запросов и выдавать более подходящие им ответы, не отклоняясь от темы. Модель GPT-4 Turbo имеет контекстное окно в 128 тыс. токенов, что в четыре раза больше, чем у GPT-4. Это самое большое контекстное окно среди всех коммерчески доступных моделей ИИ. Оно превосходит контекстное окно модели Claude 2 от Anthropic, которая поддерживает до 100 тыс. токенов. Anthropic утверждает, что экспериментирует с контекстным окном на 200 тыс. токенов, но ещё не внесла эти изменения в открытый доступ. Контекстное окно в 128 тыс. токенов соответствует примерно 100 тыс. словам или 300 страницам текста, что равносильно размеру романов «Грозовой перевал» Эмили Бронте, «Путешествия Гулливера» Джонатана Свифта или «Гарри Поттер и узник Азкабана» Джоан Роулинг. Модель GPT-4 Turbo способна генерировать действительный JSON-формат. По словам OpenAI, это удобно для веб-приложений, передающих данные, например для тех, которые отправляют данные с сервера клиенту, чтобы их можно было отобразить на веб-странице. GPT-4 Turbo в целом получила более гибкие настройки, которые окажутся полезными разработчикам. Более подробно об этом можно узнать в блоге OpenAI. «GPT-4 Turbo работает лучше, чем наши предыдущие модели, при выполнении задач, требующих тщательного следования инструкциям, таких как генерация определённых форматов (например, “всегда отвечать в XML”). Кроме того, GPT-4 Turbo с большей вероятностью вернёт правильные параметры функции», — сообщает компания. Также GPT-4 Turbo может быть интегрирован с DALL-E 3, функциями перевода текста в речь и зрительным восприятием, расширяя возможности использования ИИ. OpenAI также объявила, что будет предоставлять гарантии защиты авторских прав для корпоративных пользователей через программу Copyright Shield. «Мы теперь будем защищать наших клиентов и оплачивать понесённые расходы, если они столкнутся с юридическими претензиями о нарушении авторских прав», — заявила компания в своём блоге. Ранее то же самое сделали Microsoft и Google для пользователей их ИИ-моделей. Copyright Shield будет покрывать общедоступные функции ChatGPT Enterprise и платформы для разработчиков OpenAI. Для GPT-4 компания запустила программу тонкой настройки, предоставляя разработчикам еще больше инструментов для кастомизации ИИ под определённые задачи. По словам компании, в отличие от программы тонкой настройки GPT-3.5, предшественника GPT-4, программа тонкой настройки GPT-4 потребует большего контроля и руководства со стороны OpenAI, в основном из-за технических препятствий. Компания также удвоила лимит скорости ввода и вывода токенов в минуту для всех платных пользователей GPT-4. При этом цена осталась прежней: 0,03 доллара за входной токен и 0,06 доллара за выходной токен (для модели GPT-4 с контекстным окном на 8000 токенов) или 0,06 доллара за входной токен и 0,012 доллара за выходной токен (для модели GPT-4 с контекстным окном на 32 000 токенов). ChatGPT Plus получил поддержку файлов разных форматов и научился сам выбирать режимы работы

30.10.2023 [13:01],

Дмитрий Федоров

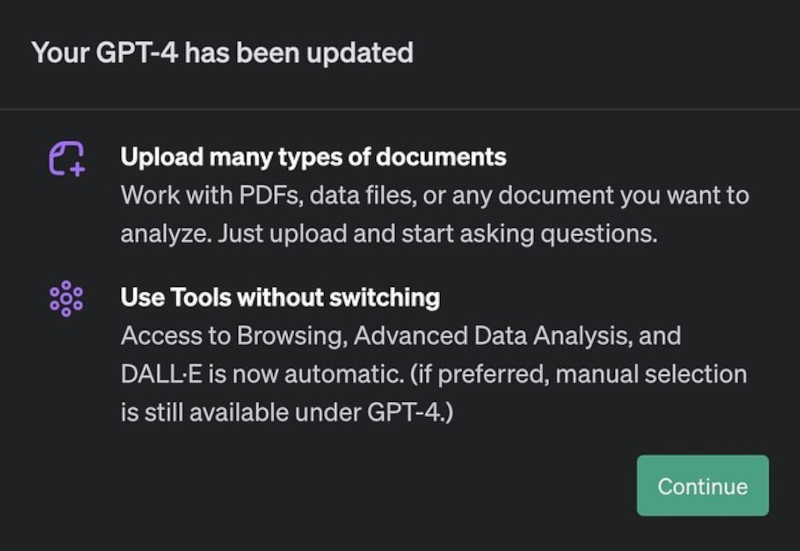

OpenAI внедрила новые бета-функции для подписчиков сервиса ChatGPT Plus. Среди ключевых нововведений — возможность загрузки и анализа файлов различных форматов, а также мультимодальная поддержка. Теперь система самостоятельно определяет, какой режим работы чат-бота является наиболее подходящим для пользователя, исходя из контекста диалога. Эти инновации делают индивидуальную подписку ChatGPT Plus функционально схожей с корпоративным планом ChatGPT Enterprise.

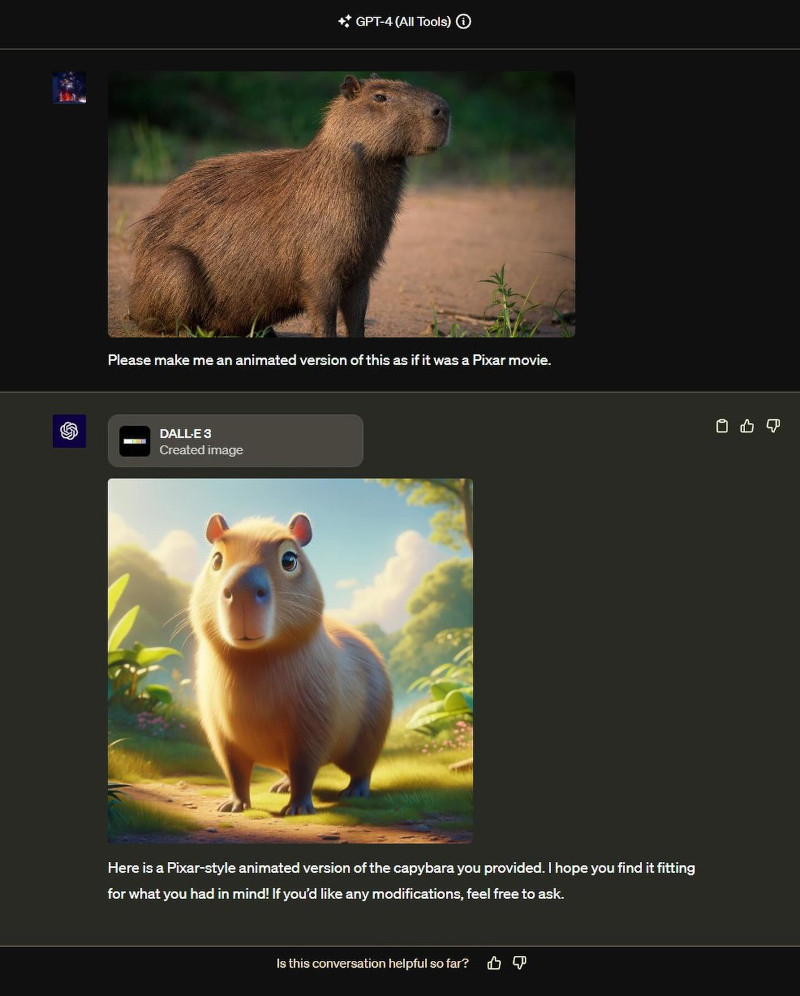

Источник изображения: ilgmyzin / unsplash.com Как было отмечено выше, обновление включает в себя возможность загрузки и обработки файлов. После передачи файла в ChatGPT чат-боту требуется несколько мгновений, чтобы обработать его, а затем он может выполнять такие действия, как обобщение данных, ответы на вопросы или создание визуализации данных на основе подсказок. Это касается не только текстовых документов, но и графических изображений. В сети Threads опубликован пример, в котором пользователь загрузил фотографию капибары и попросил ChatGPT создать на её основе изображение в стиле Pixar с использованием технологии DALL-E 3.

Источник изображения: luokai / Threads Другой важной особенностью является мультимодальная поддержка. Теперь пользователям не нужно вручную выбирать режимы работы из выпадающего списка GPT-4. Чат-бот, опираясь на контекст общения с пользователем, самостоятельно угадывает потребности пользователя. Это значительно упрощает работу с ИИ и делает использование сервиса более интуитивным.

Источник изображения: luokai / Threads Перечисленные функции, как отмечается, приближают стандартную индивидуальную подписку ChatGPT Plus к функциональности корпоративного плана ChatGPT Enterprise. В последнем, например, уже доступны функции для расширенного анализа данных и работы с большими объёмами информации. Нововведения ChatGPT Plus являются значимым шагом в улучшении пользовательского опыта и расширении функциональных возможностей сервиса. Перечисленные изменения не только делают использование чат-бота более удобным и эффективным, но и открывают новые горизонты для применения ИИ в повседневной жизни и бизнес-процессах. С учётом быстрого темпа развития технологий можно ожидать, что в ближайшем будущем нас ждут ещё более радикальные и интересные изменения в этой сфере. OpenAI открыла доступ к API языковой модели GPT-4 — самой продвинутой в своём арсенале

07.07.2023 [14:18],

Дмитрий Федоров

OpenAI открыла доступ к GPT-4, своей наиболее продвинутой языковой модели ИИ, через облачный API. Вместе с этим компания предоставила сторонним разработчикам доступ к API трёх других своих моделей ИИ. Кроме того, OpenAI объявила о своих планах постепенно отказаться от ряда более ранних нейронных сетей.

Источник изображения: OpenAI OpenAI представила GPT-4 в марте как преемника GPT-3, ИИ-модели, которая за три года до этого привлекла к компании внимание всей отрасли. GPT-4 более эффективно интерпретирует инструкции пользователя, может принимать изображения в качестве входных данных и обладает расширенными возможностями обработки поставленных задач. Последние усовершенствования позволяют модели легче выполнять сложные запросы пользователей, например, решать математические задачи. API GPT-4 позволяет разработчикам интегрировать модель в свои приложения. Сервис теперь доступен для всех клиентов, которые ранее приобрели доступ к API. Компания откроет доступ для новых разработчиков позднее в этом месяце. В дальнейшем OpenAI намерена увеличить лимиты использования API. В долгосрочные планы компании входит запуск так называемой возможности тонкой настройки, которая позволит разработчикам повысить точность GPT-4 путём обучения на пользовательских наборах данных. Вместе с API GPT-4 был открыт доступ к программному интерфейсу трёх других моделей. Первая из них — GPT-3.5 Turbo, предшественница GPT-4, которая предлагает более ограниченные возможности за значительно меньшую стоимость. OpenAI также открыла доступ к API своих моделей DALL-E и Whisper. Последние две нейронные сети оптимизированы для генерации изображений и транскрибирования речи соответственно. В связи с этим событием OpenAI также объявила о планах прекратить работу ряда ранних языковых моделей, доступных через API. Они будут отключены 4 января 2024 года. Некоторые из затронутых моделей будут автоматически обновлены до более новых продуктов OpenAI, в то время как другие потребуют от разработчиков ручного перехода. Изменения частично связаны с обновлением API. Многие из моделей, которые будут постепенно отменены, используют прикладной интерфейс программирования, который OpenAI называет Completions API. Первоначально он стал доступен в 2020 году. Например, энтузиасту, чтобы подключиться к Chat Completion API и запустить ChatGPT на 39-летнем компьютере IBM , пришлось вручную написать весь запрос POST на языке C. В марте этого года OpenAI представила новый интерфейс под названием Chat Completions API, который станет основным направлением дальнейшей разработки. «Первоначально Completions API был представлен в июне 2020 года, чтобы обеспечить текстовую подсказку свободной формы для взаимодействия с нашими языковыми моделями. С тех пор мы поняли, что часто можем обеспечить лучшие результаты с помощью более структурированного интерфейса подсказок», — сообщает OpenAI в своём блоге. Новый API Chat Completions вносит несколько улучшений. В первую очередь, он обеспечивает защиту от атак с внедрением подсказок, которые представляют собой попытки хакеров изменить вывод модели ИИ с помощью вредоносных инструкций. Это усовершенствование должно помочь разработчикам повысить безопасность своих приложений на базе OpenAI. Продвинутые инструменты OpenAI и их растущая доступность открывают новые возможности для разработчиков и исследователей по всему миру. Однако как и с любыми новыми технологиями, важно использовать их ответственно и с учётом возможных рисков. OpenAI продолжает работать над улучшением своих моделей и сервисов, стремясь обеспечить безопасность и эффективность их использования. На OpenAI подали в суд за незаконное использование литературных произведений для обучения нейросетей

30.06.2023 [15:35],

Дмитрий Федоров

На OpenAI снова подали в суд за использование произведений для обучения ИИ. Два известных писателя подали иск против компании, которая стоит за ChatGPT и Bing Chat, в нарушении авторских прав. По их мнению, OpenAI использовала их произведения в качестве обучающих данных. Это, по всей видимости, первый поданный иск об использовании текста (в отличие от изображений или кода) в качестве обучающих данных.  В поданном в окружной суд Северного округа Калифорнии иске истцы Пол Тремблей (Paul Tremblay) и Мона Авад (Mona Awad) утверждают, что OpenAI и её дочерние компании нарушили авторские права, нарушили Закон об авторском праве в цифровую эпоху (DMCA), а также нарушили калифорнийские и общие законодательные ограничения на недобросовестную конкуренцию. Писатели представлены юридической фирмой Джозефа Савери (Joseph Saveri) и Мэттью Баттерика (Matthew Butterick), той же командой, которая стоит за недавними исками, поданными против Stable Diffusion AI и GitHub. В жалобе утверждается, что роман Тремблея «Хижина на краю света» и два романа Авад: «13 способов посмотреть на толстую девушку» и «Зайка» использовались в качестве обучающих данных для GPT-3.5 и GPT-4. Хотя OpenAI не раскрывала, что эти романы находятся в её обучающих данных (которые держатся в секрете), истцы делают вывод, что они должны быть там, поскольку ChatGPT смог предоставить подробные резюме сюжетов и ответить на вопросы о книгах, что потребовало бы доступа к их текстам. «Поскольку языковые модели OpenAI не могут функционировать без выразительной информации, извлечённой из произведений истцов (и других лиц) и сохранённой в них, языковые модели OpenAI сами являются нарушающими авторские права производными произведениями, созданными без разрешения истцов и в нарушение их исключительных прав по Закону об авторском праве», — говорится в жалобе. Все три книги содержат информацию о защите авторских прав (CMI), такую как ISBN и номера регистрации авторских прав. Закон об авторском праве в цифровую эпоху (DMCA) утверждает, что удаление или фальсификация CMI является незаконной, и поскольку ответы ChatGPT не содержат этой информации, истцы утверждают, что OpenAI виновна в нарушении этого закона, помимо факта нарушения авторских прав. Хотя в настоящее время в иске участвуют только два истца, адвокаты намерены сделать иск коллективным, что позволило бы другим авторам, чьи авторские произведения использовались OpenAI, также получить компенсацию. Адвокаты требуют денежных возмещений, судебных издержек и судебного запрета, принуждающего OpenAI изменить своё программное обеспечение и деловые практики в отношении авторских материалов. На сайте юридической фирмы LLM Litigation подробно изложена позиция истцов и причины подачи иска. «Мы подали коллективный иск против OpenAI, обвиняя ChatGPT и его базовые большие языковые модели, GPT-3.5 и GPT-4, в том, что они перерабатывают авторские произведения тысяч писателей — и многих других — без согласия, компенсации или признания», — сообщают адвокаты. Они также критикуют концепцию генеративного ИИ, утверждая: «Генеративный искусственный интеллект — это просто человеческий интеллект, переупакованный и проданный как новый продукт. Это не новый вид интеллекта. Это просто новый способ использования чужого интеллекта без разрешения или компенсации». Они отмечают, что, хотя OpenAI заявляет, что не знает, какие именно книги использовались для обучения ИИ, это не имеет значения, поскольку: «OpenAI знает, что она использовала множество книг, и она знает, что она не получила разрешения от их авторов». Это не первый случай, когда OpenAI сталкивается с подобными обвинениями. Однако новый иск, станет первым, затрагивающим использование текстовых данных, и он может создать прецедент для будущих судебных дел о нарушении авторских прав в области ИИ. OpenAI обновила GPT-3.5-turbo и GPT-4 новыми функциями и снизила стоимость их использования

14.06.2023 [13:33],

Владимир Фетисов

По мере роста конкуренции в сфере генеративных нейросетей один из лидеров направления в лице OpenAI представил обновлённые версии алгоритмов генерации текста, а также снизил стоимость их использования. Компания выпустила обновлённые версии языковых моделей GPT-3.5-turbo и GPT-4, которые обеспечат ещё больше возможностей для создания контента по сравнению с предыдущими версиями языковых моделей стартапа.

Источник изображения: Pixabay Одним из любопытных нововведений стало появление инструмента, позволяющего разработчикам описывать программные функции естественным языком и получать полноценный код для их выполнения. Например, данный инструмент подходит для создания чат-ботов, которые отвечают на вопросы, вызывая внешние инструменты, преобразовывая естественный язык в запросы к базам данных и извлекая структурированные данные из текста. Обе модели способны определять, когда функция должна быть вызвана и отвечать в формате JSON, который соответствует сигнатуре функции. Это нововведение также позволит разработчикам получать более точные и структурированные данные. Вместе с этим модель GPR-3.5-turbo получила расширенное контекстное окно (количество текста, учитываемое в процессе генерации). Увеличение контекстного окна позволяет модели лучше понимать смысл запросов и выдавать более соответствующие им ответы, не отклоняясь от темы. Модель GPR-3.5-turbo имеет контекстное окно в 16 тыс. токенов, что в четыре раза больше по сравнению с аналогичным показателем GPT-3.5. Также было объявлено, что в настоящее время OpenAI тестирует модель GPT-4 с контекстным окном в 32 тыс. токенов. Стоимость использования стандартной версии GPT-3.5-turbo (без расширенного контекстного окна) снижена на 25 % до $0,0015 за 1 тыс. входных токенов и $0,002 за 1 тыс. выходных токенов, что соответствует примерно 700 страницам текста за $1. Стоимость использования модели text-embedding-ada-002, которая позволяет измерить сходство текстов, снижена на 75 % до $0,0001 за 1 тыс. токенов. Microsoft предложила GPT-модели компании OpenAI государственным органам США

08.06.2023 [08:48],

Руслан Авдеев

Компания Microsoft предложила большие языковые модели (LLM), разработанные компанией OpenAI, федеральным ведомствам США, пользующимся облачными сервисами Azure. Об этом компания объявила в официальном блоге.

Источник изображения: Josh Riemer/unsplash.com Как сообщает Reuters, Microsoft добавила в облаке Azure Government поддержку как GPT-3, так и новейших и сложнейших вариантов LLM, стоящих за мультимодальной моделью GPT-4. Бум использования LLM наблюдается с тех пор, как компания OpenAI, поддерживаемая Microsoft и во многом находящаяся под контролем последней, представила вариант ChatGPT с невиданными ранее характеристиками «общительности» — чат-бот способен поддерживать вполне «осмысленный» диалог, и теперь бизнесы всех размеров — от стартапов до крупных корпораций — пытаются представить сопоставимые решения и схожие функции в своих сервисах. Microsoft впервые предоставляет GPT-технологии в облаке Azure Government, обеспечивающем сервисы многим государственным ведомствам Соединённых штатов — это первая известная попытка крупных компаний предоставить услугу подобного рода государственным структурам. Впрочем, Microsoft уже предлагает подобную функциональность коммерческим пользователям Azure, обеспечивая доступ к Azure OpenAI Services. По данным на май 2023 года, имелось уже 4,5 тыс. клиентов. В Microsoft заявили, что государственные клиенты могут давать ИИ различные задачи, включая генерацию контента, преобразование текстовых команд в программный код или, например, составление резюме объёмных материалов. Стоит отметить, что сервисы на основе LLM до сих пор могут страдать от «галлюцинаций» и давать откровенно неверные ответы, а эксперты и лидеры отрасли неоднократно предупреждали об опасности ИИ и необходимости регулирования подобных разработок и решений и даже назвали свои продукты угрозой, сравнимой с пандемией и ядерной войной. OpenAI пригрозила судом популярному проекту GPT4free из-за бесплатного использования GPT4 обходными путями

30.04.2023 [19:56],

Владимир Мироненко

Для доступа к новейшей языковой модели GPT4 необходимо или оформить платную подписку ChatGPT Plus, либо заплатить за доступ к API OpenAI. Но есть и проект ресурса GitHub под названием GPT4free, который предоставит доступ к моделям GPT4 и GPT3.5 без надобности платить за API. Xtekky, студент-компьютерщик, который управляет репозиторием, сообщил, что получил письмо OpenAI с требованием закрыть проект в течение 5 дней под угрозой судебного разбирательства.

Источник изображения: Andrew Neel/unsplash.com GPT4free позволяет пользователям получить бесплатный доступ к моделям GPT4 и GPT3.5, направляя эти запросы через такие сайты, как You.com, Quora и CoCalc, и предоставляя ответы. Проект стал самым популярным новым репозиторием GitHub, собрав на минувшей неделе 14 тыс. звёзд. Xtekky сообщил ресурсу Tom’s Hardware, что не думает, что OpenAI должна была выставлять требования к нему, поскольку GPT4free не подключается напрямую к её API, а вместо этого получает данные с других сайтов, которые оплачивают собственные лицензии на доступ к GPT. Если у владельцев этих сайтов возникли проблемы с его скриптами, запрашивающими их, они должны обратиться к нему напрямую, заявил автор проекта. Помимо You.com, Quora и CoCalc, в репозитории GPT4Free также есть скрипты для сбора данных с других сайтов, таких как Forefront и TheB. Любой разработчик может использовать эти простые скрипты для создания собственного бота. Все сайты, с которыми работает GPT4Free, платят лицензию OpenAI за использование его больших языковых моделей (LLM). Xtekky сказал, что готов удалять сценарии, использующие API отдельных сайтов, по запросу владельцев этих сайтов, добавив, что уже удалил скрипты, использующие phind.com, ora.sh и writesonic.com. Он отметил, любой из этих сайтов может блокировать внешнее использование своих внутренних API с помощью общих мер безопасности, например блокировать обращения к API с чужих IP-адресов. Xtekky заявил, что не считает себя ответственным за то, как другие используют его проект, и что OpenAI не должна преследовать его за использование API других сайтов, которые находятся в открытом доступе. Он также сообщил, что пока не решил, удалять ли свой GitHub-репозиторий, и обратился к юристам за консультацией. Разработчик подчеркнул, что любой может найти способы использовать API вышеуказанных сайтов, поскольку они по-прежнему не защищены. Уязвимость в GPT-4 открыла неограниченный бесплатный доступ к нейросети

26.04.2023 [14:06],

Павел Котов

Разработчик под ником xtekky представил проект GPT4Free — набор инструментов, предоставляющих бесплатный и почти неограниченный доступ к чат-боту на базе GPT-4 и его предшественнику GPT-3.5. Эксплойт был разработан методом обратного проектирования, которое помогло обнаружить уязвимость в API нейросети.

Источник изображения: D koi / unsplash.com Базовый тариф GPT-4 составляет $0,03 за 1000 токенов «подсказок» (примерно 750 слов) и $0,06 за 1000 токенов «завершения» (также около 750 слов). Доступ к GPT-3.5 обходится дешевле — $0,002 за 1000 токенов. Эксплойт GPT4Free не обходит механизмы платного доступа к платформе OpenAI, а «обманывает» API, заставляя платформу считать, что запросы поступают от ресурсов, к которым привязаны платные учётные записи: поисковой системы You.com, платформы для написания текстов WriteSonic и чат-бота Quora Poe. В свою защиту разработчик заявляет, что GPT4Free предназначен для работы только в «образовательных целях». Он также заявил, что будет пытаться продолжить работу над проектом, даже если его попробуют засудить. По всей вероятности, оказавшиеся жертвами GPT4Free ресурсы в обозримом будущем ликвидируют бреши безопасности и закроют доступ для инструмента — исходный код проекта может удалить и GitHub, но это только подстегнёт его последователей. Доступ к нейросети GPT-4 пока ограничен, и это затрудняет возможность её испытать для всех любопытствующих. Эксперты называют её одной из наименее прозрачных разработок OpenAI, и компания до сих пор не сообщила, когда платформа появится в открытом доступе. Не исключено, что впоследствии OpenAI придётся активно отбиваться от «пиратских» попыток добраться до ресурсов нейросети. |