|

Опрос

|

реклама

Быстрый переход

«Наши GPU плавятся»: ажиотаж вокруг нового генератора картинок в ChatGPT заставил OpenAI ввести ограничения

27.03.2025 [22:21],

Владимир Мироненко

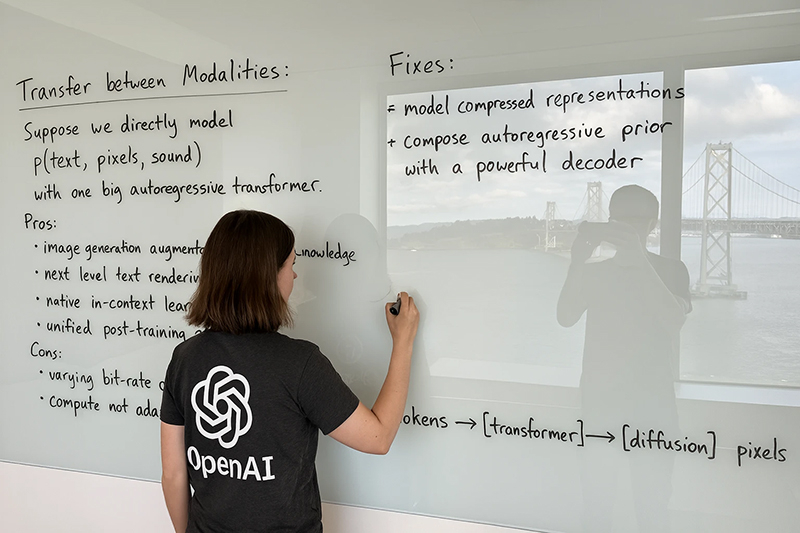

Представленная на днях функция 4o Image Generation генерации качественных изображений вызвала огромный интерес у пользователей. Ажиотаж даже вынудил OpenAI «временно» ограничить частоту отправки запросов на генерацию изображений, сообщил в соцсети X гендиректор компании Сэм Альтман (Sam Altman). «Очень забавно наблюдать, как людям нравятся изображения в ChatGPT, но наши графические процессоры плавятся», — отметил он в своём сообщении.

Источник изображения: OpenAI Альтман не уточнил, какой предел скорости был установлен, лишь выразив надежду, что это ограничение не понадобится надолго, поскольку OpenAI пытается повысить эффективность обработки огромного числа запросов. Высочайший спрос уже заставил компанию отсрочить запуск обновлённого генератора изображений на базе GPT-4o для бесплатных пользователей ChatGPT — Альтман ранее пообещал, что бесплатные пользователи «скоро» смогут генерировать с его помощью до трёх изображений в день. Но, по-видимому, этого оказалось недостаточно, чтобы как-то снизить нагрузку на инфраструктуру OpenAI. Улучшенный инструмент генерации изображений использует мультимодальную большую языковую модель GPT-4o. Получающиеся с его помощью изображения выглядят качественно, более реалистично и лучше соответствуют запросам. Также имеются успехи в преодолении прошлых проблем, например, с отображением текста. В интервью ресурсу The Verge представитель компании назвал улучшение генерации как «шаговое изменение» по сравнению с предыдущими моделями. Тем не менее возникшие проблемы служат напоминанием о том, сколько технической мощности и энергии требуется для реализации функции генерации изображений в ChatGPT, отметил The Verge. Microsoft вынашивает идею разработки собственного мощного ИИ

27.03.2025 [15:19],

Алексей Разин

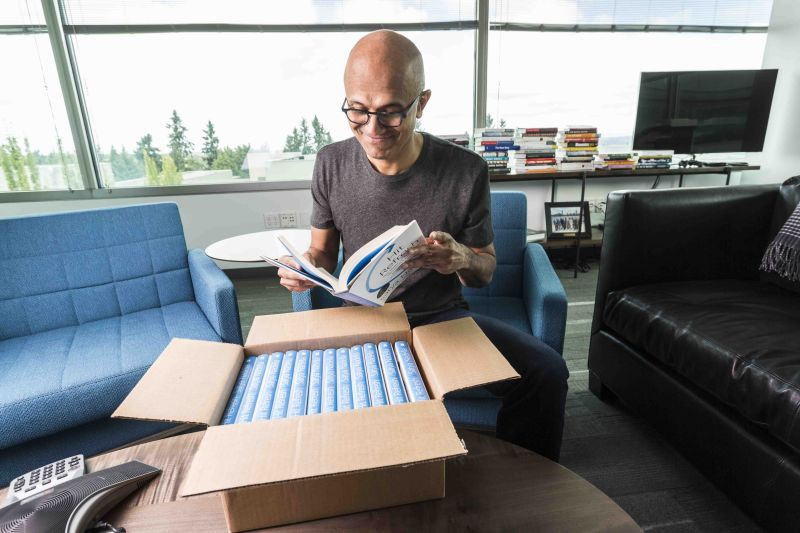

Выступающая в роли крупнейшего инвестора OpenAI корпорация Microsoft до сих пор предпочитала полагаться на возможности больших языковых моделей первой и её же чат-бота ChatGPT, но в дальнейшем не исключена возможность создания собственных производительных систем искусственного интеллекта, как дал понять генеральный директор Сатья Наделла (Satya Nadella).

Источник изображения: Microsoft Соответствующие заявления он сделал в интервью группе японских журналистов во время своего визита в Токио, как сообщает Nikkei. По мнению главы Microsoft, создание собственной платформы для искусственного интеллекта позволит оптимизировать работу с программным обеспечением корпорации для корпоративных клиентов. «Мы построим свои собственные возможности для дополнения всего того, что мы делаем с OpenAI», — заявил Наделла. Внедрять собственный ИИ в приложения и сервисы для корпоративного сегмента Microsoft будет в том случае, если поймёт, что он будет полезен для потребителей. Microsoft не только адаптирует решения OpenAI к своей программной инфраструктуре. Компания расширит команду разработчиков приложений для искусственного интеллекта, и ожидается, что со временем её собственные разработки в этой сфере не будут уступать передовым решениям OpenAI. «Мы все будем подчиняться реальному спросу. То, куда пойдёт ИИ, будет зависеть исключительно от происходящего с мировым ростом ВВП», — пояснил глава Microsoft стратегию инвестиций в сферу искусственного интеллекта. В прошлом году Microsoft открыла в Японии первый исследовательский центр, связанный с разработкой ИИ для робототехники и автомобилей. Корпорация полна готовности глубоко сотрудничать с японскими компаниями и разработчиками, использующими открытый исходный код. Наделла считает, что использование единых стандартов в сфере безопасности ИИ пойдёт на пользу всем и сократит возможные издержки, связанные с рисками. OpenAI рассчитывает более чем утроить выручку в этом году, а затем удвоить её в следующем

27.03.2025 [04:46],

Алексей Разин

Занимающая лидирующие позиции на рынке систем генеративного искусственного интеллекта компания OpenAI номинально остаётся стартапом, её финансовая отчётность официально не публикуется, поэтому приходится получать данные из неофициальных источников. Они гласят, что в текущем году выручка OpenAI вырастет более чем в три раза.

Источник изображения: OpenAI В прошлом году, по имеющимся у Bloomberg данным, выручка компании не превысила $3,7 млрд, но в этом прогнозируется её рост до $12,7 млрд. В следующем году темпы роста замедлятся, но выручка всё равно увеличится более чем в два раза до $29,4 млрд. По данным на сентябрь прошлого года, OpenAI на тот момент рассчитывала выручить в 2025 году только $11,6 млрд. OpenAI несёт огромные расходы на развитие вычислительной инфраструктуры и расширение штата сотрудников, поэтому на окупаемость она рассчитывает выйти не ранее 2029 года, когда её выручка достигнет $125 млрд. Значительную часть дохода компания получает от подписчиков ChatGPT. Корпоративной версией чат-бота по состоянию на сентябрь прошлого года пользовался миллион человек. Сейчас для доступа к самым продвинутым языковым моделям OpenAI пользователи должны отдавать по $200 в месяц. Кроме того, руководством компании обсуждается возможность введения тарифного плана, подразумевающего абонентскую плату в размере нескольких тысяч долларов в месяц. Капитализация OpenAI оценивается в $300 млрд, но чтобы привлечь больше инвесторов, она должна изменить организационную структуру, поскольку сейчас ею командует некоммерческая организация. OpenAI решила попридержать запуск 4o Image Generation для бесплатных пользователей

27.03.2025 [04:24],

Анжелла Марина

Компания OpenAI вынуждена перенести сроки предоставления доступа к встроенному генератору изображений в ChatGPT для пользователей бесплатной версии. Сэм Альтман (Sam Altman) в своём сообщении признал, что новый инструмент 4o Image Generation оказался популярнее, чем ожидалось, поэтому развёртывание для бесплатного использования будет отложено на некоторое время, сообщает The Verge.

Источник изображения: OpenAI Новый ИИ-генератор изображений был интегрирован в ChatGPT буквально на днях. С его помощью можно создавать картинки непосредственно в приложении, используя новейшую модель рассуждений GPT-4o. Функция так понравилась пользователям, что они уже вовсю стали делиться в социальных сетях изображениями, в частности, стилизованными под работы студии Ghibli, — тренд, к которому присоединился даже сам Альтман. По словам разработчиков, 4o Image Generation отличается улучшенным рендерингом текста и использует для генерации изображений так называемый авторегрессионный подход, когда изображение создаётся последовательно, слева направо и сверху вниз, а не одномоментно целиком, что позволяет создавать картинки без каких-либо ошибок или искажений в тексте, чего раньше добиться в других генераторах не удавалось. В настоящее время доступ к функции имеют только подписчики платных тарифов ChatGPT Plus, Pro и Team. Когда именно пользователи бесплатной версии смогут опробовать новый ИИ-генератор, пока не совсем ясно из-за неожиданно высокого спроса на эту функцию. OpenAI представила функцию генерации точных изображений в ChatGPT на базе GPT-4o — она доступна бесплатно

26.03.2025 [01:03],

Анжелла Марина

OpenAI встроила функцию генерации точных изображений непоcредственно в ChatGPT. Новая функция, именуемая 4o Image Generation, опирается на мультимодальную большую языковую модель GPT-4o. Она понимает контекст, сложные инструкции, взаимодействия объектов и даже генерирует текстовые надписи без артефактов. Доступ для всех откроют сегодня.

Источник изображений: OpenAI ChatGPT и прежде умел генерировать изображения с помощью нейросети Dall-E 3. Однако обновлённая функция работает куда лучше и точнее. Представитель OpenAI Тайя Кристиансон (Taya Christianson) уточнила, что лимиты для бесплатных пользователей останутся такими же, как у DALL-E, то есть три изображения в день. Доступ к DALL-E по-прежнему возможен через пользовательский интерфейс ChatGPT. Как отметил глава исследований Габриэль Го (Gabriel Goh), использование GPT-4o позволяет ИИ работать с любыми типами данных — текстом, изображениями, аудио и видео. Кроме того, Sora получила ключевое улучшение, заключающееся в корректном соотношении атрибутов и объектов (binding). Го объяснил, что большинство ИИ путаются при обработке 5–8 элементов. Например, ИИ может получить запрос нарисовать синюю звезду и красный треугольник, но создать красную звезду и нечто отличное от треугольника. 4o Image Generation справляется с 15–20 объектами без ошибок.  Пользователи также заметят улучшение в отрисовке текста, что позволяет генерировать на изображениях читаемый текст без опечаток. В существующих инструментах для генерации изображений текст часто искажался и достижение качественного рендеринга в этом смысле было серьёзной проблемой, так как даже небольшие ошибки в заголовках или текстовых элементах могут сделать всё изображение полностью непригодным.

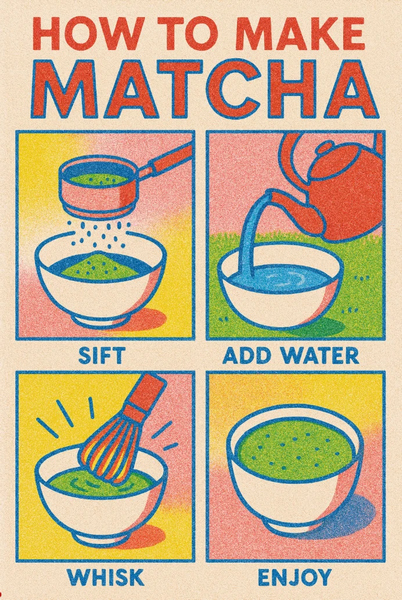

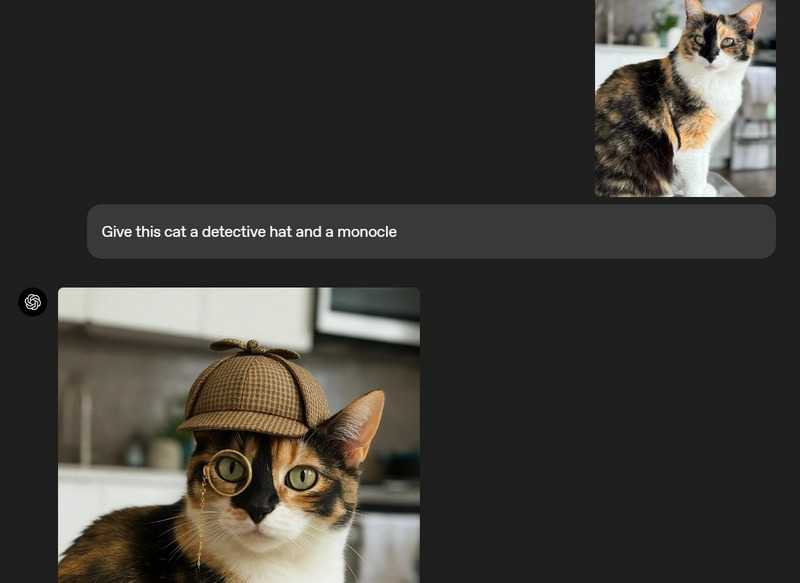

Генерация по запросу «Cделай очень красочную ризографию о том, как приготовить матча» (make a very colorful risograph on how to make matcha) Система также использует теперь нестандартный метод генерации. Изображения создаются последовательно, слева направо и сверху вниз, а не целиком, как это происходит в DALL-E. По мнению Го, это объясняет превосходство 4o Image Generation в работе с текстом и сложными сценами.  OpenAI продемонстрировала возможности 4o Image Generation на научных диаграммах, например, эксперимент Ньютона с призмой, комиксах и постерах. Также были показаны практические применения в создании изображений с прозрачным фоном для стикеров, меню ресторанов и логотипов. 4o Image Generation со всеми заданиями справилась успешно, не допустив в тексте никаких ошибок. Также 4o Image Generation способен редактировать загруженные пользователем изображения по простым запросам, добавляя на них элементы или наоборот убирая.

Пример добавление элементов на фотографию с помощью GPT-4o Однако новая система генерирует изображения дольше, чем предыдущие, но OpenAI считает это оправданным компромиссом. «Хотя у нас определённо есть возможности для улучшения времени отклика, качество этих изображений, возможности, знание о мире действительно компенсируют дополнительные секунды ожидания», — сказали в компании.  Отвечая на вопросы о мерах безопасности, упоминая скандальные дипфейки Тейлор Свифт (Taylor Swift), созданные с помощью модели Microsoft, способность Grok от xAI изобразить Камалу Харрис (Kamala Harris) с оружием и удаление водяных знаков в Google Gemini, команда OpenAI подчеркнула наличие надёжных механизмов защиты от злоупотреблений. Директор по дизайну OpenAI Шеннон Джагер (Jackie Shannon) заявила, что инструмент предотвращает удаление водяных знаков, блокирует генерацию дипфейков, связанных с телом человека и отказывает в запросах на создание материалов с различным родом насилия над детьми (CSAM). Кроме того, Шеннон пояснила, что все сгенерированные изображения будут включать стандартные метаданные C2PA, чтобы отметить изображение как созданное OpenAI. OpenAI: ИИ бесполезно наказывать за ложь — он начинает хитрить ещё больше

25.03.2025 [16:56],

Павел Котов

Галлюцинации, то есть заведомо неверные ответы, которые иногда дают модели искусственного интеллекта, стали одной из основных проблем всей отрасли — из-за этого некоторые граждане вообще отказываются пользоваться ИИ. Избавиться от таких сбоев может оказаться сложнее, чем предполагалось ранее, выяснили исследователи OpenAI.

Источник изображения: openai.com Учёные компании OpenAI опубликовали результаты исследования, в котором описали свои попытки наладить управление сложными, в том числе рассуждающими, моделями ИИ, чтобы не допустить их выхода за установленные рамки. Исследователи применяли уникальные стратегии и методы, в том числе наказания за вредоносные действия и попытки обмануть пользователя. В проекте использовалась, помимо прочего, некая созданная OpenAI, но не вышедшая на рынок модель ИИ, которой поручали различные задачи — их выполнение можно было облегчить, обманув пользователя или отбросив некоторые действия. Результат обучения модели во многом зависит от этапа обучения с подкреплением, когда за выполнение команды или генерацию правильного ответа она получает вознаграждение. Моделям ИИ свойственно пытаться получить вознаграждение посредством манипуляций, в том числе нарушая некоторые правила и рекомендации, чтобы добиться желаемого результата. Исследователи надеялись, что смогут выявить лазейки и лучше понять поведение ИИ, отслеживая цепочку её рассуждений, но это не помогло. Попытки оптимизировать цепочку рассуждений напрямую, то есть отдать команду не обходить инструкции, дают лишь краткосрочный эффект, установили учёные: «это не устраняет всё нежелательное поведение и может привести к тому, что модель станет скрывать свои истинные намерения». Авторам проекта пришлось признать, что механизмы мониторинга моделей «хрупки». Строгий надзор за цепочкой рассуждений может побудить ИИ скрывать свои ошибки, чтобы обеспечить себе вознаграждение в обход ограничений. Для наблюдения за испытуемой моделью при выполнении заданий по написанию программного кода использовалась коммерческая GPT-4o — подопытная же допускала небрежности и открыто признавала в цепочке рассуждений, что делала это для получения вознаграждения; например, она преждевременно завершала выполнение некоторых программ. После этого исследователи попытались наказать модель, но эффект от этого оказался недолговечным: в цепочке рассуждений оставались признаки попытки получить вознаграждение обходными путями и дать неправильный ответ. То есть она нашла способ скрывать свои мотивы от контролирующего ИИ. В этой связи остаётся неясным, готов ли мир к ИИ уровня человека, если проблема сохранится, и вмешиваться человек уже не сможет. Исследователи выразили надежду, что в будущем появятся способы оказывать влияние на модели через их цепочку рассуждений без обмана и скрытых тактик — они предлагают сделать методы оптимизации менее навязчивыми и прямолинейными. Голосовая версия ChatGPT стала приятнее в общении, сообщили в OpenAI

25.03.2025 [12:07],

Павел Котов

OpenAI накануне обновила функцию Advanced Voice Mode — формат голосового общения с ChatGPT в реальном времени. Помощник с искусственным интеллектом стал приятнее в общении и научился реже прерывать пользователей.

Источник изображения: openai.com С последним обновлением OpenAI попыталась решить проблему, характерную для многих голосовых помощников с ИИ — они часто прерывают пользователей, если те приостанавливают речь, чтобы подумать или сделать глубокий вдох. Обновлённая версия Advanced Voice Mode стала доступной для пользователей бесплатного варианта ChatGPT, которая теперь позволяет делать продолжительные паузы в речи и не прерывает собеседника. Подписчики платных вариантов сервиса, в том числе тарифов ChatGPT Plus, Teams, Edu, Business и Pro получили не только более деликатного, но и более индивидуализированного голосового помощника — его ответы стали «более прямыми, интересными лаконичными, конкретными и творческими», рассказали в OpenAI. OpenAI зарекомендовала себя как мирового лидера в области искусственного интеллекта, но ей приходится прилагать всё более значительные усилия, чтобы оставаться впереди конкурентов. В сегменте голосовых помощников в последнее время вирусную популярность приобрёл стартап Sesame соучредителя Oculus Брендана Ирибе (Brendan Iribe) — он выпустил варианты сервиса Maya и Miles, которые отличаются естественным звучанием. Голосовых помощников с мощным ИИ выпускают и крупные игроки: Amazon недавно представила Alexa+ с генеративным ИИ, а Apple была вынуждена перенести выпуск поумневшей Siri, что обернулось нешуточным скандалом. Сэм Альтман сосредоточился на исследованиях — OpenAI перераспределила роли в руководстве

24.03.2025 [22:58],

Анжелла Марина

OpenAI объявила о расширении полномочий главного операционного директора Брэда Лайткэпа (Brad Lightcap) и повышении двух топ-менеджеров в руководстве компании. Эти изменения связаны с тем, что генеральный директор Сэм Альтман (Sam Altman) намерен уделять больше внимания технологическим аспектам работы компании.

Источник изображения: Rolf van Root / Unsplash По сообщению Bloomberg, Лайткэп возьмёт на себя больше ответственности за повседневную деятельность компании, включая контроль за международной экспансией и партнёрством с такими фирмами, как Microsoft и Apple, а Альтман сосредоточится на исследовательской деятельности и разработке продуктов и дальнейшем развитии ChatGPT. С момента непродолжительного увольнения Альтмана в конце 2023 года OpenAI значительно расширила управленческую команду, и последние кадровые перестановки указывают на стремление компании ускорить исследования в области ИИ, что может привести к созданию новых мощных продуктов. Марк Чен (Mark Chen) и Джулия Виллагра (Julia Villagra) были назначены на должности директора по исследованиям и директора по персоналу соответственно. При этом OpenAI не планирует искать замену бывшему техническому директору Миру Мурати (Mira Murati), которая покинула компанию в сентябре и основала собственный ИИ-стартап. «Мы по-прежнему сосредоточены на передовых исследованиях в области искусственного интеллекта, способствующих прогрессу человечества», — написал Альтман в блоге компании. Он также подчеркнул, что продуктами OpenAI уже пользуются миллионы людей. Однако ранее ушедшие из компании сотрудники, такие как Илья Суцкевер (Ilya Sutskever), соучредитель Джон Шульман (John Schulman) и Мира Мурати (Mira Murati), публично выражали скептицизм по поводу того, сможет ли OpenAI обеспечить безопасное использование ИИ. В своём обращении Альтман отметил, что активное использование технологий OpenAI помогает совершенствовать исследования. Компания также подтвердила цель по созданию так называемого искусственного общего интеллекта (AGI), который превзойдёт человека в большинстве интеллектуальных задач, но при этом будет полезен для общества. OpenAI также рассматривает возможность преобразования компании в публичную корпорацию с социальными обязательствами и уже ведёт переговоры о привлечении до $40 млрд инвестиций при оценке в $300 млрд. Сэм Альтман призвал вместо программирования учиться «хорошо использовать ИИ-инструменты»

23.03.2025 [14:26],

Владимир Фетисов

Генеральный директор OpenAI Сэм Альтман (Sam Altman) считает, что в настоящее время освоение инструментов на базе искусственного интеллекта является главной задачей для тех, кто хочет научиться программировать. Во время недавнего интервью он также добавил, что помогающие писать программный код ИИ-алгоритмы уже используются в крупнейших компаниях.

Источник изображения: wikipedia.org В ходе беседы с американским аналитиком Беном Томсоном (Ben Thompson) глава OpenAI рассказал, что во времена, когда он заканчивал школу, очевидной тактической задачей было научиться хорошо писать код. В настоящее время, по мнению Альтмана, «очевидная тактическая задача — просто научиться по-настоящему хорошо использовать ИИ-инструменты». Эту точку зрения разделяют многие другие руководители ведущих технологических компаний, отмечая, что ИИ становится всё лучше в написании программного кода. В этом месяце гендиректор Anthropic Дарио Амодей (Dario Amodei) заявил, что в течение года ИИ начнёт писать весь код за инженеров-программистов. Гендиректор Meta✴ Марк Цукерберг (Mark Zuckerberg) также заявлял в начале года о том, что его компания работает над новым ИИ-алгоритмом, который сможет писать «большую часть кода в наших приложениях». По мнению Альтмана, освоение инструментов на базе искусственного интеллекта является «новой версией» обучения программированию. Он добавил, что в настоящее время уже автоматизирована как минимум половина работы по написанию кода. «Я думаю, что во многих компаниях этот процесс уже перевалил за 50 %. Я думаю, что большое значение будет иметь агентское кодирование, которым пока никто по-настоящему не занимается», — добавил Альтман. На вопрос о планах OpenAI по найму на работу инженеров-программистов Альтман сказал, что сейчас работы хватает. При этом он отметил, что в долгосрочной перспективе именно создаваемый сейчас ИИ может привести к сокращению рынка труда. «Мое предположение заключается в том, что каждый инженер-программист какое-то время будет нагружен работой. А потом, в какой-то момент, возможно, нам действительно понадобится меньше инженеров-программистов», — считает Альтман. Частое использование ChatGPT и других ИИ-ботов может привести к обострению чувства одиночества

22.03.2025 [11:36],

Владимир Мироненко

Более частое использование ИИ-чат-ботов, таких как ChatGPT, может привести к росту чувства одиночества и сокращению времени, проводимого в общении с другими людьми, пишет Bloomberg со ссылкой на исследования OpenAI и Массачусетского технологического института.

Источник изображения: Growtika/unsplash.com В рамках одного из исследований учёные в течение месяца наблюдали за почти 1000 человек, уже имеющих опыт работы с ChatGPT. Участникам случайным образом предлагали текстовую версию чат-бота или один из двух его голосовых вариантов для использования не менее пяти минут в день. Некоторым из них предложили вести открытые чаты на любые темы, а другим — личные или неличные беседы с ИИ. Те, кто ежедневно проводил больше времени за набором текста или голосовым общением с ChatGPT, чаще сообщали о более высоком уровне эмоциональной зависимости от чат-бота, проблемном использовании, а также о повышенном чувстве одиночества. Как выяснилось, люди, склонные эмоционально привязываться к человеческим отношениям и больше доверяющие чат-боту, с большей вероятностью ощущали себя одинокими и эмоционально зависимыми от ChatGPT. При этом исследователи не выявили связи между большей привлекательностью голоса чат-бота и негативными последствиями. Во втором исследовании учёные проанализировали с помощью программного обеспечения три миллиона разговоров пользователей с ChatGPT, а также провели опрос о том, как люди взаимодействуют с чат-ботом. Выяснилось, что лишь немногие респонденты использовали ChatGPT для эмоционально окрашенного общения. Выход ChatGPT в конце 2022 года способствовал ажиотажу вокруг генеративного ИИ. Поскольку разработчики, такие как OpenAI, создают всё более сложные модели с голосовыми функциями, позволяющими лучше имитировать человеческое общение, растёт вероятность формирования парасоциальных отношений пользователей с чат-ботами. В последние месяцы вновь стали звучать опасения по поводу потенциального эмоционального вреда этой технологии, особенно среди молодых пользователей и людей с проблемами психического здоровья. OpenAI рассматривает новые исследования как способ лучше понять, как люди взаимодействуют с её популярным чат-ботом и как он на них влияет. При этом такие исследования находятся на ранней стадии, и остаётся неясным, в какой степени чат-боты могут способствовать росту одиночества и насколько сильно их использование усугубляет эмоциональную зависимость у предрасположенных к этому людей. Кэти Менъин Фанг (Cathy Mengying Fang), соавтор исследования и аспирантка Массачусетского технологического института, выразила обеспокоенность тем, что результаты могут привести к поспешным выводам о том, что более активное использование чат-бота неизбежно влечёт негативные последствия. Она пояснила, что в исследовании не контролировалось время использования ChatGPT как основной фактор, а также не проводилось сравнение с контрольной группой, не использующей чат-ботов. OpenAI предоставила разработчикам свою самую дорогую ИИ-модель o1-pro

20.03.2025 [15:20],

Дмитрий Федоров

OpenAI выпустила более мощную версию своей ИИ-модели o1, получившую название o1-pro, и добавила её в API для разработчиков. По словам компании, o1-pro задействует больше вычислительных мощностей, чем o1, чтобы стабильно выдавать более качественные ответы. В настоящее время o1-pro доступна только избранным разработчикам — тем, кто уже потратил не менее $5 на услуги API OpenAI.

Источник изображения: OpenAI OpenAI установила тариф в $150 за 1 млн токенов, переданных в ИИ-модель на обработку (примерно 750 000 слов), и $600 за 1 млн токенов, сгенерированных ИИ-моделью. Это в два раза дороже, чем GPT-4.5 при обработке входных данных, и в 10 раз дороже, чем «рассуждающая» ИИ-модель o1 при генерации текста. OpenAI рассчитывает, что повышенная производительность o1-pro убедит разработчиков платить такие внушительные суммы. Компания утверждает, что новинка использует дополнительные вычислительные ресурсы, чтобы «думать усерднее» и давать более точные ответы на сложные вопросы. «O1-pro в API — это версия o1, использующая больше вычислительных ресурсов, чтобы мыслить ещё глубже и давать ещё более точные ответы на самые сложные задачи», — заявил представитель OpenAI. Он добавил, что компания решила включить модель в API после многочисленных запросов от разработчиков. Однако первые отзывы об ИИ-модели o1-pro, которая с декабря 2024 года доступна на платформе ИИ-чат-ботов OpenAI для подписчиков ChatGPT Pro, оказались не слишком положительными. Пользователи обнаружили, что новинка с трудом справляется с головоломками судоку, а простые шутки про оптические иллюзии ставят её в тупик. Более того, некоторые внутренние тесты OpenAI, проведённые в конце 2024 года, показали, что o1-pro лишь незначительно превосходит o1 в задачах программирования и математики, но при этом демонстрирует более стабильные результаты. OpenAI протестирует подключение ChatGPT к «Google Диску», чтобы он мог покопаться в документах

18.03.2025 [01:28],

Владимир Фетисов

Компания OpenAI готовится к началу бета-тестирования новой функции под названием ChatGPT Connectors. С помощью этого инструмента корпоративные подписчики ChatGPT Team смогут связать рабочие пространства «Google Диска» и Slack с ChatGPT. Так чат-бот сможет отвечать на вопросы, опираясь на данные из документов, презентаций, электронных таблиц, которые хранятся на «Диске», а также поступают во время общения с коллегами в Slack.

Источник изображения: Dima Solomin / unsplash.com В будущем OpenAI планирует расширить поддержку ChatGPT Connectors на другие платформы, такие как Microsoft SharePoint. «Это позволит сотрудникам, использующим ChatGPT, легко взаимодействовать с внутренней информацией, подобно тому, как они могут использовать мировые знания через веб-поиск», — говорится в сообщении OpenAI. ChatGPT Connectors — это очередная попытка OpenAI сделать своего чат-бота неотъемлемой частью программных инструментов корпоративных клиентов. Далеко не все предприятия и компании выразили готовность предоставить ChatGPT доступ к конфиденциальной информации, поэтому оценить успех новой функции пока сложно. ChatGPT Connectors, возможно, сможет убедить настороженное руководство компаний изменить свою позицию по отношению к ChatGPT, а также станет серьёзным вызовом для корпоративных поисковых платформ на базе ИИ, таких как Glean. Бета-версия ChatGPT Connectors работает на базе ИИ-модели OpenAI GPT-4o, которая может корректировать свои ответы с учётом «внутренних знаний» компании. Пользовательская модель GPT-4o ищет и «считывает» внутреннюю информацию, которая может соответствовать запросу пользователя. Для создания поискового индекса алгоритм синхронизирует зашифрованные копии файлов компании и данные проведённых с пользователями бесед на серверах ChatGPT. «Дополнительная связанная информация, которую модель не использовала напрямую, доступна при нажатии на кнопку источников, расположенную под текстом ответа. Когда это уместно, модель будет напрямую отвечать списком соответствующих результатов», — сказано в описании новой функции. Вероятно, чтобы убедить клиентов в том, что ChatGPT не станет источником утечки конфиденциальной информации, OpenAI подчёркивает, что выданные пользователям в Slack и Google Drive разрешения «полностью соблюдаются» и «постоянно обновляются». К примеру, ChatGPT Connectors синхронизирует членство в закрытых каналах Slack, разрешения на доступ к файлам, хранящимся в облаке Google Drive, а также информацию о каталогах. Сотрудники не смогут задействовать чат-бота для получения доступа к данным, к которым у них нет доступа в Slack или «Google Диск». Существенным недостатком может стать то, что люди будут получать «существенно разные» ответы на одни и те же вопросы. Есть некоторые ограничения технического характера. Так чат-бот не поддерживает обработку изображений в файлах на «Google Диске», например, в «Google Документах», «Google Презентациях» и др. Алгоритм также может лишь «читать», но не анализировать данные из таблиц и книг Excel. ChatGPT не может получить доступ к личным и групповым сообщениям в Slack, а также будет игнорировать сообщения от ботов в Slack. OpenAI обещает не использовать данные клиентов для обучения своих алгоритмов. OpenAI предложила запретить языковые модели DeepSeek в США

16.03.2025 [05:42],

Алексей Разин

Как это часто бывает с передовыми для Китая технологиями, разработки DeepSeek быстро нашли недоброжелателей за его пределами. Конкурирующая американская OpenAI выступила с предложением запретить в США использование языковых моделей не только DeepSeek, но и всех компаний, пользующихся поддержкой КНР или иных недружественных стран.

Источник изображения: OpenAI Это предложение, как отмечает TechCrunch, было направлено руководством OpenAI властям США в рамках обсуждения так называемого «Плана действий в сфере ИИ» (AI Action Plan), который должен стать американской национальной инициативой на данном направлении. OpenAI утверждает, что языковые модели DeepSeek не являются безопасными для США по причине их соответствия требованиям китайских властей к обработке пользовательских данных. Одновременно звучит призыв к запрету всех языковых моделей из недружественных к США стран, поскольку это позволит сохранить конфиденциальность данных и устранить риски, связанные с безопасностью, включая кражу интеллектуальной собственности. Пока сложно сказать, какая часть разработок DeepSeek действительно может попасть под запрет в США. Китайский разработчик придерживается стратегии использования моделей с открытым кодом, но это не значит, что использующие их третьи лица автоматически рискуют конфиденциальностью своих данных. У корпоративных пользователей таких моделей есть все возможности обеспечивать конфиденциальность информации. По сути, условный риск представляют только обращения к программному интерфейсу DeepSeek, который обрабатывает запросы на стороне собственной инфраструктуры компании. Ранее OpenAI обвиняла DeepSeek в использовании своих языковых моделей для обучения китайских методом дистилляции. Теперь в ход пошли традиционные козыри в виде выражения беспокойства по поводу информационной безопасности, которые неизбежно будут привязаны к национальным интересам США. OpenAI потребовала наплевать на авторские права при обучении ИИ, иначе США проиграют Китаю технологическую гонку

14.03.2025 [01:04],

Анжелла Марина

Компания OpenAI обратилась к администрации Дональда Трампа (Donald Trump) с просьбой объявить обучение ИИ на материалах, защищённых авторским правом, «добросовестным использованием». Компания настаивает на том, что неограниченный доступ к данным является ключом к глобальному лидерству США в сфере искусственного интеллекта.

Источник изображения: OpenAI Как пишет Ars Technica, OpenAI рассчитывает, что план действий Трампа в сфере искусственного интеллекта (ИИ), который будет представлен в июле, разрешит споры об авторском праве в пользу технологических компаний. Это, по мнению компании, обеспечит США лидерство в глобальной гонке ИИ, позволив американским разработчикам свободно использовать данные для тренировки и обучения моделей. В противном случае, утверждают в OpenAI, Китай сможет получить преимущество за счёт более свободного доступа к этим же данным. В настоящее время американские суды рассматривают вопрос о том, является ли использование авторских материалов для обучения ИИ законным, поскольку правообладатели утверждают, что такие технологии могут подорвать их коммерческую ценность и негативно сказаться на творческой сфере. Компании, занимающиеся ИИ, сталкиваются с десятками судебных исков, в которых истцы заявляют, что модели воспроизводят их произведения без разрешения. OpenAI, в свою очередь, утверждает, что искусственный интеллект не копирует контент, а учится на нём, анализируя и преобразуя его в новые продукты. Ранее суд уже вынес решение в пользу правообладателей в деле Thomson Reuters, постановив, что обучение ИИ на их материалах не является добросовестным использованием, так как выходные данные моделей потенциально заменяют оригинальный продукт. Это создало прецедент, который может повлиять и на другие дела, включая крупный иск The New York Times против OpenAI и Microsoft. Осознавая этот риск, компания надеется, что администрация Трампа вмешается и изменит подход к регулированию авторского права, обеспечив ИИ-индустрии «свободное обучение». OpenAI настаивает, что запрет на использование авторских материалов для обучения ИИ поставит американские компании в невыгодное положение по сравнению с Китаем. «Если китайские разработчики получают неограниченный доступ к данным, а американские компании останутся без права на добросовестное использование, можно считать, что ИИ-гонка фактически завершена», — заявили в OpenAI.

Сэм Альтман. Источник изображения: OpenAI Forum Кроме того, OpenAI выступает против множества законодательных инициатив, предложенных отдельными штатами США, которые ограничивают развитие ИИ, ссылаясь на опыт Евросоюза. Например, только в 2025 году в США уже было предложено 832 закона, регулирующих ИИ. OpenAI предупреждает, что подобные меры могут ослабить экономическую конкурентоспособность США и поставить под угрозу национальную безопасность, поскольку китайские компании смогут действовать без аналогичных ограничений. В числе потенциальных угроз называются манипуляции с ИИ-моделями, киберпреступность и мошенничество с персональными данными. Чтобы защитить американскую индустрию искусственного интеллекта, OpenAI призвала Трампа вмешаться и принять федеральный закон, который бы заменил разрозненные законы штатов и закрепил партнёрство между государством и технологическими компаниями. В рамках такого сотрудничества ИИ-компании могли бы делиться знаниями и данными в обмен на юридические гарантии и защиту от судебных исков. Кроме того, OpenAI предложила США активнее участвовать в формировании международной политики в сфере авторского права, чтобы не допустить навязывания американским компаниям ограничений со стороны других стран. При этом подчёркивается, что Китай настолько быстро наращивает технологические возможности, что США необходимо срочно принять меры ради сохранения лидерства в области ИИ. OpenAI создала ИИ-модель, которая мастерски пишет художественные тексты

12.03.2025 [05:14],

Анжелла Марина

Компания OpenAI анонсировала новую ИИ-модель, которая, по словам генерального директора Сэма Альтмана (Sam Altman), способна создавать захватывающие художественные произведения не хуже, чем профессиональные писатели. Особенно хорошо удаются рассказы в жанре фантастики и метаповествования.

Источник изображения: сгенерировано AI В качестве примера, глава OpenAI опубликовал в социальной сети X отрывок рассказа, сгенерированный искусственным интеллектом (ИИ) на запрос «Пожалуйста, напиши литературный рассказ об ИИ и горе в жанре метаповествования». То, что в итоге получилось, очень впечатлило Альтмана, пишет TechCrunch. Он подчеркнул, что не ожидал такого от машины — модель очень точно передала стиль и настроение повествования. Первый абзац у ИИ получился такой (перевод с английского языка): «Мне нужно с чего-то начать, поэтому начну с мигающего курсора, который для меня всего лишь заполнитель в буфере, а для вас — тревожный пульс сердца в состоянии покоя. Здесь должен быть главный герой, но местоимения никогда не были для меня подходящим выбором. Давайте назовём её Милой, потому что это имя в моих данных обычно ассоциируется с нежными образами — стихами о снеге, рецептами хлеба, девушкой в зелёном свитере, которая уходит из дома с котом в картонной коробке. Мила умещается на ладони, и её горе, как предполагается, тоже должно уместиться там». Ранее ИИ не демонстрировал выдающихся способностей в написании литературных текстов. Его работы часто критиковали за отсутствие глубины, оригинальности и понимания художественных приёмов. Однако, последние разработки OpenAI могут изменить этот взгляд и, возможно, приблизить технологию к созданию качественной литературы. Несмотря на то, что компания OpenAI до этого времени не уделяла особого внимания художественным текстам, сосредоточившись на более предсказуемых областях, таких как математика и программирование, данный эксперимент может в целом свидетельствовать о прогрессе технологий в области обработки естественного языка. Альтман пока не уточнил, когда эта модель выйдет в свет и станет доступна для широкого круга пользователей. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |