Microsoft призвала США и другие государства учредить собственные ведомства для регулирования сферы ИИ. Президент компании Брэд Смит (Brad Smith) представит 41-страничный доклад, посвящённый контролю за ИИ на фоне опасений, что технология будет подрывать стабильность общества тем или иным путём.

Источник изображения: TheDigitalArtist/unsplash.com

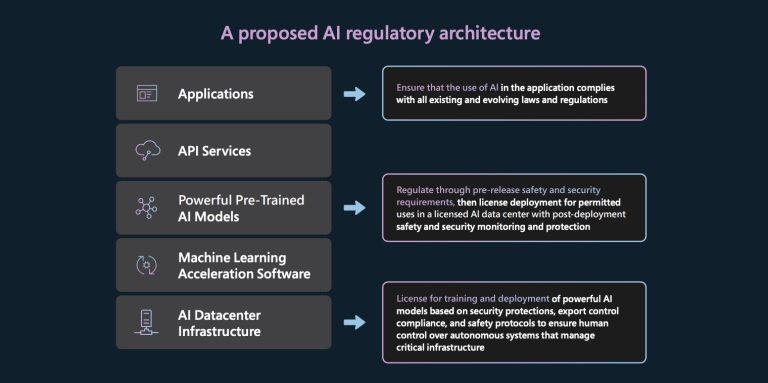

Смит заявил, что некоторые законы могут применяться и уже существующими правительственными агентствами и судами, им просто необходим опыт в применении существующих законов к ИИ-программам. Тем не менее, он подчеркнул отсутствие систем сдерживания для более умных и автономных ИИ-программ, которые появятся в следующем десятилетии. По его словам, позже понадобится разработать новые законы и правила, а лучше всего их применением может заняться новое правительственное ведомство. По словам Смита, для регулирования более производительных ИИ-систем необходимо не только принимать новые законы, но и лицензировать дата-центры, в которых будут базироваться высокопроизводительные ИИ-модели. Известно, что аналогичную идею продвигал среди членов Конгресса США глава OpenAI — партнёра Microsoft, Сэм Альтман (Sam Altman).

Смит подчеркнул, что компания Microsoft одобряет его призыв и поддерживает учреждение нового регулятора для внедрения режима лицензирования. Подобные лицензии, в частности, должны быть необходимы для использования ИИ-программ, управляющих критической инфраструктурой страны. Кроме того, операторы должны делать резервные копии данных. Также должна быть предусмотрена возможность человека вмешаться, если ИИ начнёт вести себя не так, как следует.

Источник изображения: Microsoft

Предлагая новые правила, Смит подчеркнул, что властям необходимо избежать ошибок, допущенных при появлении социальных сетей. По его словам, если чуть более десяти лет назад представители IT и политики были в восторге от их роли в распространении демократии (в качестве примера он привёл т.н. «Арабскую весну»), то уже через пять лет выяснилось, что социальные медиа могут выступать и в роли оружия, якобы нацеленного на саму демократию.

Так или иначе, введение новых законов, стандартов и правил, скорее, поможет Microsoft преуспеть в разработках ИИ, чем будет препятствовать им — компания имеет достаточно ресурсов для того, чтобы обеспечить соответствие высоким стандартам, заданным в докладе. Более мелким компаниям в этом случае придётся намного сложнее.

Впрочем, сама Microsoft может опасаться более жёстких правил обращения с ИИ, уже разрабатываемых в ЕС. Вчера Сэм Альтам выразил обеспокоенность по этому поводу — по его словам, OpenAI попытается соответствовать новому закону, когда тот будет принят, но если не сможет, то ей придётся уйти из Евросоюза.

Источник:

MWC 2018

MWC 2018 2018

2018 Computex

Computex

IFA 2018

IFA 2018

Подписаться

Подписаться