«Яндекс» отмечает десятилетие использования нейросетей в поиске. 5 декабря 2014 года служба представила функцию поиска по картинке, которая начала понимать суть изображения, предлагая похожие варианты и альтернативные версии. Далее нейросети стали участвовать в ранжировании сайтов, переводе текстов, ответе на дополнительные запросы пользователей и во многих других областях. Сегодня они генерируют тексты, изображения и видео.

Источник изображений: «Яндекс»

Первые эксперименты с нейросетями компания проводила еще в 2012 году — для прогнозирования дорожных пробок, а затем для распознавания речи в продукте SpeechKit. В 2015 году нейросеть расширила возможности поиска, позволив искать изображения по тексту и помещать картинки в семантическое пространство.

С 2016 года нейросети стали использоваться для ранжирования сайтов в поисковой выдаче. Алгоритмы «Палех» (2016) и «Королёв» (2017) последовательно улучшали качество поиска, оценивая семантическую близость запросов. В 2020 году для ранжирования был внедрен трансформер YATI (Yet Another Transformer with Improvements), который адаптировали под рабочую среду «Яндекса».

Значительный прогресс произошел в машинном переводе. С 2017 года нейросети интегрировались в поиск, а к 2021 году позволили включать в выдачу англоязычные сайты при отсутствии русскоязычных результатов. Появился также перевод видео в «Поиске» и «Браузере».

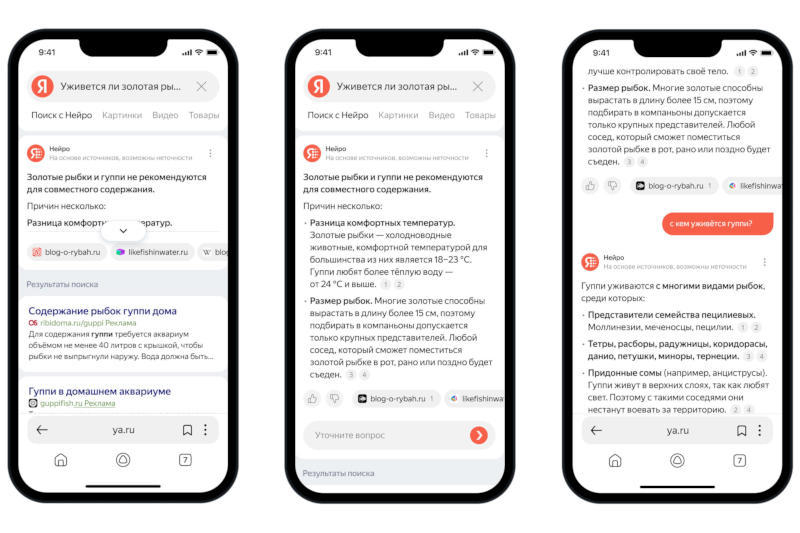

Сегодня «Яндекс Поиск» не только показывает сайты, но и отвечает на пользовательские вопросы благодаря функции «Поиск с Нейро» и нейросети YandexGPT. В текущем году к сервису подключили мультимодальную VLM-нейросеть, которая позволяет осуществлять поиск с использованием текста и изображений.

Источник:

MWC 2018

MWC 2018 2018

2018 Computex

Computex

IFA 2018

IFA 2018

Подписаться

Подписаться