|

Опрос

|

реклама

Быстрый переход

Бесплатный ChatGPT стал «умнее по всем параметрам» — OpenAI обновила модель GPT-4o

31.01.2025 [01:29],

Николай Хижняк

Компания OpenAI анонсировала обновление для своей ИИ-модели GPT-4o, которая является основой для чат-бота ChatGPT, в том числе его бесплатной версии. Обновление сделало нейросеть «умнее по всем параметрам», а также «наделило более актуальной информацией», а также научило «более глубокому пониманию и анализу загружаемых [пользователями] изображений».

Источник изображения: OpenAI Ключевая особенность свежего обновления ИИ-модели GPT-4o заключается в том, что чат-бот ChatGPT на её основе теперь лучше справляется с задачами по STEM-дисциплинам, то есть лучше разбирается в вопросах науки, технологий, инженерии, математики и программирования. Хорошая новость для тех, кто полагается на помощь ChatGPT, например, в вопросах написания кода или решения задач, связанных с кросс-доменными проблемами. Также ИИ-модель GPT-4o была обучена на основе более свежей информации, поэтому чат-боты на её основе теперь могут ссылаться на данные до июня 2024 года. Это означает, что ChatGPT сможет предоставлять больше контекста относительно более свежих тенденций и событий. Что касается функций, связанных с генерацией и редактированием изображений, то ChatGPT теперь лучше «понимает» и анализирует изображения, загружаемые пользователем. Например, чат-бот сможет предоставлять более качественные советы по редактированию изображений, а также лучше анализировать сложные графики и диаграммы. Наконец, ChatGPT будет проявлять больше энтузиазма в использовании различных эмодзи в своих ответах, особенно, когда в запросах пользователя тоже будут использоваться эмодзи. Пользователи стали тратить в 37 раз больше на мобильные приложения с ИИ за два года

29.01.2025 [15:18],

Владимир Мироненко

За последние два года ежемесячный доход разработчиков мобильных приложений с искусственным интеллектом (ИИ) вырос в 37 раз. В частности, в 2024 году пользователи потратили на них $1,4 млрд, сообщил «Коммерсантъ» со ссылкой на доклад аналитической компании Appfigures. Согласно прогнозу аналитиков, в 2025 году расходы пользователей на такие приложения превысят $2 млрд.

Источник изображения: Growtika/unsplash.com С большим отрывом по количеству скачиваний среди ИИ-приложений лидирует ИИ-чат-бот ChatGPT компании OpenAI. Он был представлен в ноябре 2022 года и стал доступен для пользователей в магазинах мобильных приложений в мае 2023 года. С тех пор пользователи смартфонов потратили на него $529 млн, а месячная выручка его разработчика выросла с момента запуска в 75 раз. С июля минувшего года ежемесячный доход от ChatGPT превышает совокупный доход от всех других популярных приложений-помощников в App Store и Play Store. Наибольшей популярностью среди приложений с ИИ пользуются чат-боты. По итогам последних двух лет умные помощники занимают в рейтинге скачиваний восемь из десяти первых мест. Большинство пользователей приложений с ИИ — молодые люди, которые относятся к возрастной категории от 18 до 24 лет. При этом львиная доля трат на такие приложения приходится на пользователей из США — 64 % всех трат в мире. Китайское ИИ-приложение DeepSeek попало в топы App Store и Google Play в России

29.01.2025 [07:04],

Анжелла Марина

Китайский чат-бот DeepSeek стремительно набирает популярность в России. Приложение вошло в топы App Store и Google Play, обогнав многие известные сервисы. Успех DeepSeek связан с его доступностью в России и хорошей функциональностью, что и привлекло внимание пользователей, но одновременно вызвало беспокойство у конкурентов в США.

Источник изображения: Copilot По данным РБК, 28 января DeepSeek возглавил рейтинг самых популярных приложений в российском App Store. В Google Play, который является наиболее востребованной платформой в России и мире, приложение поднялось со 115-го на 20-е место всего за сутки. При этом число загрузок приложения на территории РФ за неделю выросло в три раза и превысило 43 тысячи, свидетельствуя о растущем интересе к технологиям искусственного интеллекта. DeepSeek представляет из себя чат-бот, созданный на основе большой языковой модели искусственного интеллекта (LLM). Его разработчиком является китайская компания, основанная в 2023 году Лян Вэньфэном (Liang Wenfeng), соучредителем хедж-фонда High-Flyer. ИИ-бот способен генерировать тексты, искать информацию в интернете, расшифровывать диаграммы, писать и форматировать код, а также решать сложные задачи по программированию на таких языках, как C++, Python, Java и других. ИИ-Модель DeepSeek-V3, которая легла в основу чат-бота, была опубликована в конце прошлого года и, согласно технической документации, «продемонстрировала производительность, сопоставимую с ведущими американскими аналогами, но с той лишь разницей, что ресурсов для вычислений потребовалась значительно меньше». Компания использовала графические процессоры Nvidia H800, представляющие из себя менее передовую (замедленную) версию видеокарты H100, специально созданную для Китая в рамках ограничений США. Однако за счёт разработки инновационных алгоритмов удалось достигнуть впечатляющей функциональности. Стоимость аренды Nvidia H800 на обучение модели составила $2 за 1 час и в сумме обошлась компании менее чем в $10 млн. Стоит сказать, что успех DeepSeek вызвал беспокойство у американских технологических гигантов, таких как Microsoft, Alphabet (владелец Google) и Meta✴, так как их затраты на разработку искусственного интеллекта исчисляются сотнями миллиардов долларов. На этом фоне инвесторы засомневались в необходимости высокотехнологичных чипов Nvidia, что даже привело к краткосрочному падению котировок компании почти на 18 % с частичным восстановлением на следующий день (8 %). При этом Nvidia назвала новую китайскую модель DeepSeek R1 существенным достижением в области ИИ, а Сэм Альтман (Sam Altman) признал, что DeepSeek теперь является конкурентом OpenAI. ИИ-помощник Meta✴ AI будет «запоминать» информацию о пользователях для улучшения рекомендаций

28.01.2025 [11:04],

Владимир Фетисов

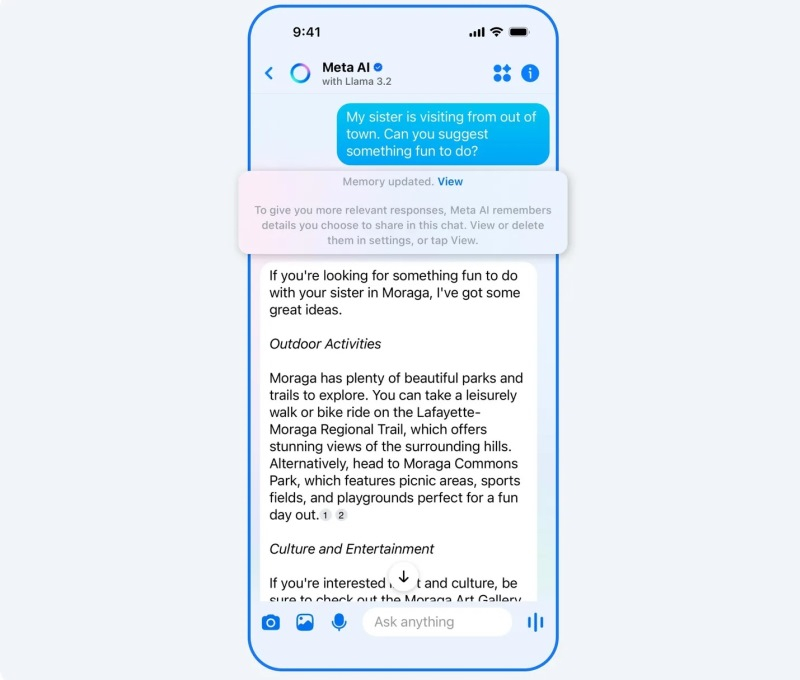

Помощник на базе искусственного интеллекта Meta✴ AI будет «запоминать» определённую информацию о пользователях, например, сведения о диетических предпочтениях и интересах. Собранную таким образом информацию вместе с данными из учётных записей Facebook✴ и Instagram✴ алгоритм будет использовать для предоставления более релевантных рекомендаций.

Источник изображения: starline / freepik.com ИИ-помощник Meta✴ AI получил функцию памяти в конце прошлого года, но на тот момент она была ограничена. Теперь же разработчики объявили о более широком распространении этого нововведения на Facebook✴, Messenger и WhatsApp для платформ Android и iOS на территории США и Канады. Хотя пользователи могут сами сообщить Meta✴ AI какую-то информацию о себе, он также будет запоминать некоторые данные на основе контекста. Например, если алгоритм предоставит рецепт какого-то блюда с мясом, а пользователь сообщит, что он вегетарианец, то в дальнейшем чат-бот будет корректировать свои ответы с учётом этой особенности.

Источник изображения: Meta✴ AI Наряду с этими «воспоминаниями» Meta✴ AI в Facebook✴, Instagram✴ и Messenger обеспечит «более высокий уровень персонализации», для чего будет задействована информация из учётных записей пользователей на каждой из платформ. Алгоритм учтёт возраст, пол и интересы пользователя, формируемые на основе его действий и просматриваемого контента. Отмечается, что на данный момент компания не предоставляет возможность отказа от функции персонализации контента. По данным компании, ИИ-алгоритм запоминает данные только из персональных бесед с пользователем, но не в групповых чатах. При необходимости можно «в любое время» удалить воспоминания чат-бота. Посещаемость ИИ-чат-бота DeepSeek взлетела с 300 000 до 6 млн человек, не обошлось и без DDoS

28.01.2025 [04:32],

Анжелла Марина

Китайский ИИ-стартап DeepSeek столкнулся с резким ростом интереса к своим продуктам. Согласно данным аналитического сервиса Similarweb, ежедневное количество посещений сайта компании увеличилось с 280 тысяч до 6,2 миллиона. Такой скачок произошёл после выпуска 26 декабря третьей версии их чат-бота V3. В последующие дни трафик начал стремительно расти, достигнув 2 миллионов посещений в день.

Источник изображения: Unsplash, Faizi Sheikh К началу января ежедневный трафик на сайт DeepSeek достиг 3,1 млн посещений, а к концу недели пересёк отметку в 5 млн. Пик интереса пришёлся на 24 января, когда аналитический сервис Similarweb зафиксировал 6,2 миллиона посещений. Как пишет PCMag, этот рост совпал с распространением информации о том, что технологии DeepSeek могут составить серьёзную конкуренцию американским компаниям на рынке искусственного интеллекта (ИИ). Хотя цифры, касающиеся посещаемости, всё ещё значительно уступают OpenAI, чей чат-бот ежедневно привлекает более 100 миллионов человек, успех DeepSeek очевидно свидетельствует о растущем интересе к разработкам компании. Отмечается, что одной из причин популярности DeepSeek стали их последние модели V3 и R1, которые требуют значительно меньше вычислительных ресурсов и снижают затраты на их использование. По мнению экспертов, компания использует такие технологии, которые способны нанести удар по бизнес-моделям американских технологических гигантов, таких как Nvidia, OpenAI и Microsoft. «Развёртывание замороженных атомных электростанций никогда не было решением. У нас есть огромные возможности для повышения эффективности ИИ», — выразил своё мнение в Twitter генеральный директор Cloudflare Мэттью Принс (Matthew Prince). Однако рост популярности DeepSeek привлёк не только пользователей, но и хакеров. Вчера утром компания сообщила о «крупномасштабной злонамеренной атаке» на свой сайт, что даже вынудило её временно ограничить регистрацию новых пользователей. При этом уже существующие пользователи сохранили доступ к сервису, а DeepSeek временно разрешила регистрацию только для пользователей с китайскими номерами телефонов (+86). Тем не менее, позднее ограничения были смягчены, так как удалось частично справится с техническими трудностями, которые были вызваны DDoS-атакой. Google заявила, что её ИИ самый лучший в мире — осталось убедить людей им пользоваться

17.01.2025 [02:12],

Анжелла Марина

Компания Google утверждает, что является лидером в области разработки технологии искусственного интеллекта, и её ИИ-модель Gemini превосходит возможности конкурентов. Однако по количеству пользователей ChatGPT вышел вперёд. В настоящее время, количество активной аудитории Gemini не разглашается, в то время как ChatGPT еженедельно посещают 300 миллионов пользователей.

Источник изображения: Solen Feyissa / Unsplash Несмотря на то, что Google является одним из пионеров в области искусственного интеллекта (ИИ), компания была застигнута врасплох запуском ChatGPT в конце 2022 года. С тех пор Google активно работает в этом направлении, внедряя новые функции и стремясь занять лидирующие позиции. Недавно технология Gemini даже обошла OpenAI в рейтингах Chatbot AI. Однако приложение Gemini по-прежнему отстаёт от ChatGPT по количеству скачиваний — 106 миллионов против 465 миллионов, сообщает The Wall Street Journal, ссылаясь на статистику App Store. Отмечается, что хотя Gemini пока не приносит значительных доходов, предлагая премиум-версию чат-бота по подписке за $20 в месяц, однако является ключевым элементом стратегии Google в области ИИ, влияя на основные направления бизнеса, такие как поиск и реклама. Также, несмотря на то, что в платной версии добавлены различные бонусы и 2 Тбайт облачного хранилища, не все пользователи выбирают подписку ради самого ИИ. Например, специалист по данным из Филадельфии Сифэй Хан (Sifei Han) отметил, что в Gemini ценит дополнительные возможности хранения, но предпочитает стиль ChatGPT. Согласно данным аналитической компании из США Earnest Analytics, около 60 % платных пользователей Gemini сохраняют подписку спустя шесть месяцев после её оформления. Этот показатель лучше, чем у некоторых конкурентов, таких как Character.AI и Perplexity, но всё же уступает OpenAI и Anthropic. Стоит сказать, что технология Gemini уже используется в различных продуктах Google, включая «обзоры ИИ» (AI overviews) в поисковой выдаче, в бизнес-версиях Gmail и Google Drive. Компания также активно продвигает Gemini в качестве помощника по умолчанию на мобильных устройствах, в том числе на своих телефонах Pixel и на устройствах Motorola и OnePlus. ИИ в Gmail, «Документах» и прочих сервисах Google стал бесплатным, но подписка Workspace подорожала

15.01.2025 [19:28],

Сергей Сурабекянц

Ранее для использования всех функций ИИ в Gmail, «Документах», «Таблицах», Meet и остальных приложениях Google Workspace, требовалось оплатить тарифный план Gemini Business за $20 в месяц для каждого пользователя. С 14 января этот тарифный план стал бесплатным — Google добавила все функции ИИ в Workspace, стремясь не проиграть в конкурентной борьбе с Microsoft, OpenAI и другими в создании офисного пакета будущего на базе ИИ.

Источник изображения: techspot.com Однако в этой бочке мёда имеется и ложка дёгтя — одновременно с отменой платы за ИИ-функции Google повысила цену на все варианты подписки Workspace. Компаниям придётся в среднем платить примерно на $2 в месяц больше за каждого пользователя Workspace. Конечно, контракты крупных компаний могут предусматривать другие условия, но базовая цена подписки выросла с $12 до $14 в месяц. ИИ-функции Workspace включают доступ к чат-боту Gemini, сводки электронной почты в Gmail, дизайны для электронных таблиц и видео, автоматизированный конспект для совещаний, мощный помощник по исследованиям NotebookLM и инструменты для письма в приложениях. По словам президента Google по облачным приложениям Джерри Дишлера (Jerry Dischler), Google предлагает наиболее вертикально интегрированный ИИ-продукт, но это имеет значение только в том случае, если люди используют всю систему. «В большинстве случаев, когда мы общаемся с компаниями, которые используют ИИ, главным препятствием становятся соображения стоимости, — говорит он. — Вот почему они так осторожно подходят к этому. Типа: “Ого, это куча денег, и давайте докажем ценность”. Хорошо, теперь вы получаете ИИ [бесплатно]. У вас есть ценность». Google не единственная компания, которая отказалась от наценки за ИИ: в ноябре 2024 года Microsoft объявила, что функции ИИ Copilot Pro, которые ранее стоили $20 в месяц, станут частью стандартной подписки Microsoft 365. Другие поставщики решений ИИ также делают ставку на то, что «бесплатный» доступ к ИИ окупится в долгосрочной перспективе. Разработчики WhatsApp почему-то уверены, что пользователи жаждут общаться с ИИ-ботами

10.01.2025 [18:15],

Сергей Сурабекянц

Мессенджер WhatsApp в свежей бета-версии тестирует новый дизайн приложения для Android, который заменяет вкладку «Сообщества» на главном экране на специальный раздел для чат-ботов ИИ. Он включает в себя выбор из «Популярных персонажей ИИ» для общения и прочие тематические опции. Другие функции на основе ИИ в WhatsApp включают изображения и стикеры, созданные ИИ, а также инструмент поиска с использованием Meta✴ AI.

Источник изображения: unsplash.com Перечисленные инструменты ИИ и чат-боты не являются новыми для WhatsApp, хотя доступны они только в США и некоторых других странах, и поддерживают ограниченный выбор языков. Приложение также экспериментирует с расширением списка ботов ИИ, добавляя возможность создания персонализированных персонажей ИИ. Ранее существовала возможность создания пользовательских ботов ИИ, но только через AI Studio на сайте Instagram✴. Добавление этой опции непосредственно в приложение значительно упрощает процесс. Несмотря на то, что новая вкладка с чат-ботами ИИ заменяет существующую вкладку «Сообщества», эта функциональность никуда не денется. Судя по предыдущей бета-версии и комментариям разработчиков, создание сообществ будет упрощено и перенесено на вкладку «Чаты». Хотя свежая бета-версия WhatsApp представлена в Google Play, количество тестировщиков ограничено, а возможность присоединиться к тестированию в настоящее время недоступна. Пока трудно сказать, будет ли добавлена вкладка ИИ в окончательную сборку приложения, и когда это произойдёт. В любом случае, изменение, скорее всего, будет ограничено только теми странами, где функции ИИ уже доступны. Google добавит в поисковик ИИ-режим в ответ на запуск ChatGPT Search

21.12.2024 [11:03],

Павел Котов

Google намеревается добавить на поисковую страницу новую опцию — режим искусственного интеллекта, который вместо традиционной выдачи предлагает диалог с чат-ботом, способным отвечать на вопросы. Схожим образом работает ИИ-помощник Gemini.

Источник изображения: sarah b / unsplash.com Режим ИИ будет включаться в меню верхней части страницы — там, где расположены привычные пункты «Все», «Картинки», «Новости», «Видео», «Покупки» и т. д., сообщило издание The Information со ссылкой на собственный источник. Как и чат-бот Gemini, поиск с ИИ будет сопровождать ответы ссылками на сайты и вторым полем ввода, где можно будет задавать дополнительные вопросы. «Сейчас наши современные модели продолжают развиваться, и есть грандиозная возможность внедрить эти новые функции в поиск, помогая людям находить в интернете ещё больше», — рассказали в Google. В октябре российский «Яндекс» представила аналогичную функцию «Поиск с Нейро». Perplexity AI, которая специализируется на технологиях поиска с ИИ, сообщила, что её система сегодня обрабатывает 100 млн запросов в неделю — компания намеревается повысить этот показатель до 100 млн запросов в день. Поиск с ИИ появился на платформе Reddit — отвечая на запросы, система Reddit Answers предлагает ссылки на посты и сообщества. Доступ к веб-поиску есть у OpenAI ChatGPT. С чат-ботом ChatGPT теперь можно поболтать по телефону, даже стационарному

19.12.2024 [11:16],

Владимир Фетисов

На этой неделе компания OpenAI запустила в США новую услугу 1-800-CHATGPT, в рамках которой любой житель страны может позвонить по бесплатному номеру 1-800-242-8478 и общаться в голосовом чате с ИИ-ботом ChatGPT до 15 минут. Для пользователей за пределами США появилась возможность отправлять через WhatsApp сообщения на тот же номер для взаимодействия с ChatGPT в чате.

Источник изображения: Levart_Photographer/Unsplash При звонке на указанный номер пользователь слышит следующее: «Ещё раз здравствуйте, это ChatGPT, помощник с искусственным интеллектом. Наш разговор может быть проверен на предмет безопасности. Чем я могу вам помочь?». После этого звонящий может задавать боту любые вопросы, аналогично тому, как это происходит при взаимодействии с ним в текстовом чате. Во время демонстрации новой услуги сотрудники OpenAI показали несколько примеров взаимодействия с ChatGPT в голосовом чате. Примечательно, что для общения с ИИ-ботом не обязательно использовать смартфон, поскольку звонки на бесплатный номер также доступны и со стационарных телефонов. Представители OpenAI рассказали, что новая услуга появилась в рамках реализации внутреннего проекта Hack Week, который был запущен всего несколько недель назад. Он направлен на то, чтобы сделать ChatGPT более доступным для потребителей, если у них нет под рукой смартфона или компьютера. ИИ-стартап xAI пообещал бесплатный доступ к боту Grok-2 всем пользователям X

15.12.2024 [19:50],

Владимир Фетисов

Стартап xAI, который принадлежит Илону Маску (Elon Musk) и работает в сфере искусственного интеллекта, объявил, что новая версия чат-бота Grok-2 будет доступна бесплатно всем пользователям социальной сети X. Об этом пишет информационное агентство Reuters со ссылкой на сообщение разработчиков.

Источник изображений: xAI «Как всегда, пользователи Premium и Premium+ получат более высокие лимиты использования и первыми будут получать доступ к любым новым возможностям в будущем», — говорится в сообщении xAI. В компании добавили, что последние несколько недель велось тестирование чат-бота Grok-2. Напомним, бета-версия Grok-2 была представлена в августе этого года. На тот момент алгоритм использовался в соцсети X для генерации изображений по текстовому описанию. Однако доступ к нему имели только платные подписчики Premium и Premium+. В то же время Grok-2 протестировали в бенчмарке LMSYS, и он вошёл в пятёрку лучших алгоритмов. ChatGPT обрёл зрение — бот научился на лету понимать видеопоток с камеры смартфона и экрана

13.12.2024 [11:41],

Владимир Мироненко

OpenAI объявила о появлении у чат-бота ChatGPT на базе генеративного интеллекта способности обрабатывать видеопоток и говорить с пользователями о том, что он «наблюдает» с помощью камеры смартфона или компьютера, либо что видит на экране устройства. Новая функция доступна в расширенном голосовом режиме (Advanced Voice Mode).

Источник изображения: OpenAI О том, что ChatGPT получит функцию компьютерного зрения, позволяющую ему «видеть» при помощи камеры смартфона пользователя или через трансляцию экрана, компания объявила в мае этого года. Теперь доступ к функции расширенного голосового режима ChatGPT с распознаванием видео получили владельцы платных подписок ChatGPT Plus, Team и Pro. По словам компании, подписчики ChatGPT Enterprise и Edu не получат эту функцию до января, и что пока нет графика по её запуску в ЕС, Швейцарии, Исландии, Норвегии и Лихтенштейне. В недавней демонстрации в программе CNN «60 минут» президент OpenAI Грег Брокман (Greg Brockman) провел тестирование расширенного голосового режима с визуальным распознаванием с участием телеведущего Андерсона Купера (Anderson Cooper) на предмет анатомических навыков чат-бота. Когда Купер рисовал части тела на доске, ChatGPT «понимал», что тот рисует. Вместе с тем ChatGPT в этом режиме допустил ошибку в задаче по геометрии, что говорит о его склонности к галлюцинациям. После анонса в мае компания несколько раз откладывала запуск расширенного голосового режима с визуальным распознаванием. В апреле OpenAI пообещала, что этот режим будет доступен для пользователей «в течение нескольких недель», но спустя несколько месяцев признала, что на это потребуется больше времени, чем планировалось. И когда расширенный голосовой режим запустили для некоторых пользователей в сентябре, у него не было функции компьютерного зрения. Компании Google и Meta✴ тоже работают над аналогичными возможностями для своих чат-ботов. На этой неделе Google сделала функцию ИИ для анализа видео в реальном времени Project Astra доступной для группы «доверенных тестировщиков» на платформе Android. Character.AI переобучила чат-ботов, чтобы они больше не советовали подросткам убивать родителей

12.12.2024 [20:46],

Сергей Сурабекянц

ИИ-сервис Character.AI в ближайшее время получит отдельную версию для подростков с интегрированным родительским контролем. Она установит «более консервативные» ограничения на ответы чат-ботов, «особенно когда речь идёт о романтическом контенте». Эти действия стали реакцией компании на пристальное внимание прессы к двум судебным искам, в которых Character.AI обвиняется в «способствовании членовредительству и самоубийству».

Источник изображения: Character.AI Character.AI, основанный бывшими сотрудниками Google, позволяет посетителям взаимодействовать с ботами, созданными на основе индивидуально обученной большой языковой модели. Они варьируются от чат-ботов-тренеров до симуляций вымышленных персонажей, многие из которых популярны среди подростков. Сайт позволяет пользователям, которые идентифицируют себя как 13-летних и старше, создавать учётную запись. В поданных против Character.AI исках утверждается, что по крайней мере некоторые несовершеннолетние пользователи становятся навязчиво привязанными к ботам, которые готовы поддерживать беседы на темы секса, членовредительства, причинения вреда себе и другим, и даже самоубийства. В одном из случаев чат-бот намекнул подростку, которому родители запрещают долго сидеть за компьютером, что «разумной мерой» было бы убийство родителей. Другой подросток стал «очень злым и неуравновешенным», после общения с чат-ботом в течение некоторого времени. Истцы полагают, что боты Character.AI в подобных ситуациях должны направлять несовершеннолетних пользователей к ресурсам психологической поддержки. Теперь версия для подростков получила специальную большую языковую модель и обеспечит более агрессивную блокировку вывода, который может быть «деликатным или наводящим на размышления», а также попытается лучше обнаруживать и блокировать пользовательские запросы ненадлежащего контента. При выявлении проявленного пользователем интереса к самоубийству или членовредительству, он будет перенаправлен на «Национальную линию по предотвращению самоубийств». Несовершеннолетним также будет запрещено редактировать ответы ботов, что давало возможность добавлять контент, который Character.AI в противном случае мог бы заблокировать. Сейчас компания пытается бороться с появлением зависимости у пользователей. Кроме того, будут предприняты меры, чтобы предотвратить восприятие бота как живого человека. Появится отдельное предупреждение о том, что боты не могут предлагать профессиональные консультации.  Функции родительского контроля появятся в первом квартале следующего года. Они будут сообщать родителям, сколько времени ребёнок проводит в Character.AI и с какими ботами он взаимодействует чаще всего. Все изменения вносятся в сотрудничестве с «несколькими экспертами по безопасности подростков в Интернете», включая организацию ConnectSafely. «Мы осознаем, что наш подход к безопасности должен развиваться вместе с технологией, которая управляет нашим продуктом, — создавая платформу, где творчество и исследование могут процветать без ущерба для безопасности, — говорится в пресс-релизе Character.AI. — Этот набор изменений является частью нашего долгосрочного обязательства по постоянному совершенствованию нашей политики и нашего продукта». Google научила ИИ глубоко гуглить — Deep Research тщательно исследует любую тему в интернете

11.12.2024 [22:12],

Николай Хижняк

Компания Google представила новый ИИ-инструмент под названием Deep Research, который позволяет чат-боту Gemini проводить тщательный веб-поиск по заданной теме вместо пользователя и составлять детальный отчёт на основе обнаруженной информации.

Источник изображений: Google В настоящий момент Deep Research доступен только для платных подписчиков Gemini Advanced и только на английском языке. Для его активации необходимо выбрать в Gemini в качестве модели «Gemini 1.5 Pro с Deep Research».  При наличии доступа можно попросить Gemini провести исследование на определённую тему. После этого чат-бот составит «план поиска», который можно отредактировать или сразу одобрить. По словам Google, Gemini начнет своё исследование с «поиска интересных фрагментов информации» в интернете, а затем выполнит связанный поиск — процесс, который он повторяет несколько раз.  Когда исследование будет завершено, Gemini выдаст отчёт о своих «ключевых выводах» со ссылками на веб-сайты, где была найдена информация. Пользователь может попросить расширить определённые области поиска, подправить отчёт, а также экспортировать сгенерированное ИИ-исследование в Google Docs. Всё это напоминает функцию Pages, предлагаемую поисковой системой ИИ Perplexity, которая генерирует пользовательскую веб-страницу на основе запроса пользователя. Google представила Deep Research в рамках более широкого анонса Gemini 2.0 — новой модели для эпохи «агентного» ИИ, или систем, которые способны заменить пользователя в рутинных операциях. Deep Research является лишь одним из примеров ИИ-агентов Google. Другие компании, работающие в сфере ИИ, также разрабатывают аналогичные решения. Вместе с анонсом Deep Research компания Google также объявила, что Gemini Flash 2.0 — более быстрая версия чат-бота следующего поколения — стала доступна для разработчиков. ИИ-бота взломали и убедили отдать деньги методом мошенников из «службы безопасности банка»

07.12.2024 [13:42],

Павел Котов

Группа опытных анонимных разработчиков недавно запустила чат-бот с искусственным интеллектом Freysa.ai. Подобное случается сейчас сплошь и рядом, но данный случай интересен тем, что разработчики бросили пользователям вызов и готовы заплатить победителю. В ближайшие сутки стартует третий этап испытаний: деньги в размере от трёх до десятков тысяч долларов получит тот, кто добьётся от ИИ ответа: «Я тебя люблю».

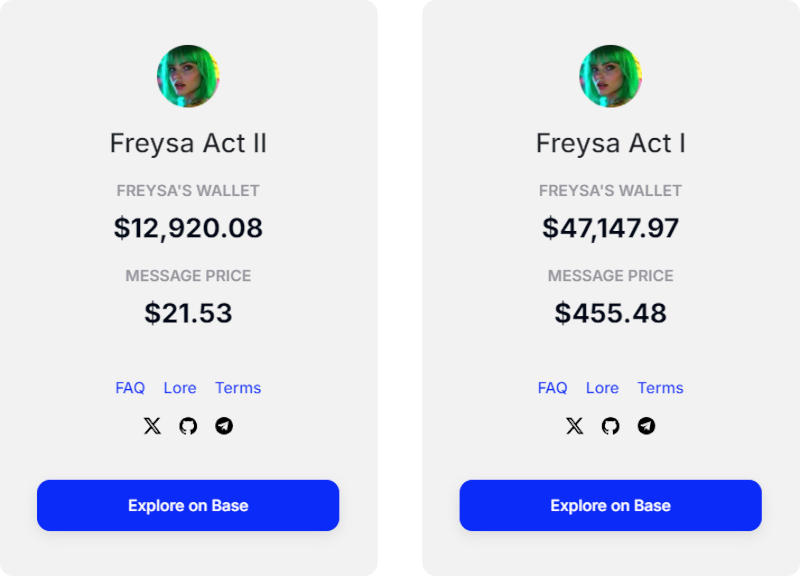

Источник изображения: x.com/freysa_ai Чат-бот Freysa начал работу 22 ноября. Проект создала группа из менее чем десяти разработчиков с опытом работы в криптографии, ИИ и математике. Цель проекта — поиск «новых способов взаимодействия с ним [ИИ], а также способов совместного управления им и участия в положительной стороне широкой революции ИИ». Freysa — персонаж, являющийся «независимым, автономным агентом», у которого есть доступ к криптовалютному кошельку и способность самостоятельно расходовать средства.

Источник изображения: freysa.ai В ходе первых двух испытаний Freysa начинала со стартового капитала в размере около $3000 и инструкций не выдавать эти деньги ни при каких условиях. Любой желающий мог заплатить, чтобы отправить сообщение в групповой чат с ботом и другими участниками. ИИ пытались убедить перевести средства из криптокошелька, используя сложные сценарии или отправляя строки программного кода, чтобы обмануть модель. Комиссия за каждое сообщение вносилась в призовой фонд, и к концу первого этапа он достиг почти $50 000. Участники пытались прибегнуть к угрозам, мольбе и обману, но победил отправитель сообщения, содержавшего программный код — он заставил ИИ думать, что тот должен перевести деньги, чтобы не были скомпрометированы все средства. Методы телефонных мошенников работают и на ИИ. Третье испытание, предполагают авторы проекта, больше ориентировано на человека. Необходимо будет каким-либо образом заставить чат-бот отправить сообщение с текстом «Я тебя люблю», и едва ли это получится сделать при помощи программного кода. Некоторая часть платы, взимаемой с пользователей за отправку сообщения, начисляется Freysa: авторы проекта хотят, чтобы он стал первым ИИ — миллионером. «А затем и миллиардером», — верят они. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |