|

Опрос

|

реклама

Быстрый переход

Продажи электромобилей Tesla в Европе рухнули почти вдвое в январе, хотя рынок вырос на 37 % — в этом замешаны политические амбиции Маска

26.02.2025 [10:23],

Алексей Разин

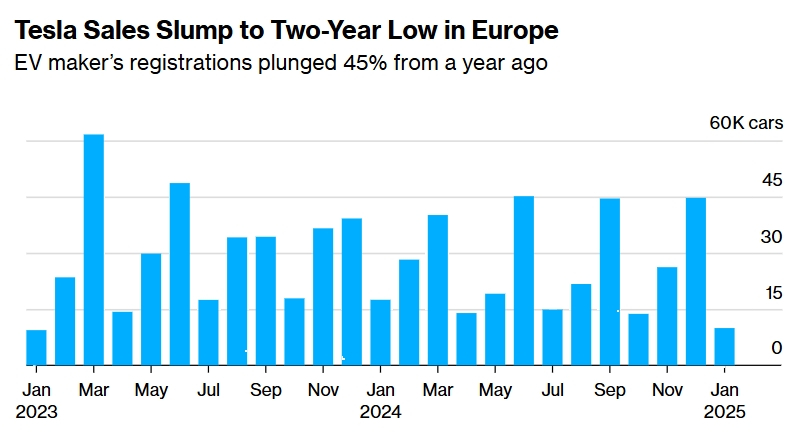

Акционеры Tesla и раньше выступали с претензиями к общественной деятельности главы компании Илона Маска (Elon Musk), которая порой вредила бизнесу, а после сближения генерального директора с Дональдом Трампом (Donald Trump) колебания курса акций Tesla стали ещё более заметными. В Европе продажи Tesla в январе рухнули на 45 %, тогда как весь рынок электромобилей в регионе вырос на 37 %.

Источник изображения: Tesla Во вторник на этой неделе акции Tesla упали в цене на 8 % под влиянием сразу нескольких факторов. Всего с начала года они подешевели на 25 %, растеряв почти весь прирост, полученный после победы Дональда Трампа на президентских выборах в США в ноябре прошлого года. Кинувшийся с головой в политику Илон Маск начал быстро наживать себе врагов не только в США, но и в той же Германии, где пытался влиять на исход парламентских выборов. Капитализация Tesla в итоге опустилась ниже отметки в $1 трлн и сейчас находится на минимальном с 7 ноября прошлого года уровне. Личное благосостояние Маска сократилось более чем на $100 млрд, хотя он всё равно так или иначе располагает активами на сумму $380 млрд, что позволяет считать его богатейшим человеком планеты.

Источник изображения: Bloomberg, European Automobile Manufacturers’ Association В январе продажи электромобилей Tesla в Германии сократились на 45 % в годовом выражении, хотя в целом европейский рынок продемонстрировал рост продаж автомобилей с этим типом силовой установки на 37 %. Однако влияние политической активности Маска в данном случае не следует переоценивать. Во-первых, покупатели электромобилей в Германии с недавних пор не могут претендовать на субсидии, что замедлило темпы перехода на электротягу среди местного населения. Во-вторых, наиболее выгодными для покупки в Германии остаются электромобили Tesla местного производства, а конвейеры предприятия в окрестностях Берлина в январе частично простаивали из-за переоснащения в рамках подготовки к выпуску рестайлинговой версии Model Y. В США, к слову, участились случаи вандализма в точках продаж электромобилей Tesla, поскольку наиболее радикальная публика ассоциирует продукцию этой марки с политической деятельностью Илона Маска. Кроме того, один из владельцев пикапа Tesla Cybertruck столкнулся с агрессией на улицах своего города и задумался о смене машины. Обратившись в Tesla с предложением сдать пикап по программе трейд-ин, он получил отказ, поскольку автопроизводитель не принимает Cybertruck в зачёт новой покупки. Разочарованию инвесторов способствовала и волна критики после появления усечённой версии FSD на китайском рынке. Этот комплекс технологий позволяет электромобилям Tesla управляться самостоятельно при определённых условиях. Впервые система стала доступна в Китае, но только на городских улицах. Китайские клиенты остались недовольны качеством «автопилота», поскольку конкурирующие автопроизводители предлагают на местном рынке более совершенные системы, причём порой без дополнительной платы, тогда как Tesla берёт за опцию $8800. Развитию автопилота Tesla в Китае мешают ограничения на передачу данных между США и Китаем. В итоге компания была вынуждена обучать нейросети по изображениям китайских улиц, полученным из сторонних источников, а не с бортовых камер собственных машин. Видеозаписи с китайских Tesla компания обязана хранить в центре обработки данных в Шанхае, но его вычислительных мощностей недостаточно для эффективного обучения нейросетей, а передача этих данных в США запрещена законом. Tesla старше 2023 года не получат полный автопилот без замены бортового компьютера, признал Илон Маск

30.01.2025 [08:03],

Алексей Разин

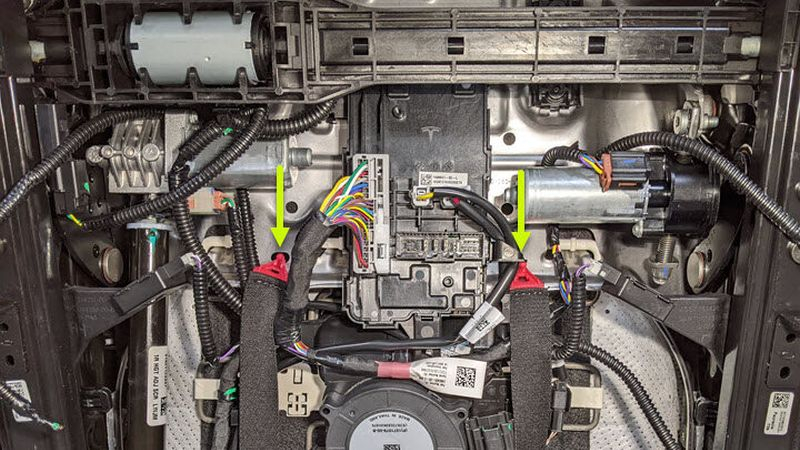

Ещё в октябре прошлого года глава Tesla признал, что реализовать полноценный автопилот FSD на электромобилях марки, выпущенных до января 2023 года, будет проблематично из-за устаревшего оборудования. На этой неделе Илон Маск (Elon Musk) пояснил, что Tesla готова за свой счёт менять оборудование на подходящее тем клиентам, кто оплатил полную стоимость опции FSD.

Источник изображения: Tesla Напомним, что последняя в определённые периоды деятельности Tesla стоила клиентам $15 000, и позволяла рассчитывать на доступ к полноценному автопилоту FSD после программного обновления. Как выяснилось к концу прошлого года, оборудование HW3, которое устанавливалось на электромобили Tesla с осени 2016 года, позволяет достичь полной автономности управления чисто теоретически, но с таким уровнем затрат, который делает подобные усилия нецелесообразными. Выходом из ситуации уже осенью прошлого года Маск видел замену бортового оборудования старых электромобилей на комплект HW4, на котором современное программное обеспечение будет работать более эффективно, а главное — более безопасно. На этой неделе представителей Tesla спросили о ситуации с реализацией полного автопилота на оборудовании HW3, и если глава направления FSD Ашок Эллусвами (Ashok Elluswamy) начал было говорить, что компания не оставляет попыток, Маск своим замечанием выразил более реалистичную перспективу: «Правда заключается в том, что мы нуждаемся в замене компьютеров HW3 на всех транспортных средствах с купленным FSD». По словам Маска, Tesla готова менять компьютеры HW3 на более совершенные за счёт компании, но только у клиентов, которые оплатили полноценную опцию FSD. Компании уже приходилось менять установленные в период с 2016 по 2018 годы бортовые компьютеры поколения HW2.5 на более современные HW3, чтобы открыть их владельцам доступ к оплаченной ими FSD. Один из них добился этого права без необходимости платить за модернизацию через суд. Проблема заключается в том, что оборудование поколения HW4 в нынешнем виде пригодно только к установке в новые транспортные средства, его нельзя без заводской доработки установить в электромобили, выпущенные до января 2023 года. По всей видимости, Tesla придётся создать переходный вариант бортового компьютера поколения HW4, который будет совместим с машинами, изначально оснащаемыми оборудованием поколения HW3. Какая часть из владельцев таких электромобилей оплатила FSD, судить сложно, но компании придётся разориться на модернизацию сотен тысяч, если не миллионов электромобилей. У новейших Tesla начали один за одним отказывать бортовые компьютеры

17.12.2024 [19:45],

Алексей Разин

Электромобили Tesla одними из первых получили обиходное определение «гаджетов на колёсах», поскольку их функциональность сильно зависела от возможностей бортовых компьютеров и устанавливаемого на них программного обеспечения. Машины свежих партий, как отмечает Electrek со ссылкой на собственные источники, стали страдать от серьёзных поломок бортовых компьютеров.

Источник изображений: Tesla Как поясняет источник, оснащаемые бортовым компьютером версии AI4.1 электромобили Tesla последних месяцев выпуска нередко сталкиваются с их выходом из строя по причине короткого замыкания. Что его вызывает, достоверно пока установить не удалось, но под подозрением находится низковольтная батарея электромобиля, которая приводит к короткому замыканию в процессе калибровки одной из бортовых камер. Неисправность может проявить себя на новых электромобилях с пробегом от нескольких десятков до нескольких сотен миль. Выход из строя бортового компьютера лишает электромобиль Tesla не только таких прогрессивных функций, как активная помощь водителю или «контролируемый автопилот» (FSD), но и вполне банальных функций типа GPS-навигации и оценки запаса хода на оставшемся заряде. Для электромобиля, впрочем, последняя весьма важна в условиях эксплуатации в регионах с не очень развитой зарядной инфраструктурой.  Сервисный бюллетень Tesla по этой неисправности до сих пор не выпущен, хотя количество обращений клиентов по этому поводу растёт, и фирменные сервисы уже вынуждены записывать желающих заменить бортовой компьютер по гарантии на январь 2025 года. Сотрудников Tesla при этом проинструктировали не нагнетать панику среди клиентов, убеждая последних, что на машине в подобном состоянии всё равно можно ездить. Отдельным нюансом является готовность Tesla заявить об этом дефекте в докладе агентству NHTSA, которое в США отвечает за безопасность дорожного движения. Неисправность камеры заднего вида, которую провоцирует выход из строя бортового компьютера, по требованиям NHTSA уже является достаточным основанием для объявления отзывной кампании. Tesla, которая сейчас отчаянно конкурирует с BYD за право остаться крупнейшим производителем электромобилей, в огласке подобных дефектов в данный момент не заинтересована. Американские регуляторы обвинили Tesla в пропаганде безответственного использования автопилота

09.11.2024 [07:42],

Алексей Разин

Отвечающее за безопасность дорожного движения в США ведомство NHTSA уже принудило компанию Tesla указывать при каждом упоминании системы FSD, что она пока требует постоянного слежения за дорожной ситуацией со стороны водителя. Теперь регуляторы упрекают Tesla в том, что в социальных сетях она поощряет безответственное использование данной функции.

Источник изображения: Tesla Как отмечает CNBC, в адрес совета директоров Tesla ещё в мае было направлено письмо, в котором глава NHTSA Грегори Магно (Gregory Magno) заявлял: «Посты Tesla (в социальных сетях) противоречат заявлениям о том, что водитель должен осуществлять непрерывный контроль за динамическим процессом управления транспортным средством». По мнению главы ведомства, у пользователей социальных сетей, которые изучают публикуемую Tesla информацию, может сложиться ложное впечатление об отсутствии необходимости контролировать транспортное средство в момент использования функции FSD. Теперь Tesla придутся до 18 декабря предоставить NHTSA ответ на данный запрос вместе с подробной технической информацией о работе системы FSD. Если компания не сделает этого, ей грозит штраф на сумму до $135,8 млн, но сроки ответа на запрос можно будет увеличить по инициативе Tesla. Агентство уже расследует предполагаемые дефекты в программном обеспечении, приведшие к ряду происшествий, которым предшествовала работа FSD на протяжении как минимум 30 секунд. В одном из ДТП электромобиль Tesla сбил пешехода, который в результате наезда скончался. Глава NHTSA просит совет директоров Tesla обратить внимание на ряд публикаций от лица компании в социальных сетях, которые пропагандируют пренебрежение правилами безопасности при использовании FSD. В одной из них водитель в предположительно предынфарктном состоянии добирается до больницы на электромобиле Tesla с активированной FSD. В другом случае водитель на протяжении 50-минутной поездки из места массового скопления людей не вмешивается в процесс управления машиной. Ведомство также обвиняет Tesla в склонении пользователей к применению FSD при движении в нетрезвом или утомлённом состоянии. NHTSA призывает Tesla привести свою информационную политику в соответствие с декларируемыми правилами использования собственных технологий. Илон Маск снова обманул владельцев Tesla — у машин до 2023 года выпуска не будет полного автопилота

24.10.2024 [09:53],

Алексей Разин

Попытки Tesla представить полноценный автопилот на своих электромобилях до конца прошлого десятилетия не увенчались успехом, и с тех пор Илон Маск (Elon Musk) каждый год исправно откладывает это событие «на конец следующего». На этой неделе он признался, что не видит смысла в реализации полноценной версии FSD на машинах, выпущенных с осени 2016 года по январь 2023 года.

Источник изображения: Tesla Проблема заключается в том, что ранее Tesla ориентировалась на гарантированную реализацию поддержки полного автопилота FSD всеми электромобилями, выпущенными с осени 2016 года, поскольку они оснащались аппаратным комплексом HW3 с нейронными процессорами Tesla собственной разработки. До этого компания сперва полагалась на компоненты израильской Mobileye, а потом некоторое время пыталась по примеру многих современных автопроизводителей сотрудничать с Nvidia. Принято считать, что собственные нейронные процессоры для автопилота Tesla помог разработать легендарный Джим Келлер (Jim Keller), но так или иначе к январю 2023 года компания начала оснащать свои электромобили более совершенной версией комплекса FSD, которая получила условное обозначение HW4. Помимо более производительных и современных процессоров, HW4 предусматривает использование и более совершенных камер. Как пришлось признаться Маску позднее, набор оборудования HW3 нельзя заменить на HW4, как это получалось с двумя предыдущими поколениями бортовых компьютеров Tesla. Выступая на отчётной конференции на этой неделе, глава компании пояснил, что реализация полноценного FSD для аппаратной платформы HW3 потребует слишком многих усилий, и он не уверен, что нужно идти этим путём. На HW4 всё получается проще, быстрее и безопаснее, причём именно последний фактор имеет решающее значение. «Если так получится, то мы будем бесплатно модернизировать машины тех, кто купил их с HW3, поскольку мы при разработке системы предусмотрели возможность модернизации», — заявил Илон Маск. Впрочем, в своём нынешнем виде система HW4 не может быть установлена в те машины, которые оснащены комплексом поколения HW3. Соответственно, если Tesla решит жестом доброй воли наделить всех владельцев электромобилей данной марки, выпущенных с осени 2016 года по январь 2023 года, доступом к полной версии FSD, то ей придётся выпустить совместимый комплект оборудования. На мероприятии Tesla её генеральный директор Илон Маск также выразил надежду, что FSD окажется безопаснее среднестатистического водителя ко второму кварталу следующего года, а также напомнил, что жителям Калифорнии и Техаса фирменный сервис беспилотных такси станет доступен в следующем году. Tesla запустит автопилот FSD в Китае и Европе в первом квартале 2025 года

05.09.2024 [12:54],

Алексей Разин

С июня текущего года Tesla получила право тестировать комплекс систем активной помощи водителю FSD на дорогах Шанхая, но благодаря прогрессу в разработке соответствующего ПО с учётом американского опыта внедрение данной опции на китайском рынке может начаться уже в первом квартале следующего года. Тогда же это произойдёт и в Европе.

Источник изображения: Tesla Об этом, как отмечает Bloomberg, компания сообщила накануне. Как только регуляторы в Европе и Китае одобрят использование FSD на дорогах общего пользования, Tesla сможет предложить данную опцию клиентам в соответствующих регионах. Все выпускаемые с 2016 года электромобили данной марки оснащаются всем необходимым для полуавтоматического вождения оборудованием, для получения доступа к данной технологии необходимо лишь активировать соответствующее программное обеспечение. Желающие могут докупить эту опцию дистанционно, для её активации не потребуется посещать сервисный центр Tesla. Чтобы подготовиться к запуску FSD в Китае, компании пришлось привести свою инфраструктуру в соответствие с требованиями китайских властей к информационной безопасности, а также заключить соглашение об использовании цифровых карт местности с китайской компанией Baidu. Поскольку многие китайские конкуренты разрабатывают и успешно внедряют собственные системы автопилота, Tesla пришлось поторопиться с адаптацией своей технологии к китайскому рынку. Уже сейчас китайские владельцы электромобилей Tesla могут доплатить чуть более $9000 за активацию FSD в будущем. Усечённая версия системы по имени Enhanced Autopilot предлагается вдвое дешевле. Попутно компания опубликовала список изменений, которые будут внедрены в бортовое ПО её электромобилей в сентябре текущего года. Во-первых, начнёт распространяться версия FSD 12.5.2, которая увеличит среднее проезжаемое без вмешательства водителя в управление расстояние в три раза по сравнению с предыдущей версией. Данная версия ПО использует вычислительные ресурсы платформы AI4, но может работать и на AI3, поскольку они обе способны работать с унифицированной языковой моделью. Помимо уже упоминавшейся недавно функции автоматического вызова машины с парковочного места, в сентябре Tesla добавит возможность слежения за направлением взгляда водителя в солнцезащитных очках. Кроме того, у пикапов Tesla Cybertruck впервые появится функция автоматической парковки. Хакеры получили доступ к процессорам Tesla FSD аварийных автомобилей и раскрыли тревожащие данные

31.07.2024 [05:18],

Анжелла Марина

Независимое расследование, проведенное The Wall Street Journal, показало, что система помощи водителю Tesla Autopilot может приводить к смертельным авариям из-за ошибочных решений, принимаемых алгоритмом. Журналисты издания извлекли компьютеры Tesla с функцией FSD из аварийных автомобилей и с помощью хакеров, как сообщает Notebookcheck, получили доступ к необработанным данным автопилота.

Системная плата компьютера Tesla FSD. Источник изображения: WSJ Анализ этой информации вместе с видеозаписями аварий и официальными отчётами позволил воссоздать 222 инцидента с участием Tesla. В 44 случаях автомобили на автопилоте внезапно меняли траекторию направления, а в 31 случае не остановились или не уступили дорогу. Последний сценарий, по данным исследования, обычно приводил к наиболее тяжёлым авариям. Одним из самых ярких и нашумевших примеров служит столкновение с перевёрнутым прицепом, который система автопилота не смогла распознать как препятствие и автомобиль Tesla врезался в него на полной скорости. Приводятся и другие свидетельства, когда во время тест-драйва система FSD повела себя неадекватно, в следствии чего автомобиль пересёк сплошную линию разметки и едва не спровоцировал аварию на перекрёстке. Также выяснилось, что система FSD плохо распознаёт аварийные сигналы, что приводит к столкновению транспортных средств. Расследование The Wall Street Journal выявило в автопилоте проблемы как аппаратного, так и программного характера, начиная от медленного обновления алгоритмов до недостаточной калибровки камер. Пока неясно, достаточно ли этих данных, чтобы опровергнуть утверждение Илона Маска (Elon Musk) о том, что система Tesla всё равно безопаснее водителя-человека. Предполагается, что Tesla специально оптимизирует автопилот для Илона Маска и влиятельных блогеров

12.07.2024 [08:10],

Алексей Разин

Издание Business Insider на этой неделе выступило с громким разоблачением, после опроса нескольких бывших сотрудников Tesla заявив, что компания целенаправленно уделяет больше внимания совершенствованию автопилота на тех маршрутах, по которым перемещается её глава Илон Маск (Elon Musk) или наиболее влиятельные видеоблогеры, освещающие данную тематику в США.

Источник изображения: Tesla Расследование Business Insider показало, что процесс обработки видеоданных, поступающих с бортовых камер электромобилей Tesla для обучения систем автопилота, организован неоднородно. Руководители профильных подразделений, которые занимаются аннотацией данных, настаивают на более тщательной обработке данных, собранных на определённых маршрутах. Хотя технология обработки информации не позволяет специалистам Tesla судить о принадлежности конкретного электромобиля определённому лицу, некоторые из исполнителей подобных работ считают, что собираемой с машин главы компании информации отдаётся особый приоритет с точки зрения качества аннотаций. Некоторым сотрудникам даже выплачивались сверхурочные в случае необходимости срочной обработки данных с какого-то маршрута, предположительно связанного с деятельностью Илона Маска. Имеется в этой истории и другой прецедент — одного из сотрудников Tesla якобы уволили из-за некачественной аннотации фрагмента видео, предположительно полученного с электромобиля, на котором передвигается Илон Маск. Некачественная обработка привела к тому, что система активной помощи водителю некорректно себя повела в определённой ситуации, и это вызвало недовольство начальства. Многие из бывших сотрудников Tesla признаются, что им поручалось заняться аннотацией видеоданных с особой тщательностью, и судя по маршрутам передвижения, они были как-то связаны с посещением штаб-квартир Tesla, SpaceX и даже Twitter в период покупки последней Илоном Маском в 2022 году. До ноября 2021 года, как считается, Маск владел домом в Калифорнии, и окрестные маршруты на отдельных видеозаписях с бортовых камер Tesla также обрабатывались профильными специалистами с особой тщательностью. Всё это приводит к тому, как отмечают эксперты, что Илон Маск при использовании FSD получает заметно более высокое качество работы бортовой автоматики электромобилей Tesla, поскольку наиболее часто преодолеваемые им маршруты в итоге получаются более изученными. Это может создавать у него ложное представление о реальных возможностях бортовой автоматики электромобилей данной марки. Не обделяет вниманием Tesla и известных в США блогеров, которые снимают ролики про работу FSD и нередко критикуют эту систему. Специалисты компании признались, что часть видеозаписей получает приоритетную обработку, подобной той, что свойственна получаемым с предполагаемых машин Илона Маска данным. Как утверждается, представители Tesla следят за маршрутами блогеров на основе их обзоров, а затем при необходимости направляют в этот район водителей-испытателей на тестовых машинах, чтобы собрать дополнительную информацию для совершенствования работы автоматики в конкретной местности. Один из таких блогеров, Чак Кук (Chuck Cook), признал, что часто видит в окрестностях своего дома испытателей Tesla на служебных машинах, но все попытки вступить с ними в контакт пресекаются сотрудниками компании. Специалисты утверждают, что в подобном внимании Tesla к замечаниям блогеров нет ничего предосудительного, ведь эта категория водителей отличается особым пристрастием в вопросе поиска «слабых мест» в программном обеспечении, и своей деятельностью, по сути, помогает его усовершенствовать. Tesla с автопилотом в среднем проезжает 12,2 млн км без аварий — в 8 раз больше, чем без автопилота

23.05.2024 [13:44],

Алексей Разин

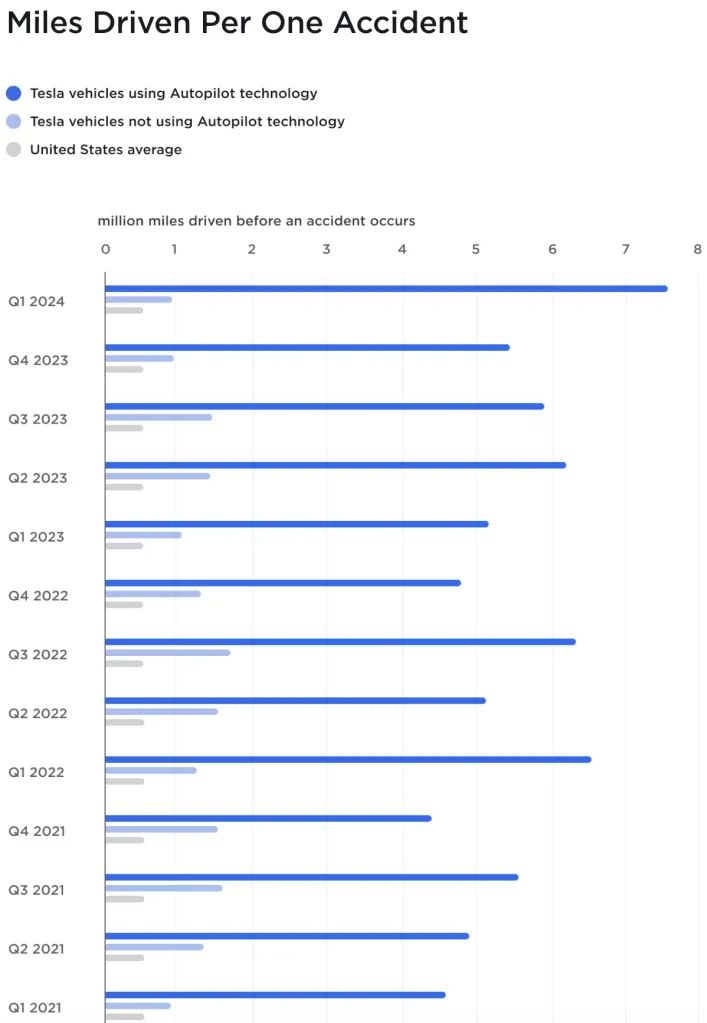

Средства массовой информации пристально следят за каждой аварией с участием управляемых автоматикой электромобилей Tesla, а между тем компания регулярно публикует отчёты об аварийности на базе статистики, полученной при обработке собираемых по всему автопарку данных. Сейчас электромобиль этой марки со включенной функцией Autopilot в среднем способен проезжать без ДТП по 12,2 млн км.

Источник изображения: Tesla Как поясняет Electrek, компания Tesla возобновила публикацию подобной статистики, хотя в четвёртом квартале 2022 года без объяснения причин прекратила это делать. Глядя на приведённый ниже график, можно догадаться, почему это случилось. По всей видимости, изменения в бортовом программном обеспечении с начала прошлого года привели к ухудшению статистики аварийности Tesla по сравнению с предыдущими периодами, поэтому компания и решила не раскрывать данные. Теперь, когда статистика снова начала улучшаться, можно обнародовать данные уже задним числом.  В первом квартале текущего года, как отмечается в отчёте Tesla, компания добилась серьёзного прогресса в продолжительности безаварийного пробега. В частности, машины этой марки со включенной функцией Autopilot в среднем проезжают без ДТП по 12,2 млн километров (7,63 млн миль). Даже электромобиль Tesla без этой функции в среднем демонстрирует более высокую безаварийность, чем все прочие транспортные средства на дорогах США. В частности, электромобиль Tesla без активного Autopilot в среднем проезжает 1,5 млн км без аварий, тогда как средний показатель по стране за 2022 год для машин всех марок не превышал 1,07 млн км. При этом надо учитывать, что Tesla не приводит статистику по более совершенному программному комплексу FSD, который должен дополнительно улучшать показатели безаварийности. Autopilot по своим возможностям заметно уступает FSD, но хорошая новость заключается в том, что с недавних пор обе системы используют один программный код, а потому совершенствуются синхронно. Следствие подозревает Tesla в обмане инвесторов, манипуляциях с ценными бумагами и подлоге данных о FSD

09.05.2024 [09:12],

Алексей Разин

Агентству Reuters стало известно, что следователи в США подозревают компанию Tesla в манипуляциях с ценными бумагами или подлоге данных с использованием электронных средств с целью ввести в заблуждение инвесторов и потребителей относительно реальных возможностей системы активной помощи водителю FSD.

Источник изображения: Tesla Расследование в отношении Tesla ведётся с октября 2022 года, и теперь у Reuters появились новые данные о конкретных подозрениях следователей. Компания, по их мнению, могла предоставлять недостоверную информацию о своих системах активной помощи водителю не только государственным регуляторам, но и клиентам. Tesla также подозревается в манипуляциях с ценными бумагами с целью обмана инвесторов. Есть у Комиссии США по ценным бумагам и биржам (SEC) и вопросы по поводу предоставления компанией недостоверной информации о системах Autopilot и FSD инвесторам Tesla. Необходимые документы были запрошены следователями у Tesla, сейчас ведётся их изучение. Илон Маск (Elon Musk) не раз высказывался о возможностях данных систем, говоря об отсутствии необходимости для человека вмешиваться в процесс управления транспортным средством, но регуляторы принудили компанию в официальных материалах напоминать клиентам, что водитель должен контролировать ситуацию и несёт ответственность за поведение машины на дороге. Глава компании уже почти на протяжении десяти лет обещает инвесторам и клиентам реализовать полное автоматическое управление электромобилями Tesla, но постоянно сдвигает сроки на конец очередного года. Следствие пытается определить, насколько подобные заявления могли ввести инвесторов и клиентов Tesla в заблуждение, и повлекло ли это какой-то измеряемый материальный ущерб. По требованию властей недавно Tesla была вынуждена через программное обновление сделать уведомление водителям о необходимости следить за дорогой при использовании FSD более заметным. В США до сих пор расследуются сотни ДТП, в которых были задействованы электромобили Tesla со включенными системами активной помощи водителю. Часть из них завершились летальным исходом для некоторых участников. Федеральное расследование аварий с автопилотом Tesla нашло их причину — «неправильное использование»

26.04.2024 [20:47],

Сергей Сурабекянц

Национальная администрация безопасности дорожного движения (NHTSA) закрыла расследование в отношении системы помощи водителю Tesla Full Self-Driving (FSD), рассмотрев сотни аварий, в том числе 13 со смертельным исходом, связанных с её «неправильным использованием». Одновременно NHTSA начинает новое расследование, чтобы оценить насколько эффективны доработки автопилота, произведённые Tesla во время отзывной компании в декабре.

Источник изображений: Tesla Закрытие первоначального расследования, которое началось в 2021 году, знаменует собой конец одной из наиболее заметных попыток правительства по тщательному изучению программного обеспечения автопилота Tesla. Сегодня Управление по расследованию дефектов NHTSA сообщило о проделанном «обширном объёме работы», который позволяет сделать вывод, что «слабая система взаимодействия с водителем Tesla не соответствует допустимым эксплуатационным возможностям автопилота». «Это несоответствие привело к критическому разрыву в безопасности между ожиданиями водителей относительно рабочих возможностей [автопилота] и истинными возможностями системы, — пишет агентство в своём отчёте. — Этот разрыв привёл к предсказуемому неправильному использованию и сбоям, которых можно было избежать».  NHTSA сообщило, что в ходе расследования было рассмотрено 956 зарегистрированных аварий до 30 августа 2023 года. Примерно в половине (489) из них агентство не выявило «вины» автопилота либо не располагало достаточными данными для проведения оценки. Оставшиеся 467 аварий были условно разделены на три группы. В наиболее серьёзных 211 авариях «лобовая плоскость Tesla столкнулась с другим транспортным средством или препятствием, и у внимательного водителя было достаточно времени, чтобы отреагировать, чтобы избежать столкновения или смягчить его последствия». 145 аварий были связаны с «выездом за пределы проезжей части в условиях низкой тяги, например, на мокрой дороге». 111 аварий произошли при выезде на проезжую часть, когда «система автоматического рулевого управления была случайно отключена действиями водителя». Агентство полагает, что серьёзные последствия аварий часто являются результатом того, что «ни система, ни водитель не реагируют должным образом, что приводит к перепадам скоростей и высоким энергетическим последствиям».

Источник изображения: KTVU-TV/AP Tesla требует от водителей при использовании автопилота следить за дорожной обстановкой и держать руки на руле, что контролируется при помощи датчика крутящего момента, а в новых автомобилях — камеры в салоне. Но NHTSA и другие группы безопасности считают, что этих мер «недостаточно для предотвращения злоупотреблений». Tesla согласилась обновить программное обеспечение, чтобы улучшить мониторинг действий водителей. Но это обновление, похоже, не сильно изменило автопилот — по данным NHTSA, некоторые части этого обновления ПО требуют согласия владельца, а Tesla позволяет водителю «легко отменить» некоторые меры безопасности.

Источник изображения: TheVerge Агентство выявило огромные пробелы в телематических данных, собираемых Tesla, что создаёт неопределённость относительно фактической частоты аварий. По данным агентства, Tesla получает данные лишь при срабатывании подушек безопасности, преднатяжителей ремней безопасности или функции смягчения воздействия на пешеходов на капоте автомобиля. NHTSA полагает, что из всех аварий, о которых сообщается в полицию, Tesla осведомлена лишь примерно о 18 %. Министерство юстиции США проводит собственное расследование в отношении Tesla, а Департамент транспортных средств Калифорнии обвинил компанию в ложной рекламе возможностей автопилота и потребовал углублённого тестирования программного обеспечения FSD. Компания также столкнулась с многочисленными судебными исками в отношении автопилота. Тем не менее, Tesla не меняет курс и изо всех сил пытается добиться полной автономности её транспортных средств. |